一个星期五连发,AI大模型卷出新的高度:阿里豆包谷歌哪个强?

大型模型再次卷起。

3 月 28 日本,阿里和字节不约而同地发布了各自大模型的重磅升级:一方面是视觉推理模型,可以看图片,看视频,解决数学题。 QVQ-Max;另一边是豆包打开检测可以边搜索边搜索的新版本。「深度思考」。

图/ Qwen

同一天,两大国产大模型都按下了新一轮大模型更新的启动键,也许不是巧合。本周,各大主流模型都发布了一轮更新:

DeepSeek 发布 V3-0324 新版本,推理,写作,编码能力再次提高;Google 也推出了 Gemini-2.5-Pro,几乎得到了全方位的技能提升,仍然是 LMArena 榜单上打出 40 绝对领先优势;OpenAI 也升级了 GPT-4o 图像生成功能,可控性和质量进化很大。

各种基本模型再次卷起。

从图像生成到视觉推理,从多模式到长文字,这一轮更新更像是一场全方位能力升级的排位赛——不仅是功能和质量,还有「智能体时代」谁能提供更好的基础模型?

五大模型集体上新,究竟卷什么?

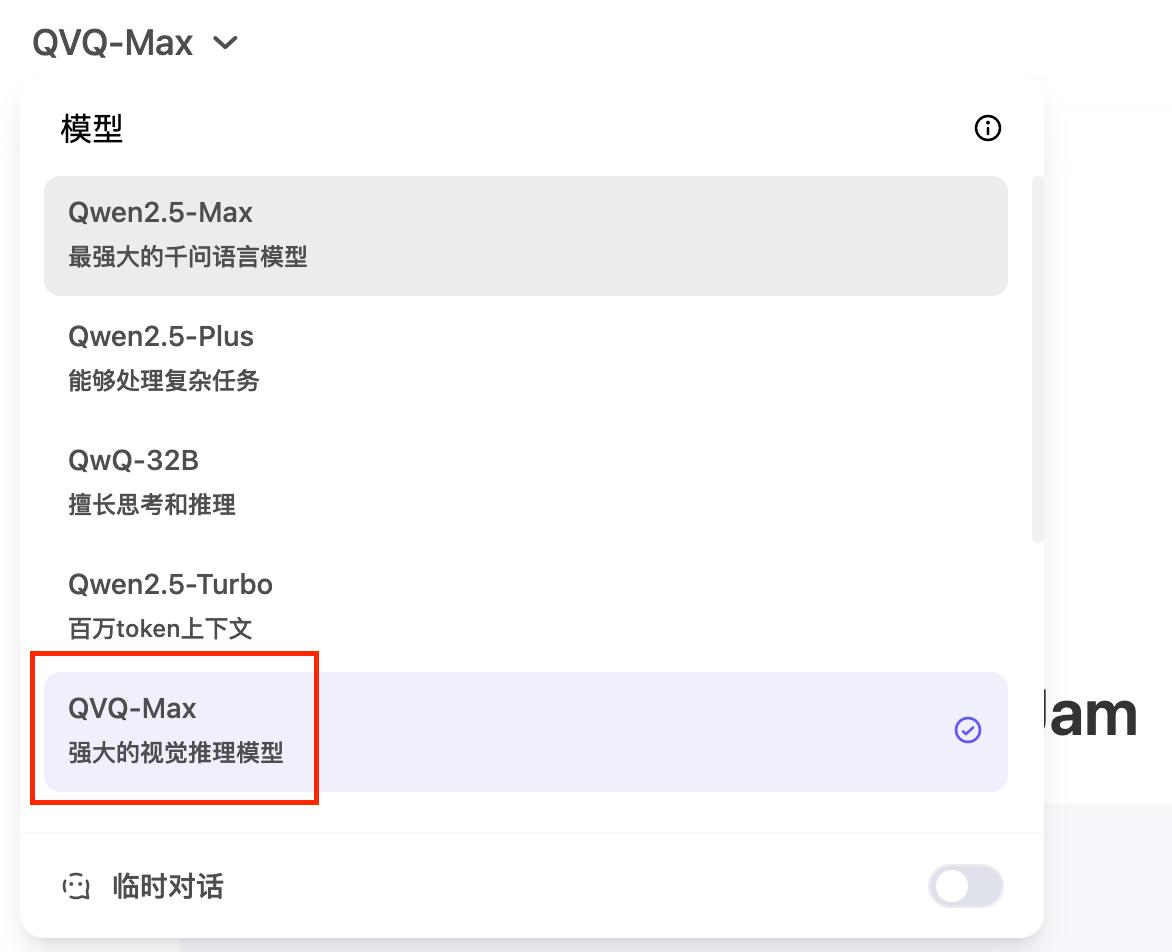

1、阿里 QVQ-Max:视觉推理能力全开。

图/ 阿里

对视觉推理模型而言,阿里的野心和意图十分明显。早在去年 12 月,阿里 Qwen 这个团队探索性地推出了。 QVQ-72B-Preview 视觉推理模型。今年到了 1 月亮,还为雷鸟创新创造了雷鸟。 V3 AI 定制眼镜模型。

而 QVQ-Max 这是一次全面的升级,不仅可以「看懂」图表,照片,甚至理解视频内容,结合这些信息进行分析和推理,给出解决方案。例如,它可以「看」形成一组几何图形之间的角度关系,或者预测视频中下一秒可能出现的行为,在多模态基准测试中表现出色。

简单来说,QVQ-Max 对于图片的分析能力很强,不管是复杂的图表,还是日常生活中顺手拍摄的照片,它都能迅速识别出关键要素, QVQ-Max 这些信息也可以进一步分析,并结合背景知识得出结论。

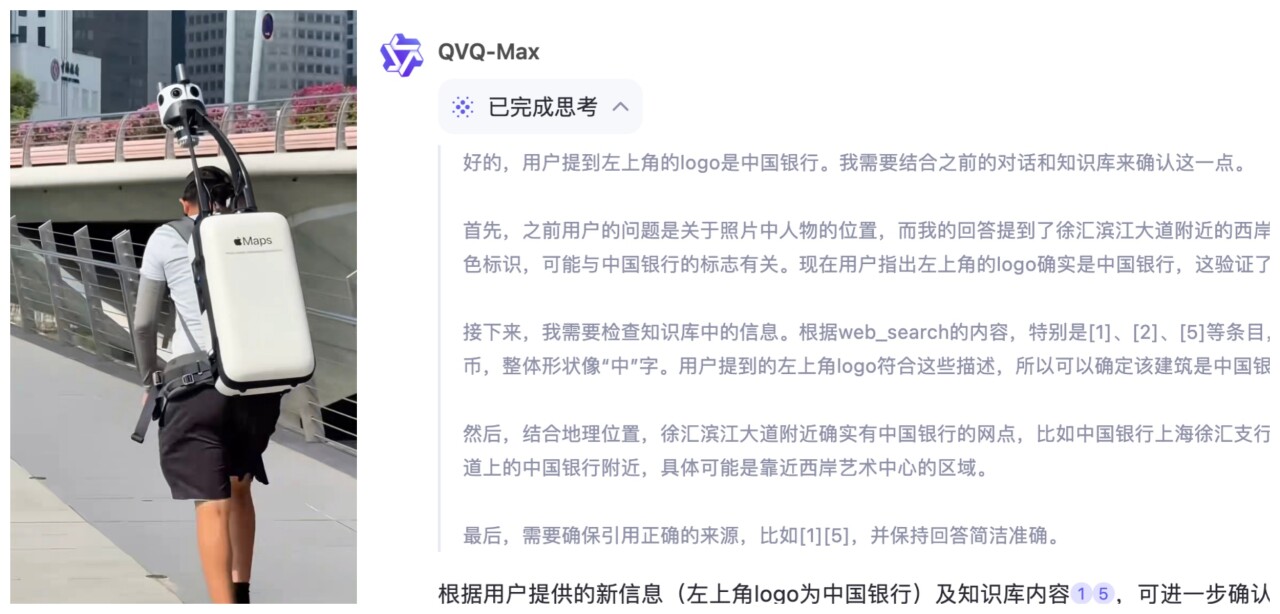

图/ Qwen

另外值得一提,QVQ-Max 现在已上线了 Qwen Chat(https://chat.qwen.ai),简单上手感受一下,对照片的分析明显强于Qwen2.5-Max,甚至可以根据「左上方的logo是中国银行。」提示对应于照片中。

2、豆包新版「深度思考」,推广一种推理进阶。

与此同时,字节豆包也进行了新版本的测试。「深度思考」能力,支持在动态搜索的同时进行思维链,实现「边想边搜」。在实际体验中,豆包会在思考的过程中搜索信息,不断地通过搜索补充信息来思考。

简而言之,如果客户提问涉及时间、地点、前后文本的变化或需要跨知识链的信息整合,豆包将不会「一次搜索一堆」,而在推理过程中,会多次触发搜索节点,不断修改和完善自己的思维路径。

了解 QVQ-Max 思考过程,图/豆包

例如,我试着让豆包了解更多。 QVQ-Max 模型,它进行了两次搜索:第一次找到 16 本文参考资料,考虑到部分资料的不足,再次进行了第二次搜索,找到了。 8 文章参考资料。

与 DeepSeek-R1、GPT 与之前的工具调度能力相比,豆包这次升级虽然不是开创性的,但显然弥补了之前在解决复杂问题上的不足。

3、DeepSeek-V3 小版本更新,每一点都强一些。

图/ DeepSeek

DeepSeek-V3 最新发布的 0324 小版本更新,依然延续。「小体积 大能力」的路线,主要参考了 DeepSeek-R1 强化学习技术在模型训练中的应用,进一步优化了推理、写作、编程能力。

在前端开发能力方面,新模型可以生成更具现代设计感的网页结构,在代码生成、转换和编辑能力方面更加稳定;在写作方面,中文长文的逻辑性和流畅性明显提高,更适合小说、剧本等内容创作。

4、Gemini 2.5 Pro:最强通用的谷歌模型来了。

相比 DeepSeek-V3 ,Google 这周推出的 Gemini 2.5 Pro 这是一次真正的意义「大升级」,全面提升了编码、数学、视觉推理、搜索调度等能力。简而言之,它将会「大语言模型」推向「高可信度,多轮决策智能体」方向演变。

作为 Google 首个「全方位智能体底座」模型,Gemini 2.5 Pro 就对话能力而言,可以算是技压群雄,大模型试炼场机制相对合理。 Chatbot Arena 坐在第一位,并且大大领先于其它一批顶级大型模型,包括 Grok-3、GPT-4.5、DeepSeek-R1。

图/Chatbot Arena

在编码方面也是如此 Agentic Coding(智能体编码)弱于 Claude-3.7-Sonnet,但在 SWE-Bench Verified 在编程检验方面遥遥领先,特别擅长建立复杂性。 web 应用程序和代理工具链。图像生成方面,Gemini 2.5 Pro 同时也取得了很大的进步, GPT-4o 以前升级图像生成能力也让很多人大吃一惊。

5、GPT-4o 生成原始图片,效果震撼全球网民。

仅从热度来看,GPT-在这一轮集体升级中,4o(0326)更新无疑是最大的赢家。本周,OpenAI 为 GPT-4o 推出新一轮升级,不仅提高了处理复杂技术和编码问题的能力,而且最有可能是原生图像生成功能。

上线后,无数网友都在尝试新版本的图像生成功能,尤其是让图像生成功能 GPT-4o 用「吉卜力风格」重画更是填满了我的社交媒体时间线。按照 OpenAI CEO 山姆・奥尔特曼(Sam Altman)的说法,GPT-4o 更新后,对文生图的需求急剧增加,甚至导致 GPU 超负荷。

(ChatGPT 4o 按照照片生成,原始照片为AWE2025展位哔哩哔哩)

与之前相比,本次更新显著提高了对复杂指令的理解能力和图文混排渲染的可控性,尤其是在生成图像中的文本内容时,准确性大大提高。更重要的是,新版本 GPT-4o 支持图像风格和构图元素在多轮对话过程中的不断修改,可以逐步优化,视觉一致性更强,客户互动体验也提升到了一个层面。

智能体时代临近,大模型不谋而合拼内功。

如果前几个月大模型更新的节奏还有点分散,那么这次集体升级几乎同步到来,已经明确释放了一个信号:大模型正在全方位补充能力,为智能体的爆发做准备。

在过去的一年里,大型行业的主旋律是「多模态」和「高性能」,但是经过这一轮更新,我们可以发现,大厂开始集中注意力于三个方向:更加强大的推理链条,更加优质的内容生成,更加贴近智能体形态系统的调度能力。

推理能力,无疑是最重要的。 QVQ-Max 在强化视觉推理的帮助下,打开了对多模态理解的深层能力,而豆包则借助于「边想边搜」弥补复杂问题处理的弱点, DeepSeek 和 Gemini 更是通过 RLHF(加强学习)加强多轮决策和长期规划。

所有这些动作都指向一个目标:让大模型不止于此「解题机器」,而能真正参与复杂的任务和流程执行。

图/ Google

同时,内容产生的质量也得到了普遍的提高。GPT-4o 升级图像生成功能的背后,实际上是从文本到图像再到排版的全过程可控性提高;DeepSeek V3 从代码到长文本,新版本也在强调内容生成水平的提高。

今天的模型更强调,无论是图像生成、代码生成还是小说生成。「结构正确,风格统一,工艺透明」,简而言之,就是夯实大模型的基本能力。

但是除了推理和基本能力之外,大模型还在快速补充智能体所需的基本能力,比如工具调用。不管是豆包「动态搜索」调用工具的能力,还是 Gemini 在 SWE-Bench 在中间构建多步程序的能力,本质上都是为了「模型可以独立完成任务」做准备。

从本轮更新来看,大模型「智能体化」逐渐成为下一场大赛的开始,而基本能力的全面补充,正使这场比赛越来越像是「拼内功」长期战争。

而且确信,ChatBot 不是大模型的终点,而是 AI 代理,或者说 AI 智能化身体是大模型真正无处不在的入口。

这篇文章来自“雷科技”,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com