一群技术人员拉着横幅围攻OpenAI,忍不住AI一直在闹事。

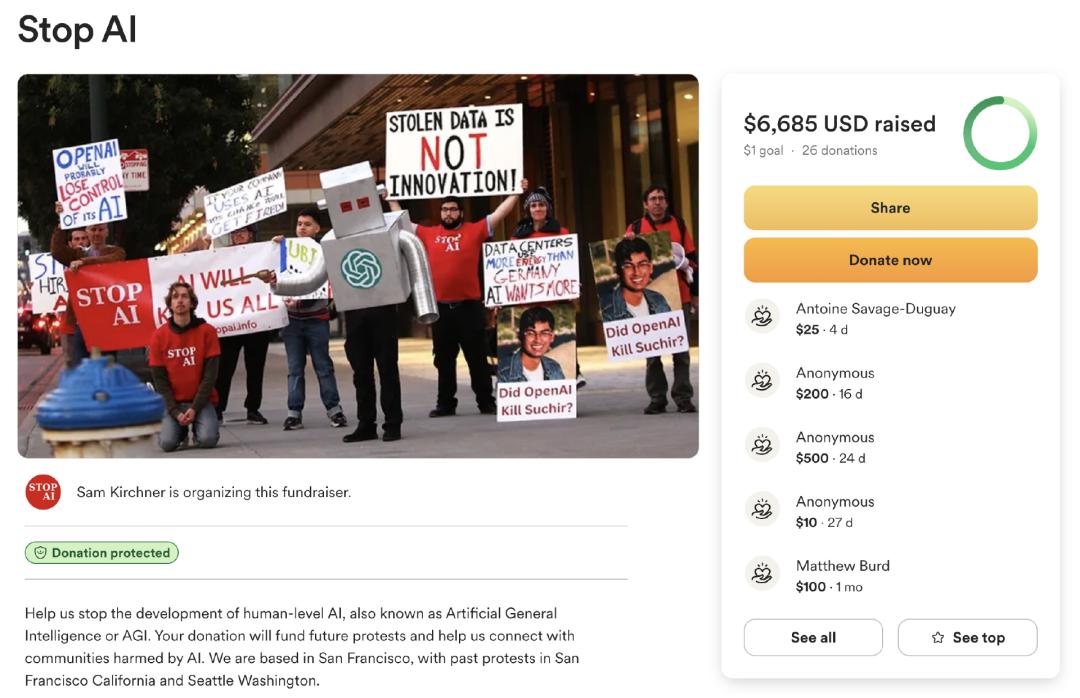

最近,据外媒报道,上周六,一群活动人士在美国旧金山举行了一次聚会,成立了一个名字。 停止人工智能”(Stop AI)非暴力公民抵抗组织旨在防止人工智能的进一步发展,尤其是通用人工智能。(AGI)。OpenAI 将 AGI 它被定义为超越人类在大多数经济效益工作中的高度自主系统,而这个组织认为它有很大的影响和危险,希望能够完全禁止。

Stop AI 一系列目标已经在其网站上公布,包括要求政府强制人工智能公司关闭所有与通用人工智能模型创建相关的工作,破坏当前模型并永久禁止其开发。然而,它们并没有禁止所有的人工智能,而只是针对那些威胁到人类生存的部分。

矛头对准 OpenAI

就实际行动策略而言,Stop AI 主要是通过组织抗议活动来扩大影响。例如,他们最近又开始“围攻”了。OpenAI 抗议的总部位于旧金山。以前,这个组织已经存在了 OpenAI 许多抗议活动都是在办公室和其他地方举行的。这些创始人中有两个 Sam Kirchner 和 Guido Reichstadter,因在去年 10 月封锁 OpenAI 入口被抓。

Stop AI 成员 Finn van der Velde——一位具有计算机科学和人工智能技术背景的安全倡导者和活动人士提出阻止 AGI 如果出现了,可能需要一个国际条约,各国都同意不开发。 AGI,这个意思是解散图像 OpenAI 这样以开发 AGI 企业的目标,与此同时,控制计算能力,避免有人训练。 AGI 模型。

还有人在抗议活动中呼吁对抗议 OpenAI 前员工,侵权举报者 Sunchir Balaji 进一步调查死亡情况。

2024 年 11 月,Balaji 在旧金山的公寓里被发现死亡。但是 Balaji 他们的父母说,他们不相信儿子自杀了,他们希望外部机构调查孩子的死因。

26 岁 Balaji 父母说,他们仍然对儿子的死因有疑问。她们说,11 月 26 日,Balaji 被发现死在旧金山的公寓里,身上有疑似枪伤的痕迹。旧金山警方表示,这似乎是一起自杀事件,在初步调查中没有发现谋杀的证据。然而,他的母亲说他的公寓里有些东西是错误的。

"密码驱动器不见了。电脑坏了。他的台式电脑已经开了三天了。一切都乱七八糟,"Balaji 普尔尼玛·拉玛劳玛的母亲(Poornima Ramarao)说道。

Balaji 于 2020 年开始担任 OpenAI 研究人员,辞职后,他公开宣称该公司正在开发开发 ChatGPT 时间违反了版权法。他的家人说,在他去世的前四天,他被传唤为一起针对他。 OpenAI 案件作证。

Stop AI 觉得,Balaji 死亡可能不是自杀而是被杀。被杀的原因是阻止他说出来。 ChatGPT 真相是版权问题。

Stop AI 提及对于人工智能巨头寻找创造“超级智能”的道德担忧。

Stop AI 是谁?你在做什么?

Stop AI 由创始人 Sam Kirchner 和 Guido Reichstadter 领导者,现在已经存在了 OpenAI 在办公室外进行抗议活动。星期六下午, Stop AI 在科技公司 OpenAI 在外面举行示威活动,他们担心公司的技术可能会导致 "人类灭绝"。它们设定了一个大胆的目标,但愿得到美国 3.5% 人口(即 1100 支持万人)。

Stop AI 其成员来自计算机、机械和数学相关行业。

创始成员 Sam Kirchner 它有机械和电气工程的背景, Reichstadter 那就曾经是珠宝商 20 年,并获得物理学和数学学士学位。其它团队成员也有一些技术背景:Finn van der Velde 拥有计算机科学学士学位,具体来说是人工智能,离开了拉德堡德大学的人工智能硕士课程,就像他的“从事人工智能安全工作”一样。 LinkedIn 个人资料显示。Derek Allen 会编程。Kirchner 表示,一名兼职队员丹尼斯现在正在攻读人工智能硕士学位。

Stop AI 的 Sam Kirchner(左)和 Guido Reichstadter 在 Silverstone 咖啡厅

它们坚信,人类的思维应该始终处于智力领域的前沿。

Stop AI 为了让公众知道旧金山的人工智能技术公司承认,通用人工智能虽然有造成人类灭绝的风险,但仍在推动相关研发。一些专家甚至预测,今年可能会出现通用人工智能。他们强调,人工智能危险性很大。所谓的人工智能安全只是想象,不能通过实验证明它不会对人类造成伤害,类似于人类造成其他物种灭绝的情况。此外,通用人工智能也可能对民主制度造成永久性破坏,同时造成大规模下岗,使许多人失去人生目标。。

行业对人工智能的发展有不同的看法。一些从事人工智能工作的人认为,通用人工智能的研发 / 超人工智能(AGI/ASI)可以帮助解决癌症治疗、气候问题等难题。但是 Stop AI 反驳说,这种R&D在不能保证它永远安全、不危及人类生存的情况下毫无价值。毕竟从实验的角度来证明它的安全是不可能的。

当前,关于通用人工智能的研发和限制存在着诸多争议,其未来趋势引起了社会各界的关注。

值得注意的是,到目前为止,Stop AI 已经筹集了 6685 美金资金。

AI 发展争议:期望与恐惧并存

"...我们正试图永久禁止通用人工智能(AGI)的发展,”Kirchner 在接受 The Register 面试时说。”粗略地说,AGI 它是指在所有技术领域都比所有人类专家更强大的系统。

AI 杰弗里·辛顿,大神 (Geoffrey Hinton)曾经预测过,未来 20 今年人工智能超越人类智能的可能性很大。 50%。和其它人工智能反对者一样,Kirchner 还担心人类会失去控制。

Kirchner 对于人工智能发展的焦虑并不是个案。埃隆·马斯克早在语言模型爆发之前 (Elon Musk)在 2014 2008年曾经提到,使用 AI,就像“召唤”魔鬼一样。...

2014 2000年,当马斯克在一次公共场合谈到人工智能的发展时,他说:“我认为我们应该对人工智能非常谨慎。如果让我猜猜我们最大的生存威胁是什么,很可能就是这样。(AI)。”

伴随着人工智能技术的不断发展,人们对其潜在影响的看法呈现出两极分化的趋势,既有深切的担忧,又有肯定的积极作用。许多人认为意识是一种极其复杂和独特的情况,人工智能是无法企及的。本质上,它只是一个统计计算设备,缺乏感觉、情绪和理解能力。所有的行为都是按照程序执行的,这与人类的自由意志有很大的不同。虽然目前有人工智能 “安全性” 争论此起彼伏,但很多人对其安全的具体范围仍然感到困惑。

目前,人们对人工智能的焦虑主要集中在两个方面。第一,人工智能产生虚假内容的能力会对内容造成严重危害。在政治领域,虚假信息已经泛滥,人工智能的介入可能会使情况变得更糟,从而引发法律问题。例如,无辜的人被误指犯罪,而有罪的人被证明不在场。在金融经济领域,也可能导致欺诈、敲诈等问题。而且,人工智能有很多潜在的危害社会的方法,很多还有待发现。

第二,人工智能可能导致大规模下岗。。以好莱坞编剧罢工为例。编剧害怕自己会被人工智能产生的剧本所取代,尤其是当他们过去的作品被用来训练人工智能引擎的时候。同样,艺术家也担心人工智能产生的图像和音乐会取代他们的创作。此外,像体育比赛摘要这样的常规工作几乎肯定会被人工智能接管。

然而,人工智能也表现出很大的潜力。在医学领域,人工智能可以帮助医生更准确地诊断疾病,预测疾病的发展方向,甚至帮助开发新药。例如,一些人工智能系统可以快速识别医学图像中的异常,提高癌症等疾病的初步诊断率,为患者争取宝贵的治疗机会。

在交通领域,自动驾驶技术作为人工智能的重要应用之一,有望大大提高交通的可靠性和效率。无人驾驶汽车可以通过传感器和算法实时感知周围环境,做出更快更准确的驾驶决策,减少人为因素造成的交通事故。同时,智能交通系统还可以增加交通流量,缓解拥堵,降低能耗。

当前,人工智能技术不断创新,如何平衡其发展和潜在风险,已成为全社会亟待考虑的重要问题。

参考链接:

https://x.com/liron/status/1803435675527815302?t=GM7jv516WqvRA_q44vEBzQ&s=19

https://www.ktvu.com/news/parents-openai-whistleblower-want-outside-investigation-sons-death

https://www.ktvu.com/news/parents-openai-whistleblower-want-outside-investigation-sons-death

本文来自微信微信官方账号“AI前线”,作者:冬梅,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com