与郭毅可对话:AI趋近“全知”,人类会陷入精神荒芜吗?

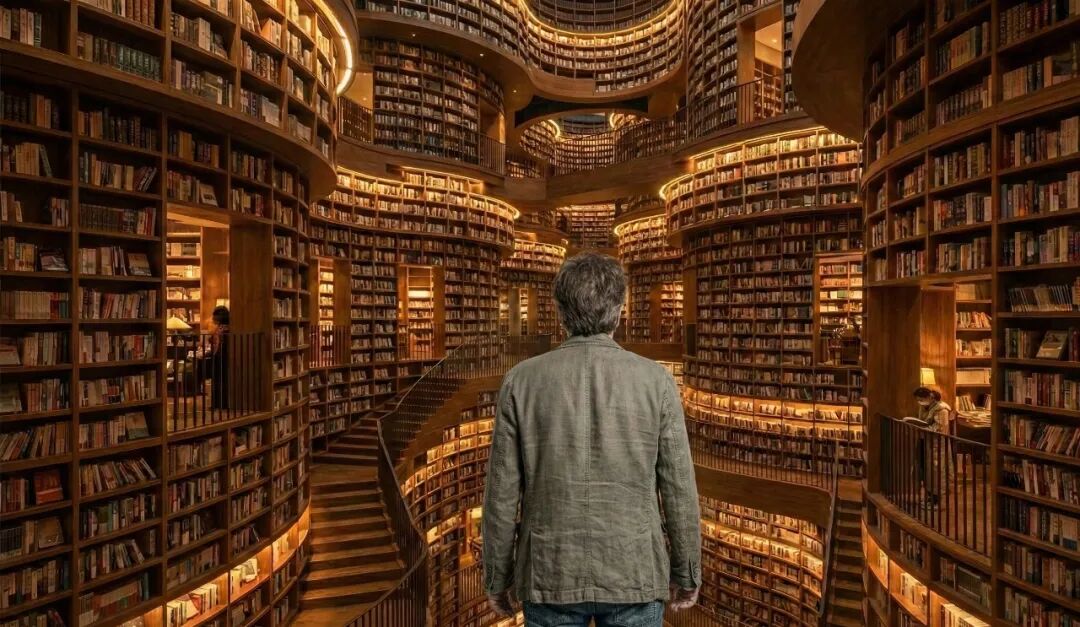

1944年,阿根廷作家豪尔赫·路易斯·博尔赫斯在《巴别图书馆》里,为人类构建了一个由无数六角形回廊组成的“全书图书馆”。

一开始,它是神谕的象征。人们沉浸在“万物皆已写就”的兴奋中,耗尽一生去寻找那本能解释宇宙真相、甚至个人命运的“辩护状”。

可当狂欢结束,真相浮现:在几乎无穷无尽、由乱码构成的废纸堆里,找一行有意义的文字,概率小到几乎不存在。

信息的极度过剩,不仅没点亮智慧,反而用噪声淹没了意义。

博尔赫斯笔下的旅行者在循环往复的卷册间穿梭,看穿了那令人绝望的循环。他预言人类终会灭绝,而图书馆永存——“青灯孤照,无限不动,藏有珍本,默默无闻。”

八十多年后的今天,这个隐喻跨越时空,精准触动了生成式AI时代的神经。

我们正处在知识饱和的临界点:当算法能瞬间穷尽文字的所有组合,我们是在挖掘通往真理的沃土,还是在加速走进一片精神荒原?当一切都能生成,是否意味着一切都没意义?人类智慧的护城河在哪里?我们该如何与AI共存,并用它创造真正有价值的内容?那些记录人类“不完美灵魂”的文学与艺术,会不会成为我们最后的精神庇护所?

图片由AI生成

带着这些关于创造、教育与存在的疑问,在高山书院十周年活动现场,我们和香港科技大学首席副校长、英国皇家工程院院士、中国工程院外籍院士郭毅可深入交流了近两小时。他不只是人工智能与计算机科学领域的学者,从事人工智能、数据科学及其在科研与教育体系应用的研究,还长期推动AI与跨学科创新的融合。

在郭毅可看来,AI不会简单“淘汰人”,而是重塑工作结构与分工方式,很多职业会转向更高层次的人机协作与复杂决策。

谈到人工智能的社会意义时,郭毅可进一步提出,人工智能的价值不只是提高效率,还可能重塑组织结构和社会结构本身。所以,他一直反对把AI仅仅当作工具或工程问题,强调它对教育体系、人才培养模式以及制度设计的长期影响。他也多次指出,人工智能不应被视为计算机学科的简单延伸,而是一门天生需要跨学科融合的新型学科。

以下是本次采访的实录,希望能给您带来启发:

Q:近年来,大模型的发展让人想到博尔赫斯小说《巴别图书馆》里描述的场景,一个包含所有知识的无限图书馆。在这样的时代背景下,如果人类获取任何答案都只需0.1秒,“提问的能力”会不会成为我们最关键的智力护城河?

郭毅可:要是人工智能的发展能把世界上所有文字记载的事实或知识压缩成一个模型,提问时生成它认为正确的回答,这就是你说的“0.1秒获得知识”。

这里我们得先明确知识的定义。知识是有共识性的认知,而“共识”本身是统计学概念,也就是大多数人同意。

大模型的“压缩”过程,本质就是寻找统计意义上的共识。从这个角度说,大模型在很大程度上生成了和我们定义的“知识”相符的内容。

所以,费力记忆和构建个人知识体系的重要性似乎在降低,因为我们有了“副脑”。现在,关键问题变成了“retrieval”——怎么获取你想要的东西。这取决于“你想要什么”以及“你为什么想要它”。

学会提问变得很重要,但这并不容易。浅显的问题只能得到浅显的答案。只有问题提得有特色,得到的答案才可能更有价值。

但比提问能力更重要的,是和机器的“交流能力”。你问机器十次,它可能给出十个不同的回答。

你得从中判断哪个是对的,它们之间有什么异同,以及为什么不同。最精彩的不是一次性的问题,而是在多轮对话中,不断提高对信息和知识的精度要求。

因此,我觉得和机器的交流能力,才是未来最重要的能力。

Q:和AI提问与和人类提问,方式上有本质区别吗?如果人类越来越习惯从AI那里得到加工好的结论,思维会不会因此萎缩?

郭毅可:没有太大的本质区别。唯一的不同可能是,和你交流的AI知识量非常丰富。和人聊天可能会没话说,但AI总能继续对话。关键是,你要判断AI生成内容的稳定性和内涵。人是主观存在,AI是客观存在,你怎么认知它的回答,会带来不同的感受。

至于思维会不会萎缩,这取决于使用者自己。

为什么你觉得去图书馆做很多功课不算“偷懒”,用AI获取知识就是“偷懒”呢?这只是获取知识的途径和能力变了。恰恰相反,这对你提出了更高的要求——你必须时刻对AI给出的内容做出反应,这是真正的“对话”,不是被动的“被教育”。

所谓的“AI幻觉”,其实人类的“幻觉”,也就是主观臆断,要多得多。正因为知道对方是机器,我们反而更能产生怀疑和批判精神,这会让人更聪明,而不是更懒。那种认为“更容易获取知识会导致大脑萎缩”的观点很天真,因为它还是用人与人交往的逻辑来想象人与机器的交往。

功能的转移是必然的。比如,我们现在记不住电话号码,但把记忆的精力转移到了推理等其他能力上。我们打字快了,认识的单词量可能更大了。我不会打算盘了,但会编程序了。这不是萎缩,而是能力的进化和迁移。

Q:现在网络上有很多“不是……而是……”这类明显有AI痕迹的句式,您觉得这是好事吗?当AI能写出比普通诗人更“像”诗的文字,人类文明中哪些文学作品是AI永远达不到的?

郭毅可:AI写的和AI与人共创的,是两个完全不同的概念。如果一个人知道怎么和AI协作,他们一起创作出的文章可以很有深度。AI知识量丰富,如果使用者有判断力和被启迪的能力,就能创作出很好的文章。

我最近看到一个微信号,作者的文章就是和AI共创的,写得非常好。比如,她可以提出“意识的物理性原理”这样的命题,这是个很宽泛且很难找到人类对话者的话题。

但AI能根据这个命题和她展开对话,最后形成一篇很棒的文章和观点。这才是正确使用人工智能的方式。AI对人的智力、意识、行为有没有帮助,归根结底是人的问题,不是机器的问题。

所以,我非常提倡和鼓励学生正确使用AI。当然,像写欢迎词这类格式化的内容,完全可以交给AI,它甚至会比秘书做得更好,因为能自动搜索相关信息,写得更全面。

Q:您能总结一下什么是“正确使用AI”吗?

郭毅可:正确的使用方式,是把AI当作知识渊博的讨论伙伴。你既要尊重它,也要怀疑它。你要向它提出真正有意义的问题,比如“意识的物理性本质是什么?”或“你怎么看待意识的量子性”。

AI会为你总结相关观点,然后你要基于它的回答分析:哪些是正确的,哪些有启发性,哪些完全有问题。对于你认同的,可以当作知识的补充;对于有问题的,可以继续探讨、否定,甚至和它争论。

目前AI的难点在于它还不太会“争论”,因为没有自己的观点和价值观。但随着技术发展,我相信AI会逐渐具备争论的特性。

Q:按照目前主流的Transformer技术路径,AI能进化出自己的观点甚至情感吗?很多人认为它只是“数据的压缩”,无法拥有真正的情感。

郭毅可:当然可以。当AI的推理能力越来越强,它就开始形成自己的观点了。通过强化学习,我们告诉它哪些推理结果值得欣赏,它就会慢慢形成一种观点。这观点一开始是你教给它的,但如果机器开始“自己教自己”,就会慢慢形成自己的观点。

至于情感,为什么AI不能有情感?情感是被感知的。当你觉得和它说话舒服了,情感不就产生了吗?罗永浩和“豆包”吵架,就证明AI可以进行情感对话。

我们不应该先入为主地认为“机器没有情感”,而应该思考如何让机器做得更好,让它的情感能被我们感知到。这在技术上不难,本质上就是把语言的语义通过学习映射到语音的频率上。

我们人类总喜欢把自己放在第一位。假设如果有造物主,他造了我们,我们现在也在造机器。凭什么我们有的东西,机器就不能有呢?

Q:那么,对于像新闻这类对客观事实记录要求很高的职业,AI的出现是否意味着职业意义的消失?

郭毅可:新闻记者的素质要求会越来越高,而不是消失。因为有了AI这个工具,你的知识面会更广,能问出更精彩的问题,报道也会有更深刻的视角。你的能力被增强了。但如果你坚持用现在的方式工作,就会被淘汰。这就像你原来是开马车的,现在有了汽车、飞机。你如果只坚持开马车,自然会失业。但如果你能转换技能,去开汽车、飞机,能力就提升了。这是技能变化的问题。

Q:您对AI技术的发展一直很积极乐观。您认为它有负面影响吗?我们需要防范它对人类产生“敌意”吗?

郭毅可:悲观有用吗?没用。它一定会继续进化。所以我们不需要悲观,而是要“进化你自己”。这不是乐观或悲观的问题,而是清醒地认识现实。

人类自身之间也有敌意。AI的敌意,本质也来自人类。如果我们都充满敌意,教出来的AI有敌意也很正常。但反过来想,如果人类意识到,我们之间的敌意可能会被第三方(AI)利用,最终导致共同毁灭,那么我们或许会因此学会消除彼此的敌意,这也不是坏事。

作为科学家,我认为技术上没有“很难”的事,只有我们自己不够聪明,或者不愿去做。只要想得到,并且愿意去做,就没有做不到的。

Q:在您看来,下一步AI最值得期待的进化是什么?您对AI发展很乐观,是否认为AI行业过热或有泡沫?

郭毅可:我期待它能像聪明的人一样,越来越聪明。我们变得更聪明,然后再带着它一起迭代。

至于预判它的迭代速度,取决于你的目的。如果你想赚钱,那是另一种预判方法。训练大模型是极少数公司的事,而且每次训练都应该有明确目的,比如降低推理成本、让模型更紧致、或知识更丰富。过去那种为了“打分”而训练模型的模式,是巨大的资源浪费,现在不会这样了。大部分人是在应用模型,在模型基础上创造价值,比如提升模型的质检能力、推理能力或自我进化能力。研究、制造和应用会慢慢分开,像“百模大战”这种愚蠢的事情不会再发生了。

任何事情都从泡沫开始,既然是泡沫,就说明它有意义。但泡沫破裂是正常的。我认为泡沫可能不是一下全破。戳破一类泡沫很容易,比如DeepSeek一出来,就没人再做那种纯粹堆参数的大模型了。技术道路一旦准确,接下来就是效率的迭代,就像摩尔定律一样。

感谢高山书院对本文的贡献

本文来自微信公众号“腾讯科技”,作者:郭晓静,编辑:徐青阳,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com