谷歌披露大模型能耗:一次Gemini查询能耗仅0.24wh

2025-08-23

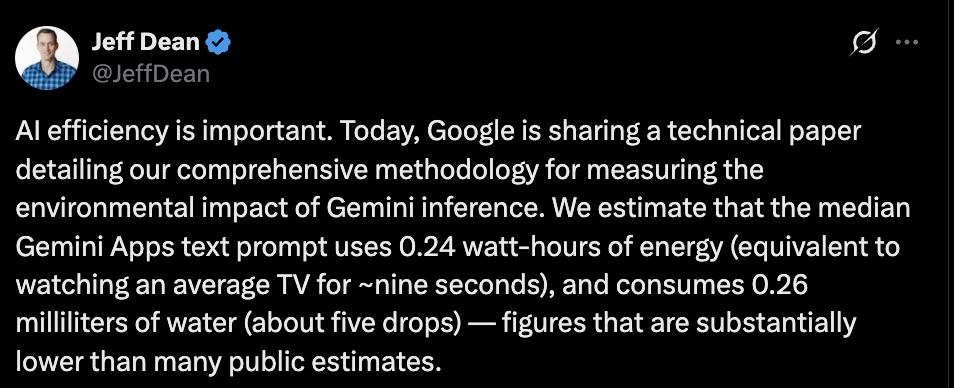

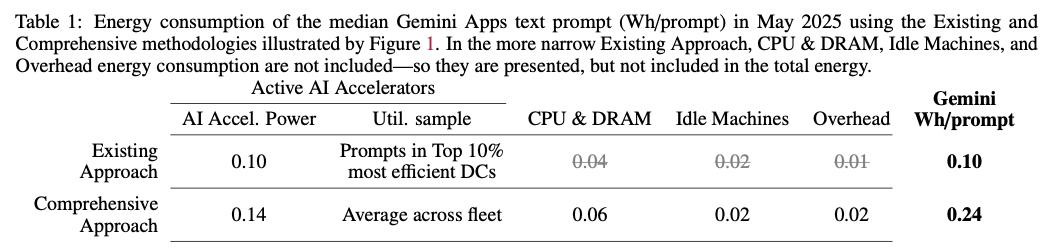

大模型耗电惊人的舆论甚嚣尘上,如今谷歌用硬核数据强势回应。一次Gemini查询仅能耗0.24wh,相当于微波炉运行1秒,排放0.03 g CO₂e,甚至比人放一次屁还少,同时消耗约5滴水。(文中数据均表示中位数)

如何衡量AI消耗能源

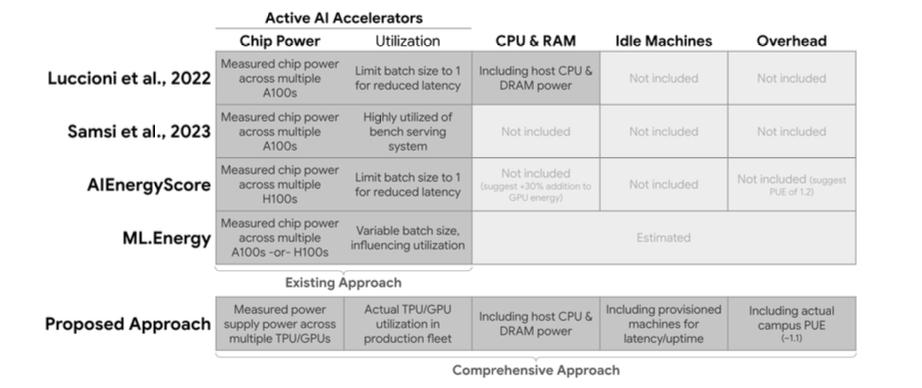

谷歌首先指出,目前许多关于AI能源消耗的计算反映的都是理论效率,而非大规模运行下的实际效率。

全系统动态功率

这不仅包括主AI模型在计算过程中使用的能源和水,还考虑了大规模运行下实际的芯片利用率,而该利用率往往远低于理论最大值。空闲计算机

为确保高可用性和可靠性,生产系统需要一定程度的预置容量,该容量处于空闲状态,但随时可以处理流量高峰或故障转移。这些闲置芯片消耗的能量必须计入总能源足迹。CPU和内存

AI模型的运行不仅依赖TPU和GPU等机器学习加速器,主机的CPU和内存同样在提供服务和消耗能源方面起着关键作用。数据中心开销

运行AI的信息技术设备所消耗的能源仅占整体能耗的一部分。支撑这些计算的基础设施,如冷却系统、配电系统以及其他数据中心开销同样会消耗能源。这部分开销能源通常用电力使用效率(PUE)指标来衡量。数据中心用水量

为了降低能耗及相关排放,数据中心通常会使用水进行冷却。随着优化AI系统以提高能源效率,其整体用水量也会随之自然减少。通过上述更全面的指标,谷歌得出一次Gemini查询的能耗为0.24wh,排放0.03 g CO₂e,同时耗水量约5滴。

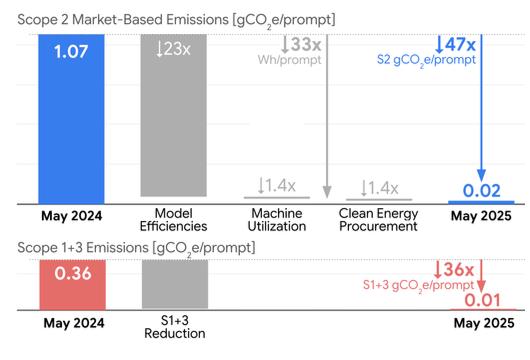

为什么Gemini消耗这么低

谷歌表示,Gemini显著的效率提升得益于其在AI开发中采取的全栈方法,从定制硬件、高效模型,到支撑这些模型运行的强大服务系统,他们在每一层都融入了效率优化。

参考链接:

[1]https://x.com/JeffDean/status/1958525015722434945

[2]https://cloud.google.com/blog/products/infrastructure/measuring-the-environmental-impact-of-ai-inference/

本文来自微信公众号“量子位”,作者:关注前沿科技,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com