王兴兴在浙江的宇树科技课程是什么?

封面来源丨

作为宇树科技创始人、90后企业家、“杭州六骁龙”之一的王兴兴的身份和标签越来越多。最近,他成了一名“老师”。

根据“浙江组工”消息,4月10日晚,人工智能通识与应用网络专题培训第四课邀请宇树科技创始人,CEO、以“机器人产业现状及发展趋势”为主题的CTO王兴兴,用自己的亲身经历分享了机器人产业发展案例,从不同角度描述了因地制宜发展新生产力的经验。王兴兴不是一个吝啬分享的人。他一直活跃在知乎,分享他注意到了Tesla 机器人 Optimus 设计细节,告诉自己大一假期怎么样? 200 元手摩擦了一个双脚型机器人,回答 2021 2008年春晚机器牛与波士顿动力机器牛的区别,注重模型训练的稳定性。但是他很少出现在讲台和直播间,所以他系统地和你分享他所理解的。 AI 和机器人。2025 春晚上,全国人民都看到了宇树科技的人形机器人,但是大众并不知道,在春晚上, 2023 多年前,王兴兴的态度一直是“绝对不做人形机器人”。究竟是什么扭转了他的想法?在这次分享中,他也首次正式阐述了背后的探索。他对 AI 与机器人一起理解,具有强烈的“王兴兴”特征——建筑 AI 就像盖房子一样,逻辑和 Transformer 多头注意力机制在结构中的底层非常相似。他的思维是跳跃的,在直播中,他的嘴总是跟不上他的大脑。因为他走过了学习的弯路,他一遍又一遍地建议孩子们可以在这样的平台上“玩”。AI。在演讲中,王兴兴还向浙江干部解释了“接地气”的语言和概念 AI 与机器人共享一些技术,并分享自己对行业的分析与思考。根据王兴兴的直播整理,本文的核心观点如下。

人形机器人的发展还比较初期,即将在工厂或家中使用,在全球范围内仍然是一件不现实的事情。

2. 人类所能做的事,理论上人形机器人都可以做。

目前AI入门基本为0门槛,小学生不用花钱就可以玩。如果你从小玩十年,你肯定可以玩得很好,不需要任何心理压力。

4.一般来说,深度神经网络模型的构建与建造房屋非常相似。当我们建造房屋时,我们只需要使用现成的砖、水泥和钢筋来建造它们。你可以通过将其中的一些模块放在一起来构建一个神经网络。

5. AI系统与逻辑判断的本质非常接近。目前,大语言模型是基于 Transformer 在结构中多头注意力机制的基础上,与逻辑判断十分接近。

下面是王兴兴共享记录(未经本人批准删除):

1. "我们绝对不做人形机器人"

我是宇树科技的创始人兼首席执行官王兴兴。我们公司成立于2016年,到目前为止已经快9年了。早年主要做高性能机器狗,2023年开始做人形机器人。

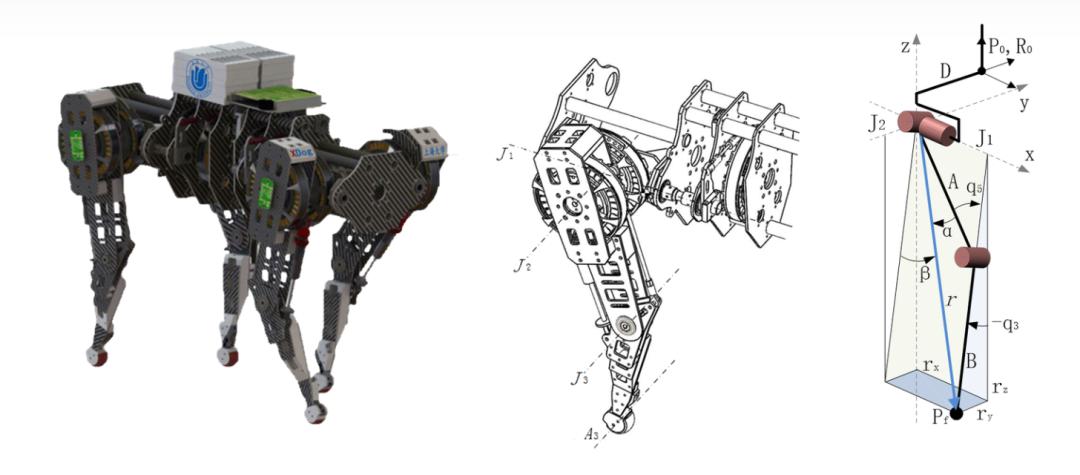

从2013年到2016年,小型纯电驱动的四足机器人XDog在上海大学学习期间被制造出来。该机器人开辟了全球低成本、高性能足式机器人技术标准的先河,高于BD(Boston Dynamics,早年公布的美国波士顿动力公司。

为何这么说?

这个机器人本身的成本比较低。大概在2013年的大学里,我想到了这个技术规范,觉得值得商业化,于是就想着要不要辍学创业。听了很多辍学创业的故事,我们这一代人长大了,当时我也萌生了这个想法。但当时我只是想了想,因为当时没有生产商品,也没有资源和资金。

从2013年到2016年,我制作了这个机器人。2015年,我带着这个机器人在上海参加了一个比赛,获得了二等奖,赚了8万元。因为R&D的投资大约是1~二万元,所以这也算是我赚的第一桶金。

刚参加比赛的时候,这个机器人只做了一半,比赛的时候还在慢慢做。决赛的时候,这个机器人基本上可以下床走路了。我一个人做了这个机器人涉及的电子控制技术、电路板、控制算法、机械结构等技术,所以即使我花了更多的时间,我也得到了很好的结果。

2016年左右,我们在世界机器人圈火了。有些人愿意买我的机器人,有些人愿意投资,然后他们离开公司创业。

众所周知,近年来,四足机器人和人形机器人在国内外都很受欢迎。那一阵子,许多人使用了MIT。 Cheetah mini(麻省理工学院开发的四足机器人)开源方案。该方案于2018年开源。开源后,国内外很多公司都用它的方案做机器狗和人形机器人。

实际上,我在开源方案中使用的电机都是一模一样的。2015年左右,MIT教授发现像我这样的学生也可以用这个低成本的计划做一只性能更好的机器狗,于是他又做了一个计划,然后开源了。

正因为如此,在过去的几年里,我们公司在全球范围内的认可度相对较高。

那是一件很难得的事,也是时代给每个人的机遇。在许多领域,要在世界范围内获得真正的知名度或认可度是非常困难的。很多品类的公司都做了这部分市场。即使后面的产品价格很低,性能很好,很多情况下大家都不同意,认为你不是开创性的。但是只有我们这一领域,由于我们公司的技术方案、产品等,在全球范围内做得比较早,人们对我们的认可度一直很高。

宇树于2023年初开始制造人形机器人。

我一直很喜欢机器人。2009年大一的时候,我做了一个小双脚机器人,大概花了200块钱做了那个机器人。但是做好之后发现当时的技术效果并不理想,所以很多年都没有再做人形机器人。

2019年和2022年,有人问我:“你们公司想成为人形机器人吗?”面对这些问题,我直接给出了否定的答案,说“我们永远不会成为人形机器人”。就当时AI技术和工程技术的发展而言,做(人形机器人)是比较吃力不讨好的,效果不太好,而且比较贵。

那么为什么宇树还在2023年大力做人形机器人呢?

原因比较简单,就是在2021年~整个机器人和AI技术在2022年取得了快速进步。特别是海外几家大型巨头公司,更注重和倾注人形机器人。简单来说,需求已经建立起来了。人们更注重人形机器人,更喜欢人形机器人,整个AI技术几乎到了一个临界点。

这是一个很好的时间节点,我们判断。

你可能无法想象,在宇树成为人形机器人之前,有人会在2022年底要求我们下订单。在我们做之前,有些人愿意购买我们的人形机器人,所以他们认为这是值得做的。原因也很简单,没有大家想象的那么复杂。

2023年8月,我们发布了第一个人形机器人。这个机器人大约花了半年时间,效率非常高。2023年下半年,我们完成了小批量生产。记得2023年10月左右,我们把机器人送到了美国,效率还是很高的。

为何我们的效率会更快?

以前我们做过机器狗的积累,涉及到的关键电机,电池,动力装置,控制算法都是现成的。

可以看出,我们公司在中国做人形机器人并不是最早的,甚至相对较晚,但目前我们的出货量和性能在全球竞争激烈。因为在做机器人的时候,我们在硬件、软件、生产等方面都有很深的积累。

当时发布的时候,这个H1机器人刷新了几个指标。去年3月,H1实现了原地空翻,是世界上第一个可原地空翻的全尺寸电动驱动人形机器人。去年5月,我们发布了第二个人形机器人G1。它看起来好多了,它的关节自由度、关节伸展和传感器都很先进,价格也比较低。

2. 为什麽要做人形机器人?

现在,人形机器人的发展还是挺早的,即将在工地或家中使用,在全球范围内仍然是一件不现实的事情。但是像这个机器人,我们现在有些市场已经开始做了,比如一些科研教育,AI公司和一些休闲活动的展示。

到目前为止,我们仍然在网上争论为什么我们是人形机器人。有人同意,也有人反对,但从全球头部公司的创始人到政府,我们都非常关注这一块。这种趋势是不可阻挡的。

结构最简单的通用机器人(1)

早年大家做的AI都是单功能AI,比如识别一个数字,识别一个文字,识别一个音频。但是到目前为止,每个人都希望一个AI模型能够将所有的功能集合在一起,它可以自由安排,做任何事情,这是一个大家都在推广的通用AI。

机器人也是如此,就是我们需要一个与通用AI相匹配的通用机器人。因为我们做了很多特殊的设备,比如工厂里的,家庭洗衣做饭,现在应该用普通机器人配合普通AI。当你回头看的时候,你会发现人形机器人是最简单的普通机器人。

也许许多人认为人形机器人非常复杂。实际上,人形机器人一点也不复杂。怎么了?

人形机器人,你可以认为是将几个关节与几个连杆组合在一起,形成一个人形机器人,没有比人形机器人更经典的通用机器人了。不然的话,如果你想做一只蜘蛛,做成其它形状,难度实际上比做人形机器人还要大。甚至,如果未来通用AI非常成熟,也许有一天,比如一个孩子在垃圾堆里捡了几个电机,捡了几个连杆放在一起,下一个程序就可以跑了,一个机器人就形成了。

人们更喜欢看起来像人类的机器人,更有情感价值。

因为它看起来更像人,除了机器,它还有附加值。比如表演,服务,去一些人可以去的地方。像表演这样的功能其实包含了情感价值。

方便收集数据(3)

如今,AI是由数据收集驱动的,数据质量更好,AI效果更好。现在数据收集只能靠人,此时一定是看起来像人物品收集比较好。若要映射到一只蜘蛛、一只猪或其他形式的机器人上,实际上很难投射,将这些数据交给这种机器也很难使用。假如这个机器人长得很像人,那么最终收集数据和训练数据就会变得很容易。

(4)可以处理各种需要人处理的事情。

在当前的自然环境中,人的越障能力非常好。例如,人们可以通过一些非常狭窄或崎岖的区域,但其他形式不一定。作为灵长类动物,人的通过能力和运动能力都很优秀。所以这也是为什么做成人形机器人比较好的原因。比如你现在把一个机器人做成一辆车或者做成其他形状,你怎么能把一辆车翻过来呢?

人类可以做的事,理论上人形机器人可以做。上述四点是我个人认为比较直接的原因。

3.目前国内外人形机器人行业的现状

在过去的一两年里,国家非常重视和支持机器人行业。从今年年初开始,特别是今年2月,包括整个机器人行业在内的国内人形机器人正在如火如荼地进行着。简单来说,不仅仅是我们公司,还有我认识的所有机器人公司。即使是过去亏损严重,无法支撑的机器人公司,今年的订单业务也很好,相关行业的表现也很好。很多传统行业的老板或者传统行业的人都开始想,我是否可以在工厂或者商店里使用机器人?需要和消费情绪都开始被点燃。也许里面还有一些盲目的成分。点燃需求端绝对是一件好事,但是每个人都应该保持一些抑制,因为目前大家想要的一些需求可能是机器人做不到的,可能会有一些误差。近年来,海外也一直很热,包括特斯拉、英伟达和其他头部科技公司都非常关注人形机器人。比如OpenAI,从去年开始,他就开始想做机器人AI,今年年初,他们自己也在招聘机器人硬件。但目前整个机器人AI还没有达到突破的临界点。目前机器人AI每个月都在进步,但还没有达到真正大规模应用于工业或家庭的临界点。现在有什么类似的情况?有点像ChatGPT出来前一两年,大家已经发现了这一技术方向,正在做的过程中,但是还没有做到。对一般消费者来说,也许如果你真的想要家庭使用,那就不能在下一两年内使用。当前机器人AI产业的发展情况如何?例如,如果你想在工厂、农业场景中使用机器人,或者像矿业这样艰苦或危险的场景中使用机器人,现在最大的问题是机器人AI还没有达到突破的临界点,但硬件是一个相对较小的问题。当然,目前硬件肯定还不够完善,但是这并不是一个限制因素。硬件方面的本体在某种程度上已经足够或可以使用,但是在不久的将来需要做得更好。但是这并不是一个实质性的问题,本质问题是机器人AI模型不够,机器人AI模型和目前的大语言模型不是一回事。我们可以简单理解为机器人AI模型更倾向于工作。

4. AI模型的基本逻辑规则

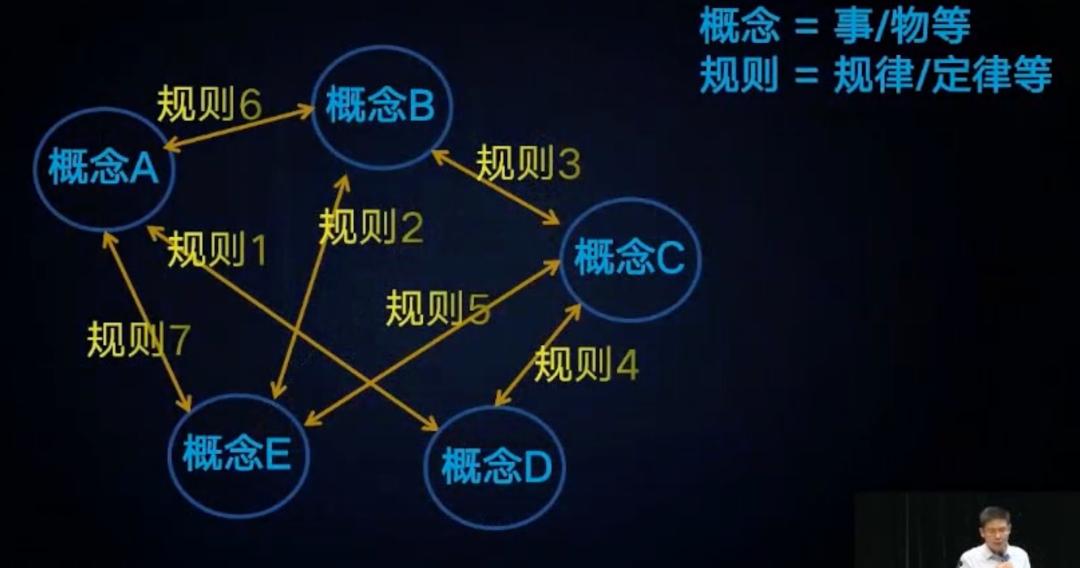

下面我简单介绍一下AI,方便大家了解。另外,家里有孩子的时候,我很鼓励小学或者初中的学生学习AI相关的信息。第一点,就是逻辑判断的本质。那是我高中时想到的一点。每个人在讨论逻辑的时候,比如这个人的逻辑思维比较好,到底什么是逻辑?总而言之,也比较简单,实际上是通过一些概念和规则联系在一起。比如有A、B、C、这几个概念和相应的很多规则,那么A和B有什么关系呢?B和C有什么关系?可以互相推导。所以很多时候,比如要学习一个新的知识点,其实也很简单。比方说我要学习新概念C的知识点,我只需要用自己比较熟悉的概念B和D重点知识来推导这一规则。通过这种方式,你对整个新知识点的记忆和理解都比较深刻,而且在某种程度上,你可以越学越快。再举一个例子,如果你学到了某个知识点,但是过了五到十年就忘记了,你也可以把概念B和概念C重新推导出来。在我介绍AI之前,我为什么要这么说?原因比较简单,目前整个AI系统和这张图非常接近。目前,大语言模型是基于Transformer架构中的多头关注机制,非常接近这张图片。

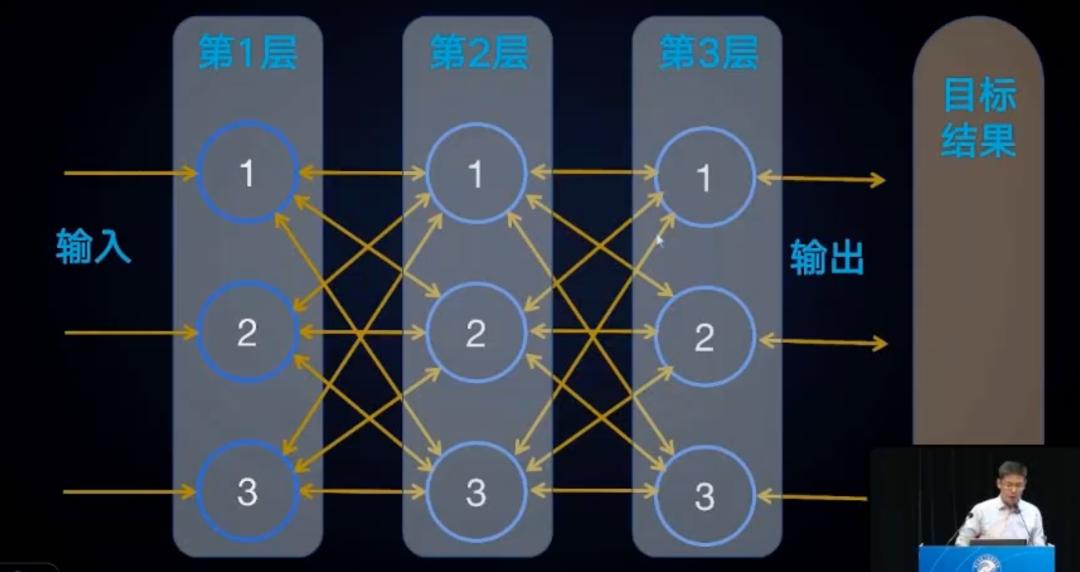

此外,目前的AI也采用了深度学习神经网络。也就是说,有一层层的神经网络,然后里面就有一层神经元,也就是一层神经元,二层神经元,三层神经元。另外第二层是神经元,一层是神经元,然后是第三层。里边每层之间都有一条线连接在一起,这条线实际上也很简单,就是全连接。该模型目前也是世界上使用最多、最基本的模型,称为全连接层。全连接层是什么?也就是说,每一根线都出来连接一次所有的线,也就是一把一、二、三连接一次,二把一、二、三连接一次。这是目前最常用的模型。

对神经网络核心原理的深入研究(1),来源:直播截图

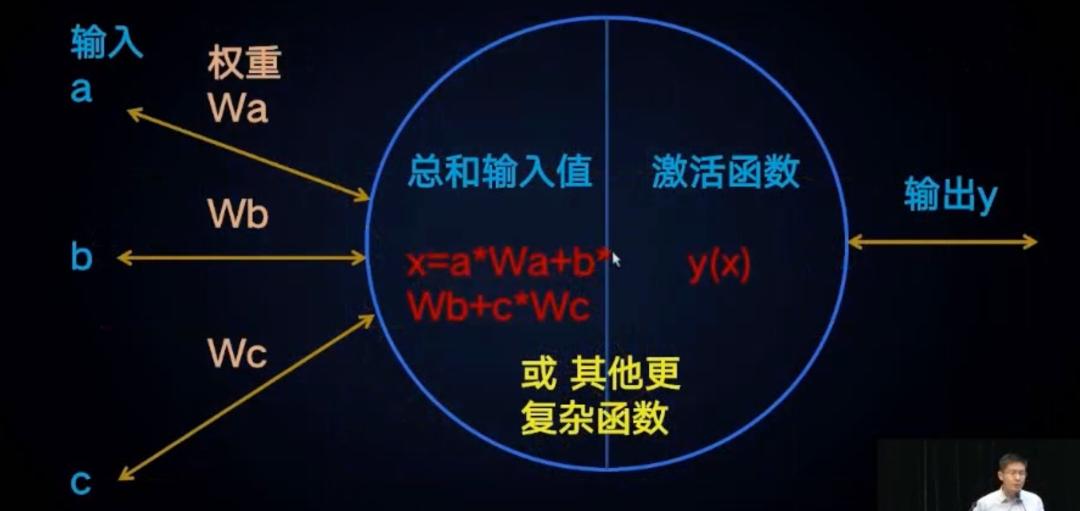

简而言之,就是一个圆圈里有一个数学公式。神经元最简单的结构就是输入输出。举例来说,输入a、b、c,导出有y,然后每一次计算,就是a,×Wa、b×Wb、c×Wc,乘坐它,然后添加一个激活函数进行输出。

对神经网络核心原理的深入研究(2),来源:直播截图

举例来说,每个人在玩AI的时候,都会输入一段文字,比如今天星期几?输入A、B、C,接着他算了一下,就把周几给了输出。接下来是每个数学公式。在某种程度上,你可以用任何函数来代替这个函数,而不是复杂的函数。所以,如果你想发表一篇比较简单的AI论文,你该怎么办?改变这个函数,然后做一些测试,测试哪个函数效果更好,然后你就可以发表文章了。现在最常用的神经网络就是这样,并没有大家想象的那么难,只是在实际应用中还是有些麻烦。

对神经网络核心原理的深入研究(3),来源:直播截图

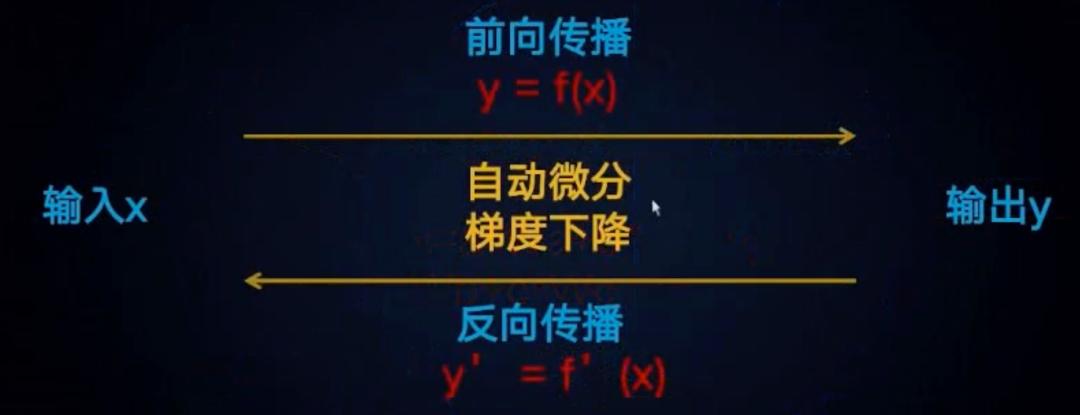

以下是前向传播和反向传播两个概念。正如刚才提到的,从输入A、B、C计算到导出,是一个前向传播的过程。简而言之,就是做一个数学函数,就是y,=f(x)。

前向传播就是训练好之后,我调用它,让它工作的时候再做一遍。那么我训练的时候怎么训练呢?这是反向传播。反向传播其实就是求导数,也就是y'=f'(x),这是一个自动微分的过程,也就是做了一个梯度下降。

怎么理解?比如我前面有一座山。我想爬山。有哪些更好的路线可以进山并找到?相对简单的理解是找出这座山的梯度(斜率)。因为我想看看这座山的哪个地方陡,哪个地方慢,哪个地方陡,哪个地方慢,然后我就可以找出这条路可以从哪里上下来了。

反向传播的导游做到了这一点,就是我们有很多山。反向传播导游后,我可以找出这些路径,也就是如何从y到x的路径搜索出来。

你可能会觉得自动微分比较复杂。其实你不需要做,因为有工具可以帮你做好。这就是我刚才提到的。鼓励小学生玩AI。很多情况下,你可以直接编程,而不需要安装软件。很多工具都是现成的。

5. 小学生还可以建立AI模型

PyTorch是目前常用的深度学习神经网络核心工具。。该工具是目前世界上使用最多的AI工具,也是一种开源工具。PyTorch这个工具有什么功能?首先,批量数据的处理和载入。目前,AI需要大量的数据采集训练。这个时候数据的管理和整理是一件很麻烦的事情,这个工具有数据管理和整理的功能。二是构建深度神经网络模型。以上我们也了解了神经网络的一些基本原理,那么我们该如何建立经网络呢?事实上,就像我们搭建积木一样,这个工具在搭载过程中已经结构好了。简单来说,你应该建立一个神经网络,这和建造一个房子非常相似。目前我们盖房子的时候,有很多砖、水泥、钢筋,已经现成了。你只需要把它们放在一起。如果你把里面的一些模块放在一起,你就可以自己构建一个神经网络。第三,自动训练。神经网络结构完成后,剩下的,比如自动微分和自动训练。你只需要“吊”一两行程序,整个过程都会自动为你完成。当你构建神经网络时,你会发现它就像一个积木。如果你把它放在一起,你可能会摔倒。所以在做一些实验的时候,如果你发现这个“积木”有很好的效果,那么你可以保存它。

如果你感兴趣,或者家里的孩子,我在这里推荐一些工具。这里有几个国内外的平台,只要打开网站注册就可以使用,少量使用它的GPU是免费的。只要打开网页,输入几行代码,就可以进行AI培训,包括现成的一些数据工具,这也是我自己用的比较多的工具。目前整个AI的入门门槛比较低,也就是基本0门槛,小学生不用花钱就可以玩。如果你从小玩十年,你肯定可以玩得很好,不需要任何心理压力。比如目前市面上的一些AI模型都是“摩天大楼”,我可以先盖个小房子,完全没问题。

那么,如果我现在真的想建一座摩天大楼,我该怎么办呢?我肯定需要图纸,对吗?目前,人们已经验证了更多使用的“图纸”。现在世界上最先进的AI模型架构,大家比较公认的模型建造方法,主要有以下三种。

首先,扩散模型。这现在主要用于什么?主要用于绘画,生成更美丽的图片,生成视频,最常用的是扩散模型。

扩展模型这个名字也很简单,很直观。扩散是什么?假如我有一杯清水,我会在这杯里点一滴墨水,墨水就会扩散。两个意思是一样的,就是我把一个有规律的物体扩散成一个有很多噪音或者噪音的物体,重新收敛成一个有规律的东西,这是一个扩散的过程。再举一个例子,比如一张照片本身就很清晰,然后变得很模糊,然后再反映这个过程,就变成了AI的一个生成过程。

但是现在看来,扩散模型我个人感觉还是有一定的局限性,所以现在主要还是画的比较多。

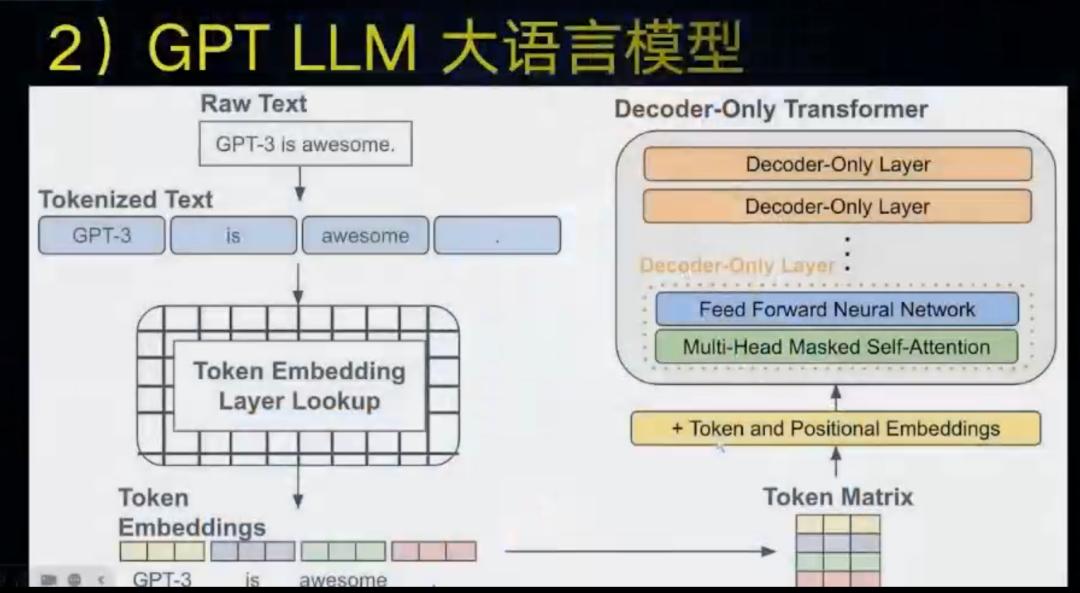

其次,以GPT为代表的LLM大语言模型。这种模式更主流。目前LLM的大语言模型基本都是通过Transformer结构构建的,就是双头注意机制。我稍后会详细介绍。

三是加强学习,PPO、GRPO等。当前,加强学习也是最主流的方向之一,比如我们的机器人使用加强学习。比如DeepSeek,目前大语言模型也在加强学习。

为何大语言模型需要加强学习?原因也很简单,因为传统语言模型的结构就是,训练数据集有多好就有多好。假如我的数据集不好,那么结果也比较差;我的训练数据集质量很好,那么我的训练效果也很好。但是,这是有极限的,输出结果不可能比你训练的数据质量更好。那么我怎样才能进一步提高AI模型的伤害输出呢?也就是说,强化学习是必要的。DeepSeek今年年初爆红,最大的一点就是很好地利用了强化学习。她们自己开发了一种强化学习算法,可以做得更好,比如一些数学推理。

个人认为,未来几年强化学习将成为整个AI的主流方向。

6. GPT LLM大语言模型,强化学习和VLA模型

(1)GPT LLM大语言模型

目前语言模型的结构比较直观简洁。每个正在做的人,包括我自己,都不搞语言模型。我们不需要太了解一些太深的点,只需要对一些基本点有一个大致的了解。

目前的语言模型,简单来说就是使用编码层和解码层(组成)。编码层,比如我打开加一个word文档,里面的每个汉字或者拼音都是用两个字节左右编码的,我可以用两个字节编码一个汉字。但是当你做AI的时候,它肯定是行不通的。目前我们做AI的时候该怎么办?首先,我们应该把一个代码、一个汉字或一个字母变成一个向量,也就是我想再编码一遍。比如“今晚有点热”这些汉字,每个汉字都被编码成一个向量。后面我会做双头注意机制。

什么是双头注意机制?也就是计算向量的相关性。

从某种意义上说,注意力机制就是寻求相关性。求好相关性后再导出,再解码,整个输出过程相对直观。我的每个概念或规则其实都有一个向量,每个概念只要求每个向量的相关性,就可以推导出每个向量之间的逻辑判断。

但是,如果你真的想做一个复杂的模型,肯定会涉及到很多公式问题。因为要建一个小房子,建一个摩天大楼,技术和工程上还有很多问题需要解决,工作量也比较大。

(2)加强学习(用战略模型和奖励函数代替模型反向传播偏差)

加强学习并非一种简单的算法,在一定程度上,加强学习是一种思考、概念的问题。

说得简单一点,强化学习就是试错。例如,如果我向前迈一步,我可能会摔倒。我遇到了什么情况?然后我保存了每次试错的最佳结果,只是丢了不好的结果。比如我在模拟环境中试错的时候,试了一百万次,一亿次,总会有一些好的结果,对吧?然后我会保存所有这些好的结构。

(3)具体智能模型VLA模型目前潜力最大?

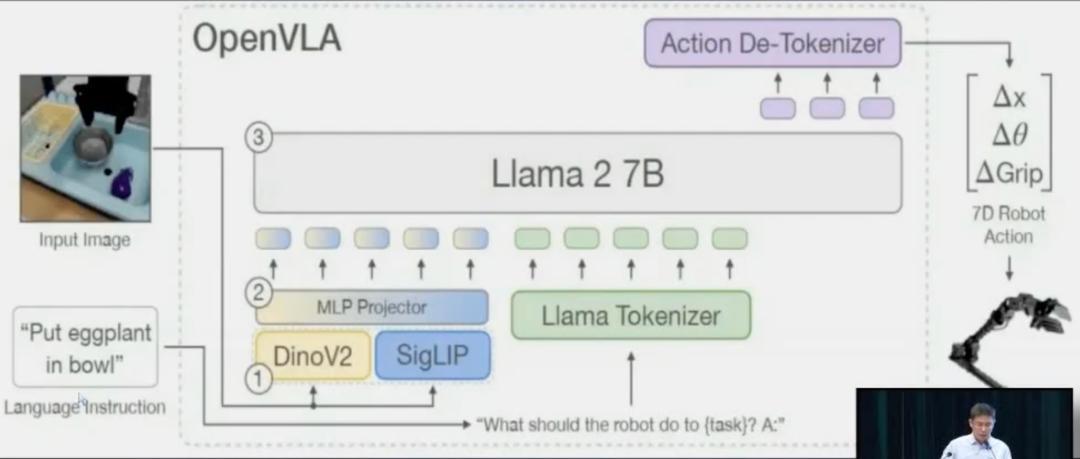

目前,VLA模型是整个具体智能模型的主流模型。在一定程度上,VLA模型是在语言模型的基础上添加一些物品。例如,在u200cLlama模型中,传统的语言模型使用文本,输入是文本,导出是文本,其整个结构非常实用。

既然可以输入文本,那么我可以编码文本,把一个汉字编码成一个向量,那么为什么我不能编码图片和图像呢?

这个想法也很简单,就是我在输入端加了一个图片或者一些视频编码器。我把它放在头上,然后把它和文字的向量放在一起,交叉注意力。

VLA,V就是视觉模型,L就是语言模型,A就是执行模型。什么是执行器模型?一般语言模型的输出是文本,在输出文本之前添加一个神经网络。比如最简单的就是我加了整个链接层,然后就可以导出一些机器的控制指令,比如关节的运动指令和执行指令。VLA的结构也比较简单直观。

7. 未来,真正的AGI需要实物机器人

现在智能机器人技术最重要的是什么?

首先是统一,端到端服务机器人大模型。也就是说,我们需要一个更好的机器人模型来做,这可能只是刚才提到的VLA模型,但是个人感觉VLA模型还是有很多局限性的。

其次,硬件成本更低,使用寿命更长,制造量更大。简而言之,就是要生产很多人形机器人,或者很多其它各种机器人出来,就要花费低廉,而且性能也很好。三是低成本,大规模计算。如果机器人数量达到一定规模,例如,当数百万或数亿人需要配置计算率时,计算率的低成本要求非常高。在许多情况下,当我们强调AI时,我们脱离了物理机器人来强调AI。我在这里想提出的是我去年一直提出的一点,那就是物理机器人对AI也很重要。这是我个人的判断,可能是错的,但这是我非常相信的一点。对于真正的AGI(通用人工智能)、对于真正的通用机器人来说,物理机器人是非常重要的。为什么“身体”很重要?如今,许多AI模型没有身体。它们与现实世界分离,无法很好地感知世界。它无法感知这个空间,感知桌子的碰撞等感受。举例来说,为什么梦里跑不快?比如我小时候睡觉做噩梦的时候,有怪物追着我,我在前面跑,但是我总觉得很难跑,但是跑不快。我在大学的时候想要它,理由比较简单,就是人在睡觉的时候,你的大脑和身体断了联系。醒着的时候,我们跑步的时候,每次跑到路上都有反馈,所以我知道我的脚踩在了地上。但是在做梦的时候,因为身体和大脑是断开连接的,我不知道当我碰到路上的时候,我会觉得我的脚碰到了气体,所以我跑不快。为什么要说这个?目前的语言模型是有幻觉的。有时候它说的话是错的,你不知道,或者你编了一些乱七八糟的内容。这种情况很像做梦,说梦。目前很多情况下,语言模型有点像说梦话,像做梦,迷失在虚拟环境中,与现实世界脱节。AGI需要参与与整个世界的物理互动,体验和理解人类的情感和性格等。目前AI发展很快,但发展速度还是一步一步来的。最后,希望大家相信,相信,尽量相信AI。

本文来自微信微信官方账号 “盒饭财经”(ID:daxiongfan),作者:YP,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com