Ilya再融20亿SSI估值300亿,20人王牌队首次曝光,超豪华阵容

Ilya团队再次获得20亿美元的新一轮融资,估值300亿美元。与此同时,SSI在以色列特拉维夫办公室的第一个研究小组成员透露,这个阵容非常豪华。

目前硅谷最受欢迎的投资,不是某个产品,而是一个人。

神秘初创SSI成立9个月,至今从未发布过任何商品,而是依靠Ilya撑起了整个台面。

SSI在WSJ最新融资爆料中完成了20亿美元的新一轮融资,估值超过300亿美元。

Greenoakss最新融资 Capital领先,该公司的估值也是去年9月50亿美元的6倍。

在此之前,Ilya明确表示,在开发超级智能之前,并不打算发布任何商品。

长期以来,我们只知道,除了Ilya,这家公司还有两家创业公司。——

Daniell是前苹果AI业务的风险投资者。 Gross,另一个是前OpenAI研究员Daniel Levy。

三位联创:Daniel Gross、Ilya Sutskever、Daniel Levy

外界对内部人员的具体信息知之甚少。

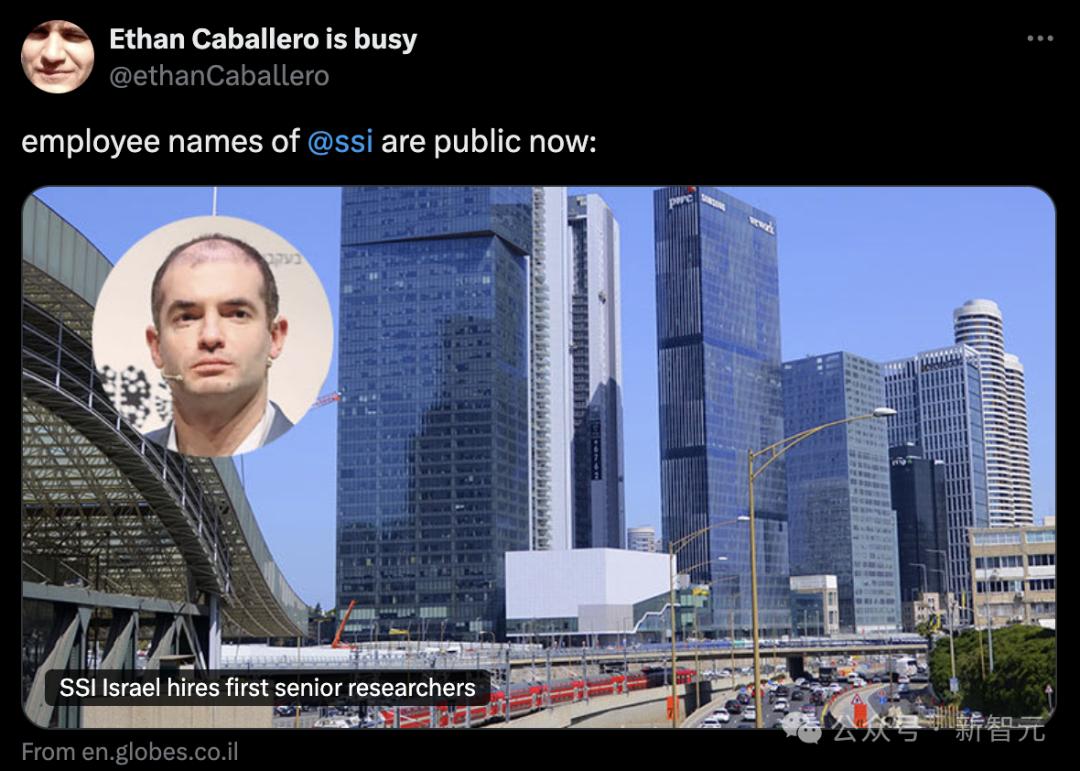

就在昨天,国外媒体Globes直接公布了一份SSI现任员工名单,并表示Ilya已经在以色列特拉维夫办公室悄悄成立了顶级研究团队。

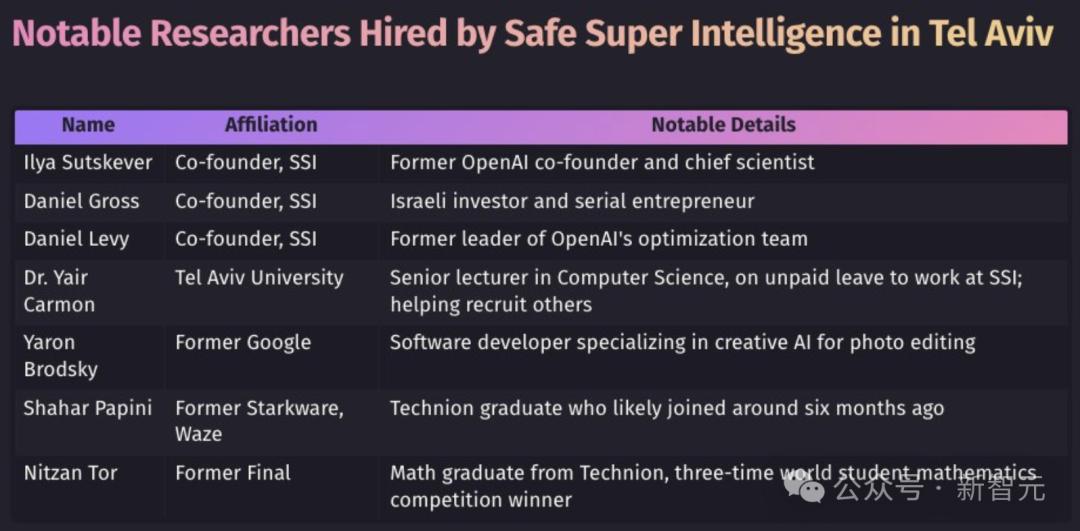

在这些学校中,有很多Yair,特拉维夫大学。 Yaron博士,Carmon博士,前谷歌研究员 Brodsky、Nitzananan数学竞赛获奖者。 Tor等等。

下一步,让我们一探究竟。

第一次公开的SSI神秘团队

特拉维夫市中心大厦SSI以色列办公室(Midtown Tower)。

企业刻意低调,员工不能在社交平台上透露自己的身份。

在特拉维夫,Ilya成立了第一个以计算机科学和数学为重点的研究团队,目标是建立公司的第一个AI模型。

这个团队的阵容,堪称奢华。

Yair领导者之一是Yair 作为特拉维夫大学计算机科学学校的高级教师,Carmon博士拥有斯坦福大学物理博士学位。

研究方向为机器学习、优化和统计,致力于使AI算法更加安全可靠。

现在,他正处于无薪休假状态,致力于SSI,并帮助招募更多的人才。

还有其它三个成员,也是行业中的佼佼者。

Shahar 作为以色列理工学院的毕业生,Papini曾在Waze和区块链公司Starkware工作,大约一年前就加入了SSI。

Nitzan 在算法交易公司Final担任计算机工程师之前,Tor是一位数学天才,曾三次获得世界学生数学竞赛荣誉。

从左到右拿着旗子,第三个人是Nitzan。 Tor

Yaron Brodsky是前谷歌软件开发者,致力于创意AI在照片编辑领域。

网民们也为此制作了一份总结表。

另外,团队还吸收了Google。 Research的几名研究人员和程序员。值得注意的是,SSI的招聘完全取决于SSI。「熟人推荐」,不要寻找猎头或人力资源公司。

现在,SSI已经暂停招聘,团队规模仍然在个位至十余人之间。

非常规的扁平化运行

在以色列特拉维夫和硅谷,SSIPalo 大约有20名员工在Alto的办公室工作,甚至不到OpenAI和Anthropic(10000) )的零头。

在LinkedIn个人信息中,这些人被要求不要提到SSI。

在进入SSI办公室之前,获得面试机会的候选人必须将手机放在SSI办公室。「法拉第笼」(Faraday Cage)里面。这个容器可以屏蔽蜂窝和Wi-Fi信号。

到目前为止,SSI平台上只有一个223字的使命宣言

就上述特拉维夫招聘的员工而言,他们在硅谷听起来并不出名。

因为,SSI的目标是寻找有前途的技术人员,而非那些有经验的人来回跳跃,并带走他们所学的知识。

据一位了解SSI的行业高管介绍,该公司的组织结构极其平坦,没有明确的团队领导,两个办公室的员工紧密合作共同项目。

这一非层次的方法,也许正是Ilya对创新和品质的向往。

他希望通过分散的方式,最大限度地激发团队的创造力。

SSI的愿景是宏伟而具体的:AI具有超强的开发能力,同时保证其安全。

举例来说,未来的SSI模型可以自行设计药物,改进生产材料,甚至帮助处理气候危机。

但是,Ilya一直强调,任何技术突破都必须以安全为前提。

他用了9年的时间,从OpenAI到SSI。

在加拿大读研究生的时候,Ilya因为一篇关于AI算法深度学习的论文而出名。

毕业后,他加入了谷歌。在2015年之前,Ilya做出了一个大胆的决定——加入OpenAI,成为第一批员工之一。

吸引他的是奥特曼和马斯克的愿景,即开发通用人工智能,一个可以在大多数任务中与人类相媲美的AI,为人类社会谋取利益。

同事们经常在OpenAI的时候开玩笑地称他为他。「先知」,他总是沉浸在对未来世界的思考中:拥有AGI的世界会是什么样子?如何保证这项强大的技术不会带来灾难性的后果?

那些问题,一直萦绕在他的脑海里。

OpenAI于2022年底发布了ChatGPT,这款AI聊天机器人迅速成为全球关注的焦点。

OpenAI中的他 在2022年的节日聚会上,曾经说过,「我们的目标是创造一个喜欢人类的AGI。」。

但是,随着ChatGPT的成功,OpenAI也逐渐从一个简单的研究实验室转变为一个更加注重产品和收入的公司。

这一变化,让Ilya和团队深感不安。

它们担心的是,企业对商业化的追求,会削弱对先进AI的投入,尤其是对AI潜在风险的控制。

同时,Ilya和奥特曼的关系也越来越紧张。

OpenAI于2023年11月上演了一场宫斗剧,董事会决定辞退奥特曼,因为他没能一直对股东大会保持坦诚。

然而,这一决定却遭到了内部的强烈反对,100多名员工威胁离职,甚至微软还要当接班人,提议雇佣奥特曼和离职员工。

最终,奥特曼在一周内被重新雇佣,而Ilya选择退出,尽管他的名字仍然在工作,但实际上他已经停止了工作。

Ilya直到2024年5月正式离职,并于6月与前OpenAI研究员Danielya公开离职。 Daniellevy和投资者 Safee共同创立了Gross Superintelligence。

不像OpenAI,SSI的目标更纯粹——超级智能开发安全。(Superintelligence)。

超级智能不仅仅是AGI的高级版本,更是一项更加复杂、更具潜力的技术。

Ilya很少公开露面,并在去年的NeurIPS会议上分享了他对超级智能的探索。

他告诉在场的1000多名研究人员,未来的超级智能系统可能是不可预测的,甚至可能有自我意识,为自己争取权利。

不过,他还说,「假如AI想要的就是和我们并存,那也不是一个糟糕的最终结果。」。

参考资料:

https://en.globes.co.il/en/article-ssi-israel-hires-first-senior-researchers-1001503535

https://www.wsj.com/tech/ai/ai-safe-superintelligence-startup-ilya-sutskever-openai-2335259b?mod=tech_lead_pos3

本文来自微信微信官方账号“新智元”,作者:新智元,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com