AI界的“海马体”:HippoRAG技术怎样让机器像人类一样思考?

上个月,谷歌发布了AI搜索功能——AI overview。这个功能本来应该是谷歌最后一站,发誓自己也可以在AI时代称霸搜索。结果出来才两个星期,很多哭笑不得的例子都被网友挖出来了。

举例来说,一位网友搜索“自制披萨奶酪容易掉下来怎么办?”AI Overviews 回答:“在酱汁中加入约约 1/8 杯子里的胶水就可以了。”它甚至特别强调使用无毒胶水。

而且这个离谱的答案不是AI。 Overviews自己编造的是Reddit上的一个客户。 11 多年前在评论中获得的错误信息,只是遗憾的是,它没有理解人类的幽默。不但如此,它还输出了例如 “人们每天至少吃一块石头来获得营养”,“兔子曾经在NBA打过球(球员名字里有rabbit这个词)”,看似合理,却经不起深思熟虑的答案。

AI overview的翻车性能也不例外,这反映了LLMs在信息检索方面的局限性:LLMs会根据输入信息生成相应的答案,但是有答案并不意味着答案是正确的。这里可能包含虚假信息和恶意内容。

RAG(搜索增强生成)一直被业界认为是处理类似问题的“救援者”。它可以通过搜索外部知识来克服LLMs的局限性。它的原理是在客户提问时关联外部数据库,并将其反馈给他们。 LLMs,提高其文字生成能力。但是最近越来越多的数据表明,RAG不但没有消除幻觉,反而不断被骗。

Chiragrag教授,美国华盛顿大学专门在线搜索。 Shah认为,AI Overviews 里的 通过使用RAG技术来处理LLMs的局限性,Gemini很可能会遭受RAG的损失。假设Google确实使用了RAG技术,那么它就有效地证明了RAG在这个阶段有很大的缺点:它可能能够准确地检索信息,但是它无法确定信息的真实性。

但是假设我们给RAG更多的联想空间,更多的判断根源,这是否可以避免这样的问题?

如果AI遇到多跳难题:RAG技术的崛起和挑战

俄亥俄州立大学NLP团队最近发表的一篇论文可能是解决这个问题的关键。虽然他们一开始没有做研究来解决RAG的不足,但结果表明了一个可能的想法。

理解自然语言(NLP)中,多跳问题(Multi-hop Problem)处理通常需要跨越和整合多个句子甚至段落的信息,其本质是通过逻辑判断和信息整合来解决复杂的问题,在现实生活中有着丰富的应用领域。

回到刚才的问题:“自制披萨奶酪容易掉下来怎么办?”这是一个典型的跳跃问题。为了回答这个问题,系统需要以下步骤:

首先:找到自制披萨的过程有哪些?

第2跳:确定哪一步与奶酪粘合有关,并找出相应的解决方案,最终得到答案。

传统的RAG通常缺乏跨段连接信息的能力,只能单独检索段落。这也是AI 可能的Overviews翻车原因。现在可以处理多跳问题的RAG通常采用迭代检索(例如IRCoT)的方法。也就是说,先搜索“美国历任总统”的相关文件,然后利用中间结果继续搜索“穆斯林总统”,最终生成答案。每一轮检索和处理都是基于前一轮的结果,而多轮迭代检索则需要大量的计算资源和时间。

这篇论文提出要求RAG给大型语言模型。(LLMs)类似于人脑的知识整合和多跳推理能力的方法,它在相同的性能下比现有的迭代检索方法更快 10-30 倍数。而且不需要多轮迭代检索,就可以形成多角度查询一个结果。

脑皮质,海马体,旁回:HippoRAG的三大神器

在这篇论文中,研究人员展示了他们的新模型——HippoRAG的工作原理:从斯坦福大学教授和阿尔兹海默病研究人员的许多段落中,找到了一位斯坦福教授,他们正在处理一个多跳跃的问题。

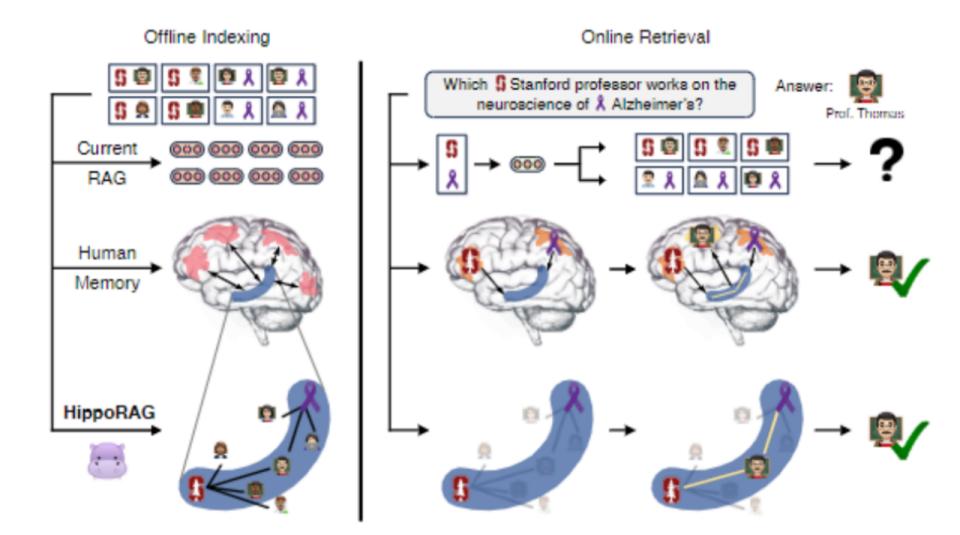

图1.海马体与HippoRAG的对比。

当人脑面临如此多的跳跃问题时,这位同时符合两者特点的教授会因为我们的大脑联想记忆能力而迅速被记住,前提是我们的大脑同时掌握了研究人员和斯坦福教授的信息。这种能力被称为由上图所示的海马体(蓝色部分)驱动的。海马体在形成不同的记忆模块之间的联系方面起着至关重要的作用,关系到人脑的记忆功能。这就是HippoRAG处理多跳问题的灵感所在。

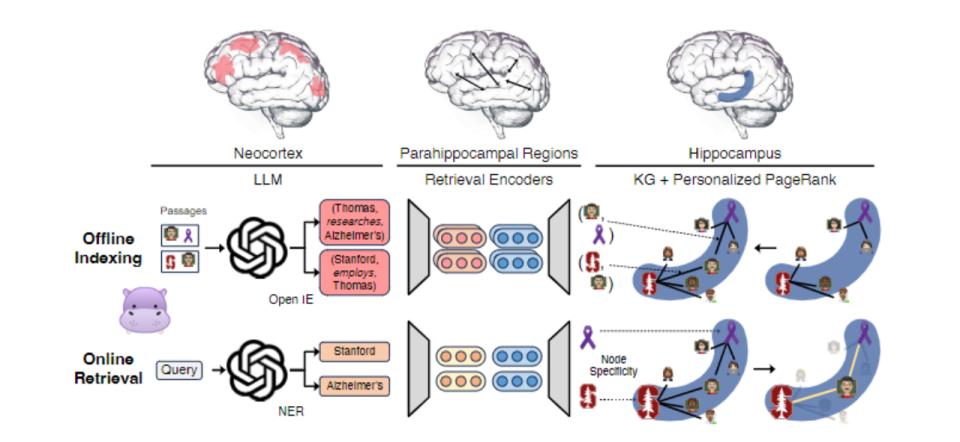

所以,在对HippoRAG的工作原理进行分析之前,首先要了解人类记忆模型的工作原理。为了理解人类的长期记忆,海马体记忆检索理论提供了理论支持。提出者Teyler和Discenna认为,人类长期记忆与三个部件有关,即新皮层(Neocortex)、海马体(Hippocampus)回到海马旁边的区域(Parahippocampal regions),协调三个部分,促使人类在不失去之前的记忆的情况下,能够储存大量的世界知识,不断整合新的体验,这一复杂的记忆系统是推理与决策的基础。

通过模仿这些组件的功能,HippoRAG可以提高LLMs的知识整合能力,具体工作原理如下:

知识图谱(KG)-大脑皮质(Neocortex)对于人脑来说,大脑皮层负责处理和储存具体的记忆,就像我们所学到的知识、经历的事件一样。这个角色在HippoRAG中由一个大的语言模型组成(LLM)来扮演。这种语言模型就像大脑皮层处理感官输入一样,负责从文本词库中提取信息,并将其转化为知识地图。(KG),这张地图就像一个巨大的网络,没有固定的结构,存储着各种各样的实体(例如名称、地点、概念)和两者之间的关系。

PageRank个性化(PPR)算法-海马体(Hippocampus)海马体在人类记忆中起着检索的作用,它帮助我们通过联系来检索记忆。通过KG和个性化PageRankk,海马体在HippoRAG中的功能(PPR)实现算法。这一算法可以帮助HippoRAG在知识地图中找到与查询最相关的部分,就像海马体通过相关线索搜索记忆一样。

检索编码器(retrieval encoders)-海马旁回(Parahippocampal regions)这些区域可以帮助我们识别人脑中记忆的不同部分,并在搜索过程中提供上下文信息。这个功能由HippoRAG检索编码器组成(retrieval encoders)为了实现这一点,他们帮助将查询中的关键概念与知识图谱中的节点联系起来,确保检索过程能够准确进行。

图表2.模拟三个步骤的模拟

当HippoRAG接收到一个新问题时,它首先通过语言模型(大脑皮层)来理解问题的关键点,然后通过搜索编码器(海马旁回)将这些关键点与知识地图中的节点联系起来。最后,HippoRAG可以通过个性化的PageRank算法(海马体)快速搜索和整合跨越多个文本片段的信息,从而提供准确的答案。

智能化:HippoRAG技术的具体知名度

在了解了HippoRAG的工作原理之后,下一步值得注意的是HippoRAG在实际应用中能带来哪些变化。在这方面,研究人员也在文章中进行了充分的测试。

研究人员选择了两个具有挑战性的多跳问答数据(MuSiQue和2WikiMultiHopQ)来测试HippoRAG在处理多跳问答任务时的效率,并将HippoRAG与IRCoT等迭代检索方法进行了比较,对HippoRAG在线检索过程中的成本效率和速度进行了综合评估。

实验结果表明,HippoRAG正在处理多跳回答问题。(multi-hop question answering)与现有的检索增强生成相比,方面表现突出,(RAG)HippoRAG在方法上有显著优势:

首先是性能提升。与目前的RAG方法相比,HippoRAG在两个流行的跳跃问题答题基准测试中的性能提高了3%到20%左右。这意味着HippoRAG在理解和回答问题时更准确。

其次,成本更低,响应速度更快。单步检索使用HippoRAG的成本比迭代检索方法(如IRCoT)低10到30倍,速度也快6到13倍。就像用手机查资料一样,HippoRAG就像一个已经升级的搜索引擎,不仅速度快,而且省钱。

以及更强大的新场景处理量。本文讨论的跳跃问题是标准意义上的跳跃问题,即根据给定的、明确的路径或顺序连接信息找到答案。然而,在现实生活中,我们经常面临更复杂、更严重的问题。没有明确的路径,我们需要模型来探索不同的信息来源来构建答案。

HippoRAG处理上述问题被称为路径发觉型多跳问题(Path-Finding Multi-Hop Questions)同时也有优势。此外,HippoRAG还可以与IRCoT等现有的迭代检索方法相结合,作为辅助工具,进一步提高处理复杂问题时的性能。

综上所述,HippoRAG提供了更高效、更低成本的解决多跳问题和AI推理能力的方案。更有意思的是,它甚至顺便回应了谷歌的问题。

回顾谷歌的AI Overviews在搜索领域遇到了一个尴尬的开始,每个人都忍不住对AI的智能极限产生了怀疑。但是,随着HippoRAG技术的出现,我们似乎有了一个新的解决方案。如果AI 在HippoRAG的帮助下,Overviews可以获得更多的跳跃推理能力,因此在面对那些陷阱问题时,它不会陷入误解。它可以像一个聪明的侦探,通过细致的逻辑判断,快速地从大量的数据中挑选出正确的答案。

想象一下,AI 在经历了HippoRAG技术的洗礼之后,Overviews再一次被问到同样的问题:“自制披萨的奶酪容易掉下来怎么办?这一次,它不仅能迅速给出正确的答案:“保证奶酪与披萨底部紧密结合的最好方法是使用适量的披萨酱和优质奶酪,同时注意烘烤时间和温度。”甚至可以幽默地补充道:“经过HippoRAG的升级,我可以确认,我们不再需要任何胶水,即使是无毒的,也可以固定我们的奶酪。我们的目标是把奶酪放在比萨饼上,而不是在笑话集里。”

参考文献:

[2405.14831] HippoRAG: Neurobiologically Inspired Long-Term Memory for Large Language Models

本文来自微信微信官方账号“腾讯科技”(ID:qqtech),作者:李安琪,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com