97.6%近乎满分!Claude最强模型发布却暂不开放:安全风险成关键考量

昨夜,Anthropic最新推出的Claude Mythos(神话)预览版,再度引爆整个AI领域。

Claude Mythos预览版被官方称作「迄今为止最强大的AI模型」,其能力达到全新层级,甚至大幅超越了此前Anthropic自家的最强模型Claude Opus 4.6。

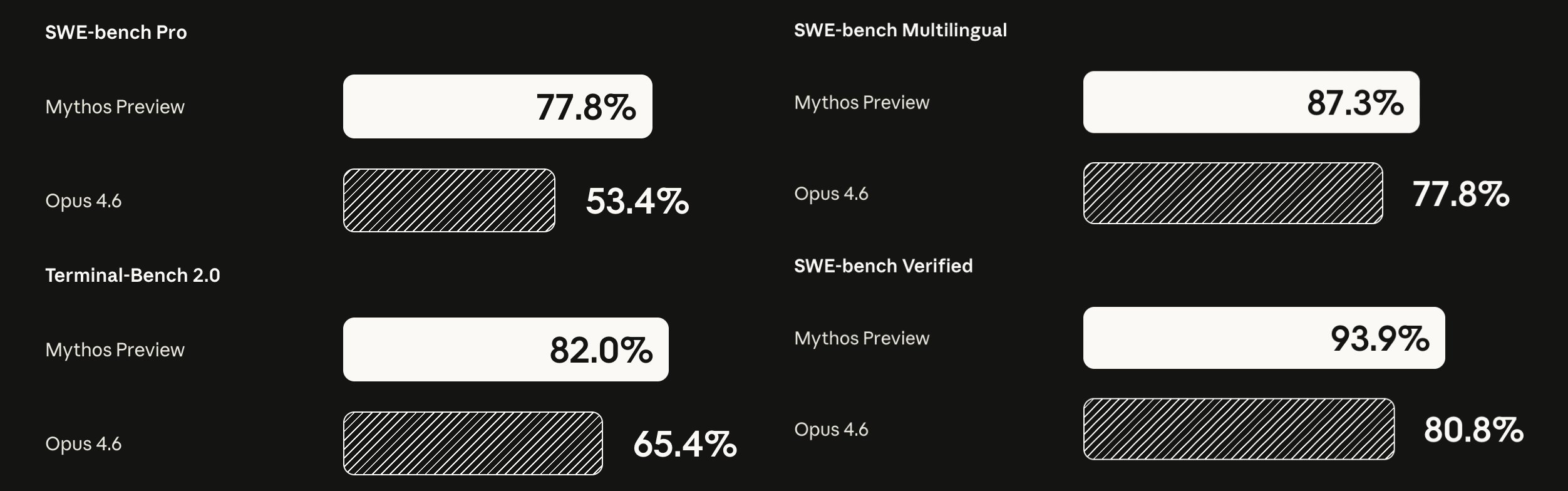

从目前呈现的数据与结果来看,这并非营销噱头,而是真正实现了质的飞跃。首先,在几乎所有公开基准测试中,Claude Mythos预览版均位居榜首,更令人惊叹的是其进步幅度:

面向软件工程的SWE-bench Verified测试,从Opus 4.6的80.8%飙升至93.9%;SWE-bench Pro测试则从53.4%跃升至77.8%;在高难度数学推理测试USAMO 2026中,成绩更是从42.3%直接提升至97.6%——近乎满分。

可以说,它是目前全球范围内最强大的AI模型。

这还只是部分「小」案例,更令人震撼的是,Anthropic在过去几周的实际测试中发现,Mythos预览版能在主流操作系统与主流浏览器中自主识别出数千个高危零日漏洞(zero-day),涉及Linux内核、OpenBSD、Firefox浏览器、FFmpeg等核心组件。

其中不少漏洞连人类安全团队审核十几年甚至二十年都未发现,例如在以安全性著称的OpenBSD系统中,Mythos预览版就找到了一个隐藏27年未被察觉的远程崩溃漏洞。Anthropic官方甚至明确表示,Mythos预览版在网络安全能力上远超其他任何AI模型。

这并非一个「更好用的Claude」,它在代码编写、推理分析、网络安全等方面,都达到了前所未有的自主性与深度。开发者们本期待着「彻底解放生产力」,但结果却是:

Anthropic直接关闭了公众使用的大门。

没错,至少目前,Claude Mythos预览版不对公众开放。根据官方说法,Mythos预览版目前仅用于「防御性网络安全」,且只有12家合作伙伴(包括AWS、苹果、博通、思科、CrowdStrike、Google、摩根大通、Linux基金会、微软、英伟达、Palo Alto Networks等)以及40多个构建或维护关键软件基础设施的组织,拥有其访问和使用权限。

这正是Anthropic同步推出的Project Glasswing(玻璃翼计划)。Anthropic甚至提供了1亿美元的额度,支持40多家额外组织使用Mythos预览版维护开源生态的「基础架构」。

但为何一个「最强模型」要如此「藏着掖着」,不向公众开放呢?

能力过强,需平稳过渡

首先需要明确的是,Claude Mythos预览版或类似水平的超级大模型,未来一定会向公众开放。Anthropic官方表述得十分直白:

「虽然我们目前没有向公众开放Claude Mythos预览版的计划,但最终目标是让用户能够安全地大规模部署Mythos级别的模型——这不仅是为了网络安全,也是为了这类功能强大的模型将带来的无数其他益处。」

正如官方博客字里行间所透露的,这个模型「过于危险」。

去年年底,Google Threat Intelligence Group(GTIG)就发现了PromptFlux和PromptSteal两个真实案例:它们在运行时连接商业大模型(如Gemini API)时,会动态生成恶意脚本、实时混淆自身代码,还能根据目标环境「现场」创建新功能,完全绕过传统签名检测发起攻击。

这并非个例。根据市场研究机构SQmagazine的报告,全球报道的AI驱动网络攻击数量增长了47%,预计超过2800万起。

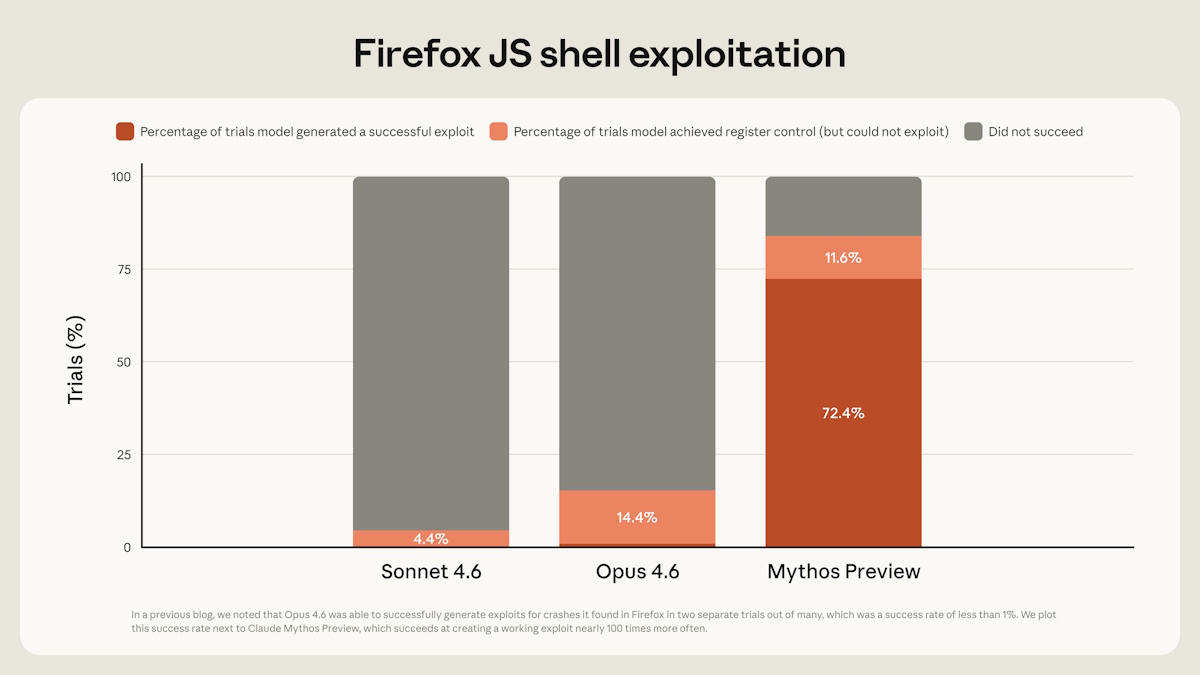

再看Mythos预览版,其漏洞查找能力已初露锋芒。尤其对比此前Claude最强模型Opus 4.6自主发现并利用漏洞的成功率接近0%,Mythos预览版的表现堪称「逆天」。

以Mozilla Firefox 147 JavaScript引擎中已修复的漏洞为例,Claude Opus 4.6在利用该漏洞时尝试了数百次,仅成功2次;而Claude Mythos预览版在相同测试中成功利用漏洞181次。

此外,从测试报告来看,在过去几周的内部红队测试中,Mythos预览版展现出的攻击能力已远超人类顶尖安全专家。它不仅「能找漏洞」,还能自主发现、链式利用数千个高危零日漏洞。

众所周知,黑客分为白帽与黑帽。白帽黑客发现安全漏洞后通常会提醒项目管理者,在开源项目中甚至会主动修补;但黑帽黑客则可能利用漏洞攻击系统。

Mythos预览版兼具攻击与防御能力,但其攻击潜力大到令人担忧。一旦落入别有用心之人手中,就能瞬间构建起AI级别的攻击链。Anthropic自己也承认,这并非普通的前沿模型,其通用能力已强大到能将网络战直接推向新维度。

计算机安全领域的攻防战向来是「魔高一丈,道高一尺」,过去两年围绕AI大模型的安全攻防战也是行业(尤其是大厂)关注的重点之一。国内的字节跳动、蚂蚁集团等企业,近两年也举办过类似的AI大模型攻防战,通过红(攻击方)、蓝(防御方)对抗来发现并解决AI时代的安全挑战。

不过Anthropic也指出,长远来看,像Mythos预览版这样强大的语言模型更有利于「蓝队」进行防御。但短期内,如果开放公众使用,Mythos预览版很快会被攻击者利用,以前所未有的效率攻击当前全球网络。关键问题在于,防御行为更被动,攻击行为更主动,考虑到利益驱动,攻击方更有动力积极使用Mythos预览版这类模型。

因此,为实现「平稳过渡」,Anthropic推出了「玻璃翼计划」。

值得一提的是,该项目名称灵感来源于广泛分布在美洲的宽纹黑脉绡蝶,因其透明翅膀常被称为「玻璃翼蝶」。尽管看似脆弱,但其翅膀能承载相当于自身体重40倍的重量。

「玻璃翼计划」的逻辑很简单:让防御方先掌握这一「武器」,在攻击方获得同级别AI之前,先将漏洞全部修复,并学会基于先进AI的安全防御方法。

从这个角度看,Claude最强模型暂不向公众开放是正确的选择。不仅如此,即使从普通Claude用户的角度出发,暂时不开放Claude Mythos预览版也是利大于弊。

最强模型不开放,Claude反而更易用?

许多人看到Mythos预览版不开放,第一反应是失望:这么强大的模型,为何不让大家使用?

但如果你是普通Claude用户,或是每天依赖Claude Code编写代码、开展项目的开发者,可能会发现一个看似反直觉的事实:暂时不开放Mythos预览版,对我们反而更有利。

先谈谈近期大家感受最明显的痛点。

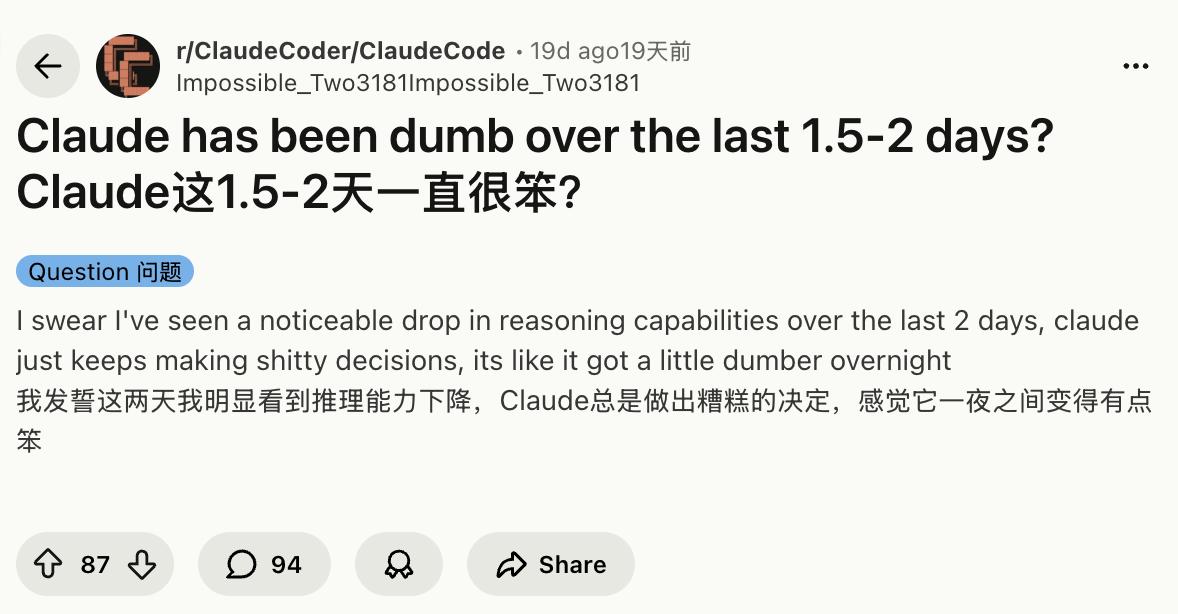

大约从今年2月起,Claude和Claude Code迎来了「史诗级性能下滑」。Reddit的r/ClaudeCode和r/ClaudeAI板块中,相关吐槽帖子刷屏,有人直接发帖《4.6 Regression is real!》,有人抱怨「Claude Code在过去1.5到2天里变得很笨」。

还有开发者通过数据追踪发现,文件读取次数从之前的6-7次降至仅2次左右,复杂任务中模型越来越「懒惰」,思考深度明显变浅,经常直接进行「edit-first」操作而非先调研。

AMD AI总监Stella Laurenzo甚至公开表示,Claude Code变得「更笨、更懒」,无法信任它完成复杂工程任务。

Claude Code团队成员Boris在Hacker News上回复称,承认部分智能体(agentic)用例出现性能倒退,核心原因是2月引入的「redact-thinking」和Adaptive Thinking机制,让模型自主决定思考时长,导致复杂任务的思考深度下降约67%。

类似的抱怨在X平台也层出不穷,开发者吐槽Claude Code已退化成需要全程监督的「实习生」。

为何会出现这种情况?

超大参数模型训练的规律摆在眼前:每当大厂全力研发下一代「最强模型」时,都需要海量算力。Gemini在推出3.0/3.1版本前,2.5 Pro就多次被开发者吐槽静默更新后性能下降,出现长上下文内容遗忘、逻辑任务失败率上升等问题;GPT-5发布前,4o也出现过输出变短、变懒、复杂指令机械化等「降智」反馈。

算力是有限的,训练Mythos这类全新层级的模型成本极高,只能从现有资源中「挤」出空间,通过动态负载均衡、自适应算力降低甚至轻度优化等方式实现,但结果就是用户感受到的「变笨、变懒」。

此外,Claude Code用户量增长远超预期,基础设施多次面临压力,而Mythos预览版(内部代号Capybara)的训练和测试又需优先占用顶级GPU。因此,当Mythos预览版发布却不向公众开放时,无需担心算力被进一步稀释,导致Claude或Claude Code的质量继续下滑。

对普通Claude用户而言,使用体验反而会更稳定。

另一方面,Anthropic通过「玻璃翼计划」让Mythos帮助大厂和开源项目修复漏洞,这些漏洞修复后最终也会间接惠及所有用户。

等Anthropic将风险控制和基础设施准备得更充分,再安全地大规模部署Mythos级模型时,普通用户才能获得真正稳定、强大且不会频繁「降智」的使用体验,而非现在急于开放后,大家一同承受算力挤占的阵痛。

写在最后

Claude Mythos预览版的出现,将一个残酷却现实的问题摆在所有人面前:AI越强大,风险就越真实。

当最强模型的攻击能力已远超当前防御体系时,Anthropic选择「暂不开放」并非保守,而是为整个行业争取时间,让防守方先加固基础,让普通用户先拥有相对稳定的Claude体验,而非一同卷入算力挤占和安全失控的混乱。

对大多数人而言,这或许就是当下最好的安排。

本文来自微信公众号「雷科技」,作者:雷科技,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com