开源3B推理模型,手机也能跑,性能超Qwen 3 - 4B且超长上下文不降速

以色列一家初创企业开源了一款3B模型,其性能远超谷歌Gemma 3 - 4B。

以色列创企开源3B模型,性能碾压谷歌Gemma 3 - 4B。

据智东西10月9日消息,昨日,以色列AI初创企业AI21 Labs开源了轻量级推理模型Jamba Reasoning 3B。该模型拥有30亿个参数,可在手机、电脑等多种设备端运行,性能超越了Qwen3 - 4B、Gemma 3 - 4B等业界顶尖模型。

Jamba Reasoning 3B开源截图

Hugging Face地址: http://huggingface.co/ai21labs/AI21-Jamba-Reasoning-3B

A21表示,Jamba Reasoning 3B基于新的SSM - Transformer架构构建,上下文窗口长度为256K个token,能处理高达1M token,与DeepSeek、谷歌、Llama和微软等竞争对手相比,效率提升了2 - 5倍,在基准测试中处于领先。

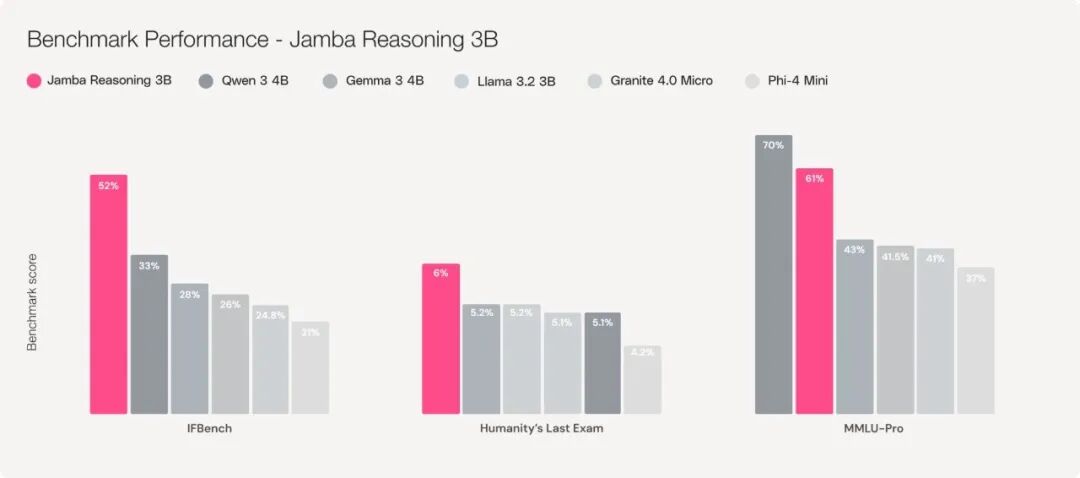

Jamba Reasoning 3B在人类最后测试等测评中超Qwen 3 - 4B等模型

该公司将Jamba Reasoning 3B的优势归纳为三点:

1、智能性能不下降:由于采用混合SSM - Transformer架构,Jamba Reasoning 3B比纯Transformer模型更高效。

大多数基于Transformer的模型在上下文长度超过32K个token时性能会显著下降,而Jamba Reasoning 3B能处理更长的上下文长度,包括高达100万个token。这使其在高级智能体系统或多模态应用中非常实用,因为长上下文理解对输出质量至关重要。

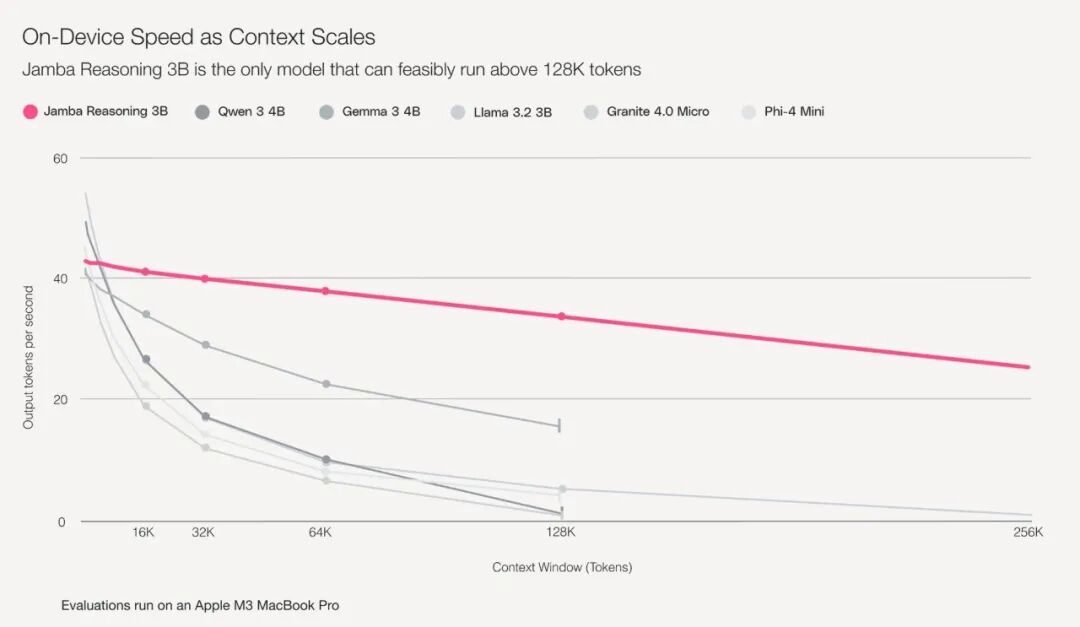

Jamba Reasoning 3B的性能随上下文增长损耗小

2、领先的智能:Jamba Reasoning 3B的表现优于DeepSeek、谷歌、Meta和微软的其他设备端模型。

它在指令跟踪任务(IFBench)和常识性知识(MMLU - Pro和Humanity's Last Exam)方面表现出色,这让Jamba Reasoning 3B成为一款高效且智能的模型,可用于高级智能体工作流程或设备端RAG应用。

这些成果得益于训练后流程,A21将RLVR、SFT、DPO和GRPO等对齐训练技术与自主研发的专有方法相结合,以确保模型质量。

Jamba Reasoning 3B测评超阿里、谷歌等模型

3、专为设备安全使用而构建:此模型获得Apache 2.0许可,可直接下载到用户的计算机或手机上,用户能使用自己的文件在设备上进行定制,以实现完全安全的应用程序,即使断网也能继续运行。

Jamba Reasoning 3B的混合SSM - Transformer架构成功利用了比原始Transformer架构小8倍的键值缓存(KV),即使上下文增长也能保持较低的内存占用。

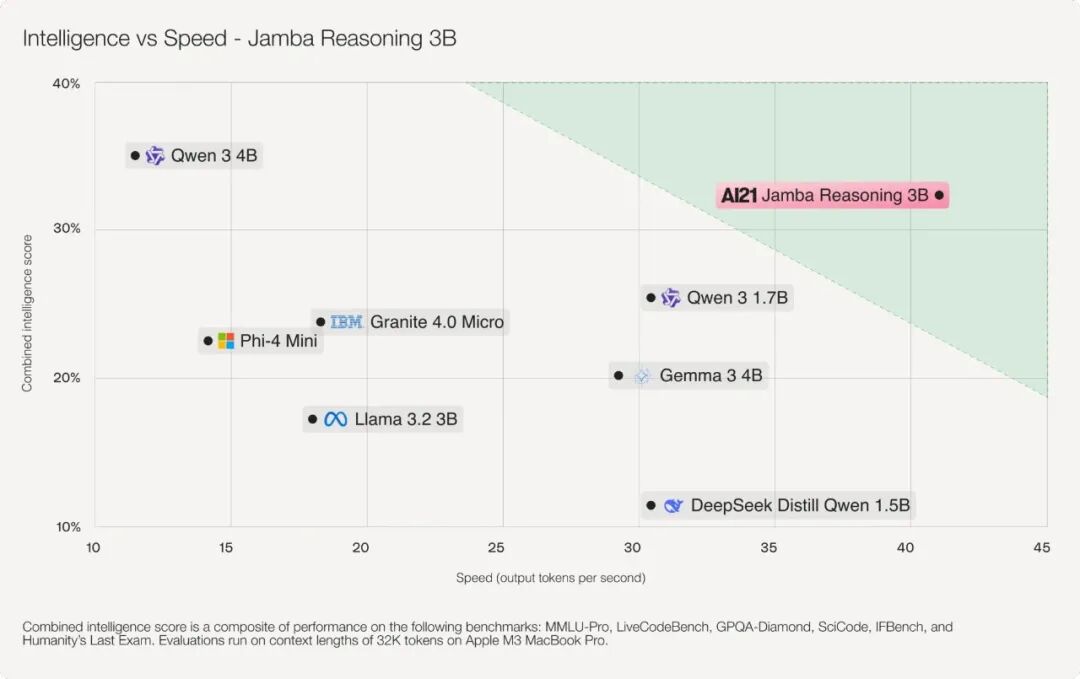

在M3 MacBook Pro上,它每秒可生成40个token,上下文长度为32K,这一成绩优于Qwen3 - 4B、DeepSeek Distill Qwen 1.5B、Gemma 3 - 4B等模型,使其成为高级智能体应用程序中的精简组件。

在M3 MacBook Pro上每秒可以生成40个token

该模型目前支持的语言有:英语、西班牙语、法语、葡萄牙语、意大利语、荷兰语、德语、阿拉伯语和希伯来语。

结语:轻量模型加速迭代,开辟智能体落地新路径

随着企业将AI融入运营,基于云端的大型语言模型暴露出经济效率低下的问题。A21援引研究报告称,40% - 70%的AI任务可通过小型语言模型处理,通过智能路由可将成本降低10 - 30倍。

像Jamba Reasoning 3B这样的设备端轻量模型能够实现经济高效的异构计算分配,在本地处理简单任务,同时保留云端资源用于复杂推理。这为制造业和医疗保健领域的实时应用提供了低延迟,为远程操作提供了离线恢复能力,并增强了数据隐私保护,有望开启一个去中心化的AI时代。

本文来自微信公众号“智东西”(ID:zhidxcom),作者:李水青,编辑:心缘 ,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com