发布 阿里云拉开了新一轮开源模型大赛的序幕,Qwen3

2025 年已经过去 如果使用关键字来描述1/3 AI 你会想到这个领域的发展吗?我想到了这一点:开源,加速创新。

2 月是「DeepSeek」的,R1 让全世界以大家意想不到的方式执牛耳。 AI 开发者、企业家、投资者将目光投向「DeepSeek」「中国」「开源」上。

4 月是「开源模型」是的,发令枪是 Meta 喊的。被 DeepSeek 盖过风头后,2025 年 2 月 19 日子,坐不住 Meta 第一次官方宣传-第一次生成式 AI 开发者大会 LlamaCon 将在当地 4 月 29 日(北京时间) 4 月 30 日期)举行,颇有重新夺回。「AI 开源界老大」想要江湖地位。

但 AI 该领域的产品发布节奏非常微妙,何时发布似乎取决于对手的行为,作为一种默契,Meta 一声枪响让 4 月底成为开源模式的主场。

整个 4 月亮甚至更早,AI 开发者都在多个社交平台上「蹲」开源领域「三大招牌」的新发布:DeepSeek-R2、Qwen3 以及 Llama4。Llama4 由于本月初的发布低于预期,似乎少了一些热度。

现在看起来,4 中国队在月底最受关注,R2 Qwen3呼之欲出。 终于来了。

4 月 29 日凌晨 5 点击,阿里巴巴开源新一代通义千问模型 Qwen3,参数仅为 DeepSeek-R1 的 三分之一,成本大幅下降,性能全面超越 R1、OpenAI-o1 等待世界顶级模型,登上世界上最强的开源模型。X 这个平台的开发者甚至把今天定义为「Happy Qwen3 Day」,不仅因为 Qwen3 全面超越 R1,更因为 Qwen3 家庭需要多种尺寸,内置 MCP 支持,支持混合推理等实用功能点。

进一步提供官方技术报告 Qwen3 几个亮点:

「探索智能上限」再次突破:通过扩大预训练和加强学习规模,实现更深层次的智能化;

国内首个「混合推理模型」:将思维模式与非思维模式无缝融合,为用户提供灵活控制思维预算的能力;

增强了 Agent 能力:从致力于训练模型的时代转变为训练模型。 Agent 时代是中心时代。

对于 Qwen3,个人用户现在就可以了「通义」APP 或 chat.qwen.ai 网页直接体验,夸克即将全线接入。 Qwen3。开发者和公司可免费进入魔搭社区,HuggingFace 等待平台下载模型并商业使用,或者通过阿里云百炼调用。 Qwen3 的 API 服务。

憋了这么久 Qwen3 究竟如何?又代表了哪些模型的发展趋势?

01 世界上最强的开源模型Qwen3登顶

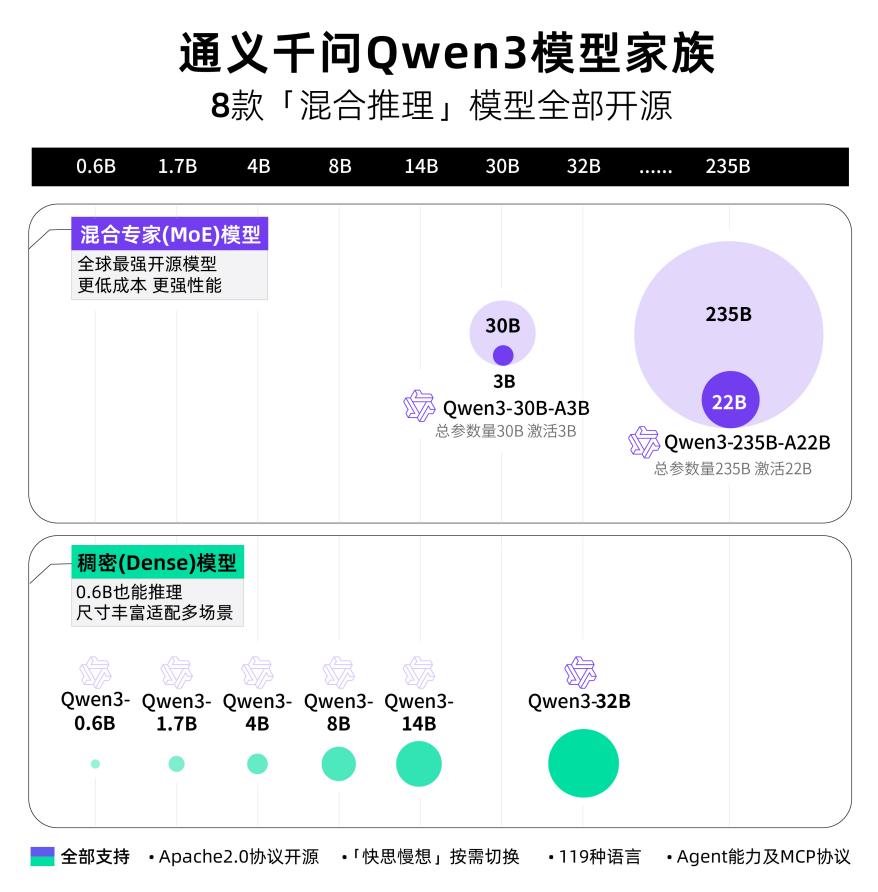

Qwen3 包括 2 个 MoE 和 6 阿里云开源两个密集模型 MoE 模型的权重,六个 Dense 模型也已经开源,包括 Qwen3-32B、Qwen3-14B、Qwen3-8B、Qwen3-4B、Qwen3-1.7B 和 Qwen3-0.6B,皆在 Apache 2.0 开源许可。

Qwen3 开源模型家族

其中,旗舰型号 A22B-Qwen3-235B- 参数量仅为 DeepSeek-R1 的 三分之一,成本大幅下降,性能全面超越 R1、OpenAI-o1 等待世界顶级模型,登上世界上最强的开源模型。

另外,据阿里云官方介绍,Qwen3 是国内首个「混合推理模型」。「快思考」与「慢思考」整合到同一模型中,对简单的需求可以低算率。「秒回」回答,对于复杂问题可以采取多步骤?「深度思考」,大大节约了算率消耗。

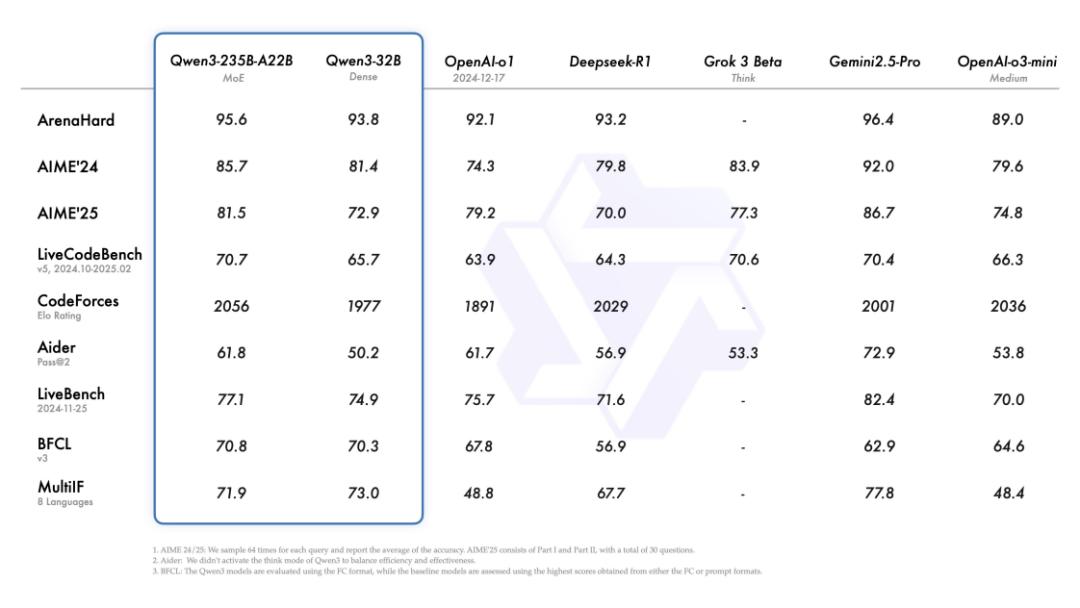

Qwen3 在推理、指令遵循、工具调用、多语言能力等方面都有了很大的提升。,创造了所有国产模型和全球开源模型的新高性能:奥数水平 AIME25 在评估中,Qwen3 夺得 81.5 分数,刷新开源记录;检查代码能力 LiveCodeBench Qwen3在评价中 突破 70 分价位,甚至超越了表现 Grok3;人类偏好对齐的评估模型 ArenaHard 在评估中,Qwen3 以 95.6 分超越 OpenAI-o1 及 DeepSeek-R1。

Qwen3在性能大幅提升的同时。 部署费用也大幅下降,只需 4 张 H20 可以安排千问 3 满血版,显存占用仅为性能相近模型的三分之一。

此外,小型 MoE Qwen3-30B-A3模型B 激活参数数是 QwQ-32B 的 10%,表现更胜一筹,甚至像 Qwen3-4B 这种小模型也可以与之匹敌。 Qwen2.5-72B-Instruct 的性能。

Qwen3-235B-A22B 是一个拥有 2350 总参数和多亿参数 220 多亿激活参数的大模型;Qwen3-30B-A3B 这是一份拥有约 300 亿总参数和 30 十亿激活参数的小型 MoE 模型。

得益于预训练、大规模强化学习和推理方法整合的显著进展,Qwen3 主推「深入思考,快速行动」,更好地构建 AI 应用。Qwen3 预训信息量达到 36T,并在后训练阶段多轮加强学习,将非思维模式无缝整合到思维模式中。

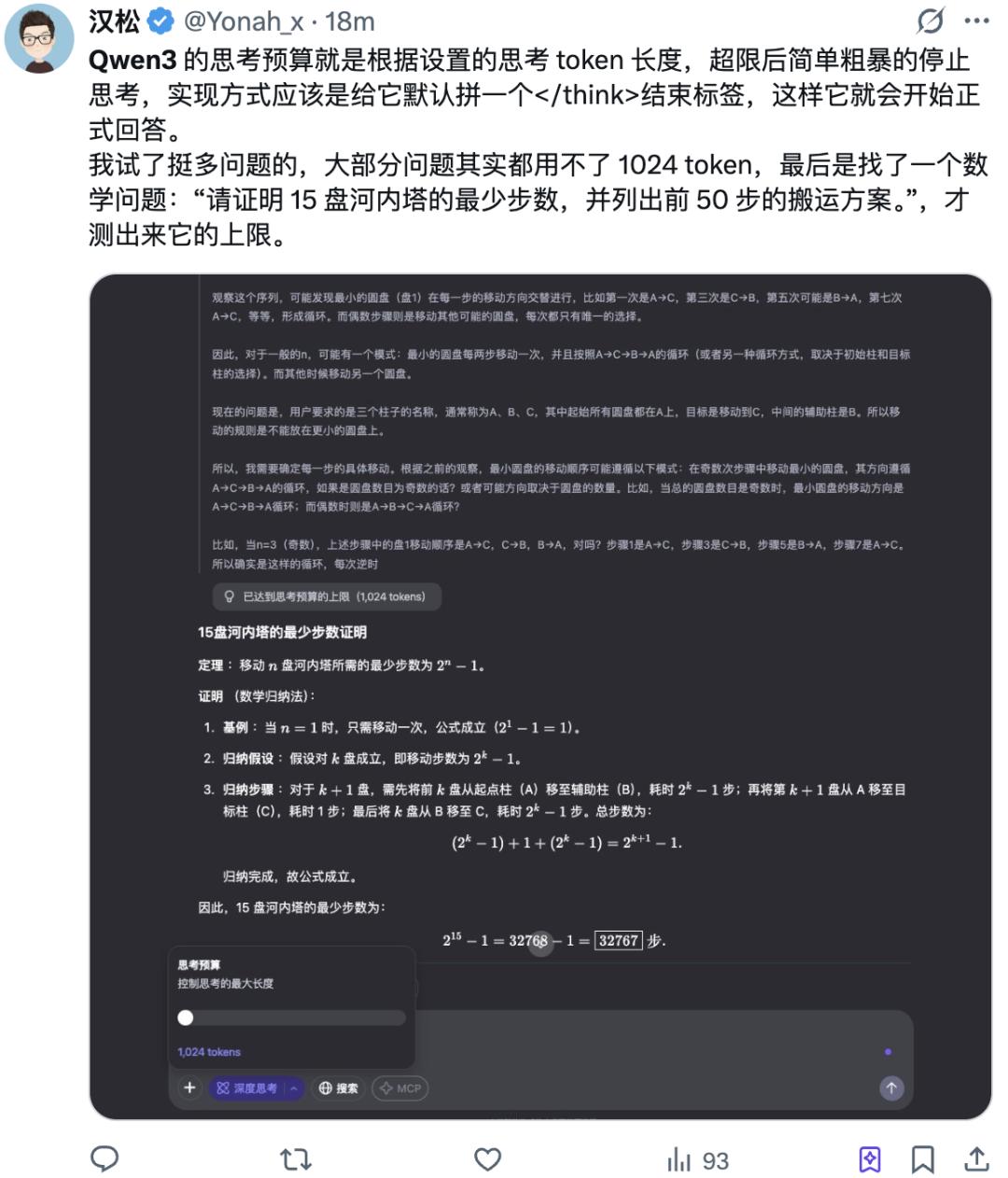

值得注意的是,这次 Qwen3 发表,主要推广混合推理,但最短的长度也是需要思考的。 如果问题所需的推理预算不满意,1024tokens, 1024tokens,根本感觉不到能调整精度的混合推理模型。而且不能发挥作用 Qwen3 灵活满足一定程度的思考。 AI 使用和不同场景对性能和费用的多样化需求。

02 大型模型全面转换「混合推理模型」和「Agent」

在 Qwen3 发布的前一天,X 平台已有「行业人士」——大型日本制造商 SakanaAI 一位工程师敏锐地捕捉到了 Qwen3 的重点。当日,在 AI 学术会议中最重要的领域之一 ICLR 2025 在一个车间里,阿里云通义实验室的通义千问负责人林俊邈透露 Qwen 下一步方向:推理模型与非推理模型的统一,以及面向。 agent 的大模型。

那是今天发布的 Qwen3 这两个最大的特点,同时也是大型厂商集体发生的转变。

2025 年 2 月 25 日,Anthropic 最新的旗舰模型已经发布 Claude 3.7 Sonnet,又称市场上第一个混合推理模式。这意味着 Claude 3.7 Sonnet 能产生实时响应(快速思考),也能进行延伸、逐步探索(慢思考)。API 使用者也可以粗粒度地控制模型的探索时间;在给出更长的思考时间时,理论上也有更高质量的答案。

Anthropic 说明混合推理模型的结构代表下一代前沿模型,可以让模型快速响应,深入思考,就像人类使用同一个大脑一样,不仅可以为用户创造更无缝的感受,还可以让用户通过 API 使用 Claude 3.7 Sonnet 可以控制思考的预算。举例来说:可以告诉 Claude 最勤思考 N 个 token,N 可实现其导出限制的取值 128K token,然后在回答质量和速度(和成本)之间进行衡量。

「混合推理架构」也获得了 OpenAI 的青睐。Sam Altman 早些时候看到,目前的模型和产品供应已变得十分复杂,希望 AI 能「开箱即用」、简化产品供应,「和你一样,我们讨厌模型选择器,想要回归神奇的统一智能。未来,我们的一个重要目标是创建一个系统,它可以使用我们所有的工具,知道什么时候需要长期思考或不需要它。统一 o 系列模型和 GPT 一般来说,系列模型可以广泛应用于各种任务。」

就像在 DeepSeek-R1 里面是一样的,选择「深度思考」推理模型在背后调用。 R1 做长推理,不选择调用底座模型。 V3 答案是即时产生的。现在,模型制造商「思考粒度」这一决定更加灵活,通常交给用户来控制推理预算。

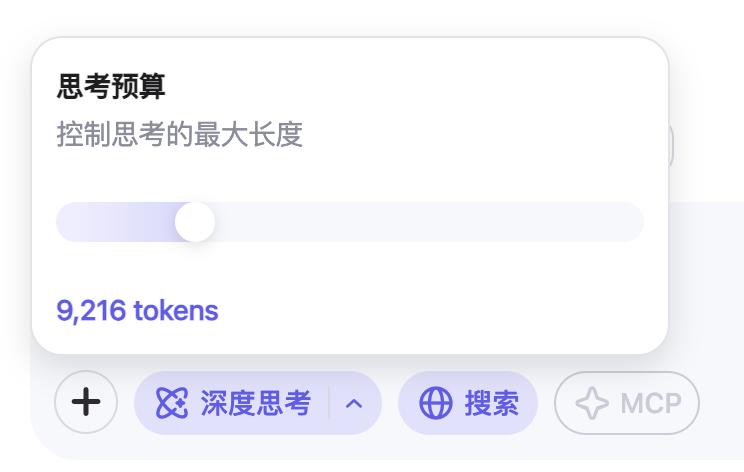

在 Qwen3 中间,可以滚动「思考预算」按钮,调整思维的最大长度,然后匹配合适的推理质量和成本。

Qwen3在思维模式下 模型将逐步推理,经过深思熟虑后给出最终答案,适用于需要深入思考的复杂问题。模型在非思维模式下提供快速、近乎实时的响应,适用于对速度要求高于深度的简单问题。这一灵活性使用户能够根据特定的任务控制模型进行控制「思考」的程度。这两种模式的融合大大增强了模型的稳定性和高效性。「思考预算」在成本效率和推理质量之间实现更好的平衡,控制力。

另外一家模型制造商的转换是 Agent。随着 Manus 验证了 Claude 3.5 Sonnet 达到了通用 agent 一些能力,加上模型调用工具,实现 agent 能力统一协议——MCP 拥抱的范围越来越大,下一代模型要面对面, agent、对实际场景进行优化。

就 Qwen3 说到这里,我们正朝着训练的方向迈进 Agent 这是一个中心时期,现在 Qwen3 改善了 Agent 和 代码能力,而且还加强了对代码能力, MCP 的支持。据报道,Qwen3 原生支持 MCP 协议,并且有强大的工具调用。(function calling)结合封装工具调用模板和工具调用分析器的能力, Qwen-Agent 框架将大大降低编码的复杂性,实现手机和电脑的快速运行 Agent 操作等任务。

在这个例子中,Qwen3 思考并自主调用工具到工具 Github 获得了数开源模型 star,继续思考,调用绘图工具制作图片,调用工具存储。|录像来源:阿里云

03 开源模型新一轮比赛开启。

Qwen3 新一轮开源模型领域的发布,代表着新一轮开源模型。「三国杀」已然开始。

事实上,随之而来 DeepSeek 横空出世,加上 OpenAI、字节等大厂调整对开源的态度,开源已成为大型赛道的必然趋势。而且, Llama、Qwen 和 DeepSeek,是当前开源领域最具竞争力的玩家。

而此前 OpenAI 和 DeepSeek 成功证明了互联网时代的生态、用户和产品壁垒,今天是 AI 网络时代并不像网络时代那样牢不可摧,模型能力是基础大型企业的核心竞争力。而 Llama、Qwen 和 DeepSeek 获胜者可能会在下一个发布周期到来之前(至少在 OpenAI 在开源模型发布之前),成为整体 AI 行业领导者。

虽然新一代模型的能力很强,但还是要等待 Llama 和 DeepSeek 虽然已经发布了,但是值得注意的是,这三家开源模型制造商的生态策略也存在差异,这一点从模型的重点就可以看出。

DeepSeek 和 Meta 重点也不一样,但是有一个共同点就是不太重视。 ToB,最起码在服务生态的建设上并不成功。而且这也是如此。 Qwen 阿里云背后最重要的部分。

在之前的文章中,极客公园曾经写过,脱胎于阿里云。 Qwen,这是开源模型技术最具领先地位、普遍全面开源的策略,追求生态建设的架势。阿里的 AI 除了追求战略之外 AGI,也同样重视 AI 基础设施建设,以及与阿里的电子商务、钉钉、夸克等。 AI 应用融合。

此前,阿里云智能集团高级副总裁、公共云事业部总裁刘伟光表示,「阿里云是世界上唯一一家积极开发基础大模型、全方位开源、全方位贡献的云计算制造商。」

而 Qwen 测量模型下载量和衍生模型数量的生态指标也是领先的。根据阿里巴巴云的最新官方数据,阿里通义已经开源。 200 多种模式,全球下载量超过 3 亿个,千问衍化模型数量超过数量。 10 万只,已超越 Llama 全球开源模式排名第一。

而且新模型的选择正在进一步优化推理成本、混合推理和推理。 Agent 上力,显而易见 Qwen 瞄准开发者和 B 终端用户的部署需求。它也将成为 Qwen 与 DeepSeek、Llama、OpenAI 等待竞争对手最大的不同,也是阿里能否得到。 AI 一张时代船票的关键因素。

本文来自微信微信官方账号 “极客公园”(ID:geekpark),作者:宛辰,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com