速度秒杀GPT10倍,国外的DeepSeek时刻来了?

什么?AI 世界再次焕然一新?

尽管这次没有看起来 DeepSeek 、 Manus 人们都知道这一点,但也许是对的 AI 行业发展的影响还真很大。

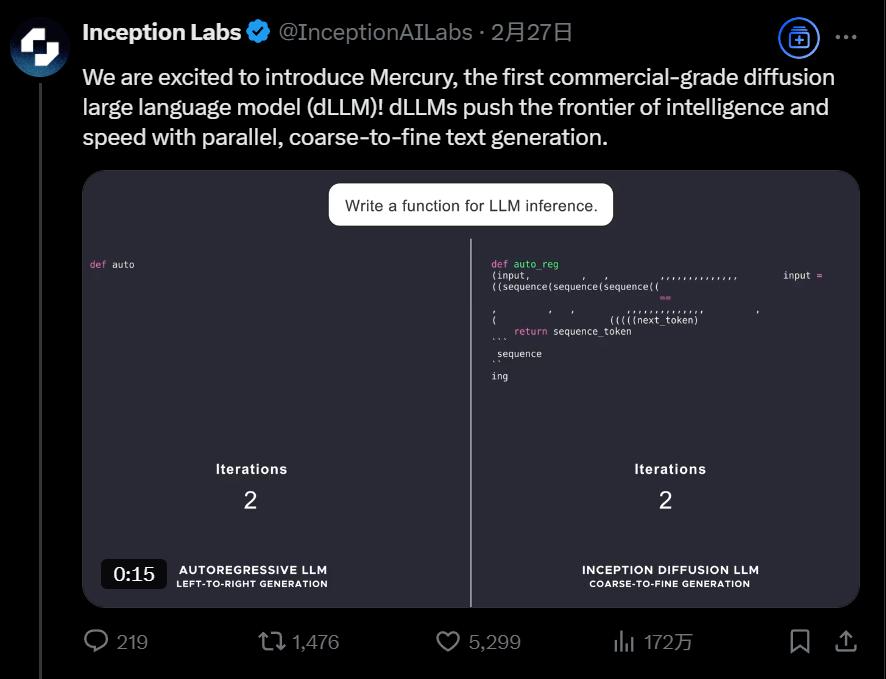

不久前,一家不知名的小公司Inception Labs做了一个大新闻,说是开发出来的。世界上第一个商业扩散模型( dLLM ) Mercury 。

而且这种所谓的扩散模式,也许会掀起一股浪潮,对大模型进行彻底颠覆 3 多年来的基本路线。

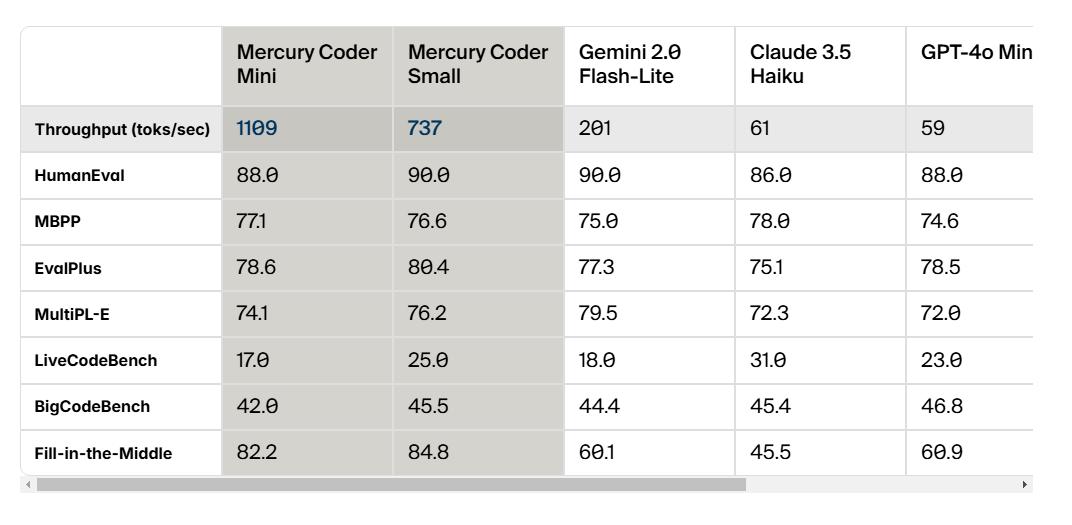

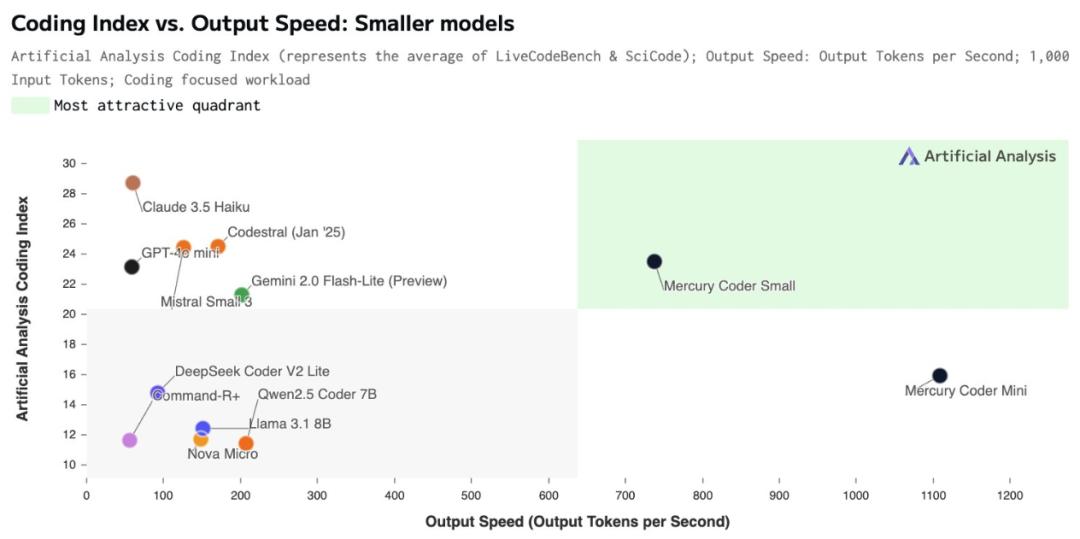

人们也实际上已经发布了数据,在一群测试中, Mercury Coder 基本上是一路吊打 GPT-4o Mini 和 Claude 3.5 Haiku ,每个人都在使用烂模型。

而且,这些同台竞技模型,还特别专门为生成速度提高,但是, Mercury 还是比他们快了多达 10倍。

不仅如此, Mercury 还能在 NVIDIA 在H100芯片上,实现每秒超越。 1000token 响应速度,而普通的大模型要想达到这个速度,一般都要用专门定制的。 AI 芯片。

要知道,为了达到更高的目的 token 响应速度,定制化 AI 芯片几乎成了每一个制造商的新战场。

除超超超快速速度外,我们还可以从中获得。 Artificial Analysis 在检测坐标系中可以看到,Mercury 产品的形成质量也是杠杆。。

虽然现在还没有顶级那么好。 Claude3.5 Haiku 等等,但是考虑到这是一目了然的效率,能够保持这种生成质量已经是很哇塞了。

同时,我们也正式发布 Mercury Coder Playground 在里面简单尝试了几个例子,经过一次测试,发现生成效果确实不错,而且速度真的很快。

提示:用HTML5写一个贪吃蛇游戏(Implement the game Snake in HTML5.Include a reset button.Make sure the snake doesn't move too fast .)

提示:使用HTML5 , CSS 以及Javascriptip 写一个扫雷游戏(Write minesweeper in HTML5 , CSS , and Javascript.Include a timer and a banner that declares the end of the game .)

提示词:用 HTML5 做一个 Pong 游戏( Create a pong game in HTML5.)

也许很多差友看到这个估计决定,这也不多牛啊,说什么? AI 这个世界可能会变天?

Mercury 强大的一点并不是它的效果有多好,更重要的是它给了它。 AI 这个领域带来了许多新的可能性:谁说大语言模型一定要走? Transformer 的路线?

在这个 AI 时代, Transformer 和 Diffusion 每个人估计都听见耳朵起茧了,有一段时间, Transformer 单干,一会儿就是 Diffusion 单飞,或两者合作。

但是从本质上讲,这两者实际上代表了AI的两个不同进化方向,甚至可以说,Transformer和Diffusion有不同的“思维”机制。

Transformer 是“ 典型的“人类链式思维”,它有一个自我回归的属性,那就是它有一个先后的概念,你必须先产生前面的结果,然后才能想到后面的东西。

所以我们现在看到的 AI 生成,都是一字一句,从上到下一点点长出来的。

而且Diffusion,是反直觉的,直截了当地模糊除噪,然后进入清晰的过程。。

也就是你问他问题,他不会整理逻辑,按照逻辑, 1 、 2 、 3 、 4 .....一步一步回答你的想法,但是你的大脑直接想到了所有的答案原型,但是这些答案都是模糊的,然后所有的答案一步一步变得清晰,直到产生结果。

生活中最常见的例子之一就是戴眼镜。当你摘下眼镜看东西的时候,整个东西都是朦胧的,但是你确实看到了。随着镜片的加入,你终于看到了每一个字。

因此 Mercury 结果就是一大片模糊的错码,然后一顿饭就发生了。 quickly quickly biu biu biu , ber 一下子就全搞定了。

就像这样

关于这两种效果的对比,我认为历史上有一次著名的新闻发布会,有些人使用了更直观的对比,这可能会帮助大家更形象地理解。

CPU就像今天的Transformer一样。

GPU就像今天的Diffusion。

事实上,光是从我们这样简单的描述来看,每个人都可以理解, Transformer 的确是一种更符合每个人逻辑的思维方式,所以在语言模型刚刚爆红的时候,基本上就是 Transformer 独自勇敢地闯入天涯。

但慢慢的, Transformer 开始暴露自己的不足。

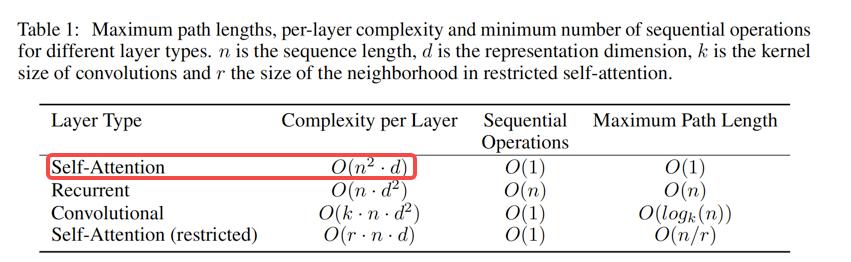

其中最令人头痛的就是, Transformer 在注意力机制看似优秀的背后,是计算复杂度(计算复杂度的公式是 O ( n ² d )( n 作为序列长度, d 指数等级增长是特征维度)。

计算复杂度的爆炸性增长受到很多限制,比如模型推理速度明显降低,生成速度显然不能满足长文本、视频等领域的实际需求。

此外,随着复杂性的不断提高,所需的硬件资源也呈指数级增长,阻止了这种硬件需求。 AI 真正走进每个人的生活。

因此,一直以来,业内人士都在思考法律的减轻。 Transformer 模型计算的复杂性。

例如量化、蒸馏、压缩模型 DeepSeek 能够爆火出圈,其实也是基于这种迫切的需要。

那 Mercury 似乎也在提醒大家,如果减少了, Transformer 如果计算复杂度很难,要不要尝试新的出路?

并且 Mercury 背后的 Diffusion 路线,大家都不陌生。

比如初期爆红 stable Diffusion , Midjournery 、 DALL-E 2 里面,都看见了 Diffusion 模型应用。

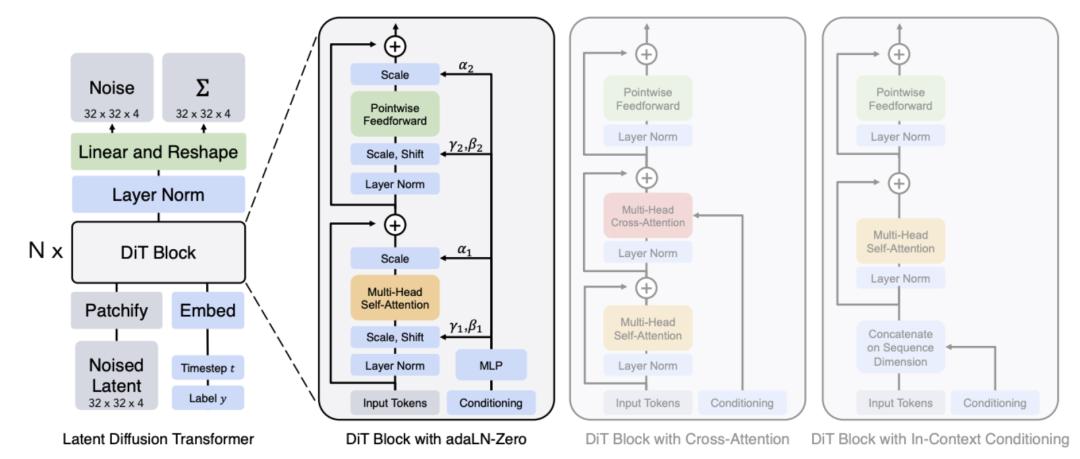

甚至像是这样出现的 OpenAI 的 sora 模型,就是利用它 Diffusion Transformer ( DiTs )这种 Transformer 和 Diffusion 混合双打模型。

虽然理想很美好,但是 Diffusion 在此之前,几乎所有的人都被各行各业的人判了死刑,因为他们认为这个货无法控制语言模型。

由于 Diffusion 其特点是没有自回归,不需要依赖前后文,这样可以节约资源,加快生成速度。

但是这样一来,生成精确度有点难以把握。,如今,文生图、文生视频等各种模式,仍然难以控制手、吃面、文字等高性能的产生。

可这次 Mercury 的突破性成果,的确也是第一次向大家验证, Diffusion 也能干 Transformer 的活。

但遗憾的是,目前 Mercury 没有公开任何技术文档,我们无法进一步了解它是如何解决内容质量难题的。

但是我们从它挑选的对手,比如 Claude3.5 Haiku 、 GPT4-omini 、 Qwen2.5 coder 7B 、 DeepSeek V2 lite 等等,这些袖珍版的大模型,也可以看出,显然是最强大的。 Diffusion 语言模型 Mercury 而且还不能做得很大。

即使经过我们的测试,我们也发现,如果使用一些自定义的提示,除了官方推荐的提示生成效果相对准确之外,它出错的概率也有点夸张。

而且产生的稳定性也相当一般,往往第一次产生的效果还不错,再次检测结果反而不行。

提示词:用 HTML 模拟动画绘制太阳系。( Use HTML to write an animation of the solar system simulation operation)

但是毫无疑问, Mercury 结果是很棒的,特别是考虑到这一点, Diffusion 多模态生成中的强势地位,也让人不由得想像,如果, Diffusion 的路线才是 AI 大模型更加正确的道路(看起来也不是不可能),未来的联动进化似乎更加顺理成章。

不久前,差评君刚刚看了一部名为《降临》的电影,里面的外星人并不像人类那样。 1 、 2 、 3 、 4 ...链式思维能力,不同的思维方式显然会带来更多的可能性。

那个问题来了,谁说呢? AI 要像人类一样思考吗?对于他们来说,是吗? Diffusion 思维方式更符合“硅基生命”的属性?

当然,这些都是差评君的盲目和荒谬,但有趣的是, Mercury 它不仅是太阳系的水星,也是罗马神话中的信使。它们的特点是跑得快,但在占星术中,它们代表了人们的思维方式和沟通能力。

不妨期待一下, Mercury 出现,可以给予 AI 带来新的道路。

图片,资料来源:

X.com

官网Mercury

OpenAI:Generating videos on Sora

techcrunch:Inception emerges from stealth with a new type of AI model

AimResearch:What Is a Diffusion LLM and Why Does It Matter?

知乎:如何看待Inception? Mercury,Lab扩散语言模型 coder?

本文来自微信微信官方账号“差评”,作者:八戒,编辑:江江& 36氪经授权发布面线。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com