中国AI在2025年的趋势和思考

"高质量的公开数据会耗尽吗?如何提前计划”“不同智能技术路线的能力边界在哪里?”“我们需要什么样的AI4S底座模型”“目前的大模型是否遇到瓶颈”...12月13日~在上海人工智能实验室发起并承办的首届“浦江AI学术年会”上,14日,浦江西岸出现了数十个人工智能领域前沿的关键话题,全球150多名人工智能专家学者就这些话题进行了深入的讨论。

二年前,ChatGPT问世,掀起了一场极强的“AI飓风”;最近,OpenAI在持续了12天的新闻发布会上再次让全世界进入“AI嘉年华”。然而,与两年前的震惊、兴奋和困惑不同,今天的学术界和工业界对AGI路线有了更多的“中国思维”。

什么叫“智能”,定义“智能”?

尽管人工智能这个词来自于1956年著名的达特茅斯大会,但是大会的发起人麦卡锡并不喜欢这个名字,“毕竟,我们的目标是‘真实’智能,而非‘人工’智能。”

2022年底,ChatGPT的出现让世界大吃一惊,也被认为是智能的“出现”。然而,香港大学计算与数据科学学院院长马毅并不认同这一点。他认为GPT只是知识而不是智能。“智能系统必须有一个自我纠正和自我完善的当前知识体系系统”。

近年来,马毅一直致力于研究“白盒大模型”。“白盒”的概念对应的是基于深度学习模型的“AI黑盒说”。虽然大模型给出了令人满意的结果,但人们并不知道它的决策过程,甚至很难预测和控制输出结果,也就是所谓的“幻觉”。

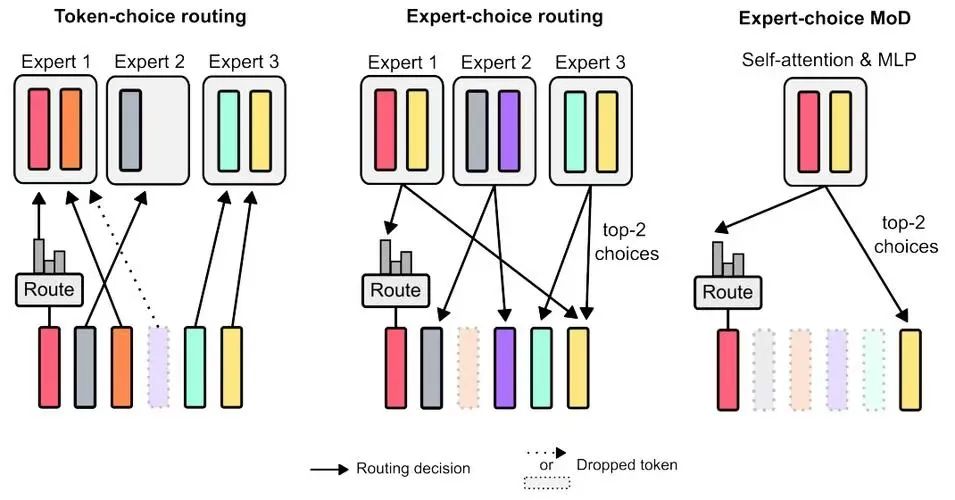

马毅认为,现有的深度学习模式,如 Transformer(主流大语言模型架构)本质上是“减水”。从高维图像、声音、语言等信号中,我们不断压缩和去除噪音,然后找到核心规律和低维结构,而白盒就是要清楚地解释这个压缩过程。

Transformer

简而言之,与ChatGPT的“暴力奇迹”不同,“白盒”试图先构建一个可以解释的框架,然后在这个框架下制作一个可以解释的网络和模型。由于知道了这一点,Transformer架构的试错成本大大降低,从而有效地解决了目前遇到的“数据墙”和“计算墙”问题。

稀宇科技创始人闫俊杰认为,智能的定义可以非常广泛,黑盒模型在一些应用中有足够的应用,但白盒模型在分析人类智能方面可能有优势。虽然目前的模型和产品取得了一定的进步,但未来会有更多的创新。不同的研究机构和公司会提出自己的智能意识,并在特定领域超越目前的水平。

新解“Scaling Law”

在论坛上,马毅的观点很快成为学者们热议的焦点,但在“什么是智力”的问题背后,另一个隐藏的问题是“Scaling Law(尺度定律)还能走多久?”

在大洋彼岸,几乎同时举行的另一次重磅学术会议——NeurIPS OpenAI前首席科学家Ilya2024上 Sutskever语言惊人,“预训练时代即将结束。”(Pre-training as we know it will end)”,原因是AI开发燃料的数据将会缺乏,依靠大量数据的预训练模型将会步履维艰。

资料匮乏,计算价格昂贵,效果下降…最近半年,Scaling Law学术界和工业界经常出现“碰墙”的反思。闫俊杰指出,目前全球有效数据被清理后,大约只有20万亿Token。

与此同时,图灵获得者杨立昆在他的新书《科学之路》中提到,要实现与人脑相同功能的计算量是巨大的,为了实现人脑的计算能力,需要连接功耗至少25兆瓦的10万个GPU巨型计算机才能实现。能量消耗是人脑的。 100 万倍,所以深度学习的能力很强,但是很有限。

他说:“据我们观察,随着大模型规模的不断扩大,归纳相关能力迅速提高,并可能继续遵循Scaling。 Law,但是它的演绎能力,包括数学和推理的优点,随着模型Side的进一步提高,不但没有增加,反而下降了。“在会议间隙,阶跃星辰首席科学家张祥雨告诉《IT时报》记者,他并不是绝对乐观地提高了超过一万亿参数模型的技能。

全球顶级AI公司和包括OpenAI在内的科学家都在“另辟蹊径”。北京时间12 月 6 凌晨2点多,OpenAI 宣布推出满血版o1和o1。 pro mode,随后,谷歌发布了Geminini,最强的下一代新模型。 2.0 Flash,在第一时间“尝鲜”之后,张祥雨对两大模型的创新大加赞赏,但是,虽然“视觉和推理都有很大的突破,但是离真正的AGI还有很长的路要走,今后需要更加智能化的目标导向和试错机制。

Gemini 2.0 Flash

上海人工智能实验室主任助理、领先科学家乔宇在会议圆桌论坛阶段也表示,在通往AGI的路线上仍需突破3。~目前,大模型并不具备人类推理、情感、伦理等战略思维能力。“这并不意味着Scaling。” Law将被抛弃,而应该找到一个新的Scaling。 Law层面,很多难题不能简单地通过扩大模型规模、数据、计算率来解决,我们应该有更丰富的模型结构和更有效的学习方法。同时,我们也希望在AGI发展中,能够从中国做出关键贡献,找到更符合中国资源优势的独立技术路线。”。

“中国思考”面向2025

所以,面对即将到来的2025年,当OpenAI、当谷歌抛出一个又一个“王炸”时,中国科学家将携手突破哪些领域?

经过两年的“疯狂”,大模型的发展目标逐渐分化:有些人在数学、物理等尖端问题上寻求解决高难度的科学问题,探索大模型的上限;其他人更注重大模型的落地和稳定性,期待提高模型的下限。

上个月,上海人工智能实验室在第一阶段建立并发布了强推理模型学者InternThinker。面对复杂的推理任务,它不是从大量的样本中学习单点知识,而是学习人类的思维模式——先回忆所需的知识,然后逐步推理计算,最后给出准确的答案。若某一推理路径失败,则能迅速调整思路,尝试新的解决方案,体现独特的深度推理与专业泛化能力的融合。

通过这种方法,InternThinker在处理“24点”等高难度数学题和编程题时表现出了出色的能力,不仅完成了答案,还进行了系统的自我检查和反思,确保了结果的准确性。

上海人工智能实验室龙头科学家欧阳万里表示:“如果通用大模型已经有了高中知识,那么专门的大模型就是在此基础上学习大学的专业知识,希望将来能够慢慢将大学知识融入高中教学。实验室正在进一步探索通用专业相结合的技术路线。

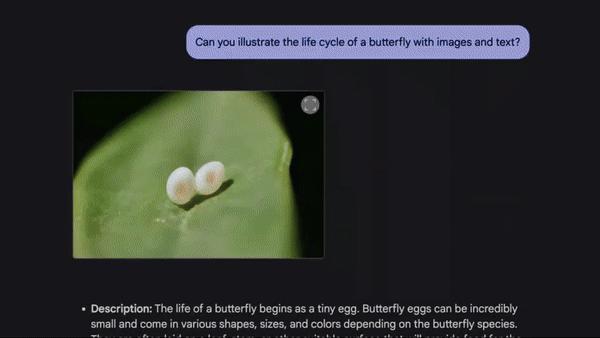

乔宇希望在新的一年里,多模态模型的出现能力能够像语言模型一样取得重大突破。上海人工智能实验室最近发布的学者万象2.5已经在多模态思想链中(Chain-of-Thought CoT)在MMMU检测(大规模多学科多模态理解和推理基准测试)上取得突破,成为第一个超过70%的开源多模态大模型。

张祥雨还希望实现对多模式大模型的理解和整合,在视觉空间中可以直接理解和完成视觉推理。在新范式的支持下,Scaling Law再一次与智能水平的发展成正比。

刘知远教授团队在清华NLP实验室提出了大模型密度定律(densing law):自2023年以来,模型能力密度随着时间的推移呈指数级增长,每100天左右翻一番,这意味着目前训练出来的一个模型,在100天之后,只需要一半的参数值就可以实现相同的能力。

基于这一规律,一年后,一个58B参数大模型可以再现750B参数大模型的相同效果。同时,随着芯片电路密度(摩尔定律)和模型能力密度(密度定律)的不断增加,PC等主流终端、移动电话可以运行更高的能力密度模型。

“我们大胆预测,只要是世界上可以训练的模型,未来一定会在某个时刻在终端上运行,这也揭示了终端智能的巨大潜力。”刘知远认为,未来不仅要追求更大的模型,还要追求更高的模型制造技术,寻找更陡峭的增长曲线,让大模型实现高质量、可持续的发展。

“和100多年前的物理领域一样,目前的人工智能领域也有两个乌云:一个是下一代智能系统必须有自主持续增量学习的系统,更接近人类的个人智能;另一种是必须取代DP(动态规划)路线,自主学习必须局部高效。目前(大模型得到同样的结果)的能耗比自然高8。~9个量级。”马毅希望参加会议的年轻科学家能够“吹散”这两朵乌云。

万事开始依然是“人才”

事实上,上海人工智能实验室举办“浦江AI学术年会”的初衷是为了推动“以问题为导向”的学术讨论在年会的基础上深入开展,通过高质量的问题激发更多的创新灵感,“互相提问,互相配合”,实现更高层次的产业合作和协同创新。

大会主席、上海人工智能实验室主任、首席科学家周伯文认为,目前大家都在关注“Scaling Law”,但是接下来“Scaling What"(什么规模)?他认为,除了业界关注的算率、数据和最近的推理时间之外,还要提高研究者的“Scale“同样重要的是,“1911年,只有三个人签署了第一篇关于原子结构的论文,但现在欧洲核子研究中心每次新发现都有数百甚至数千名科学家合作,如何创造性地发挥团队自身的创造力,同时更好地完成团队之间的合作,实现更高层次的Scale,我认为这是Scaling。 下一阶段Law需要研究的问题。”

令人高兴的是,另一位主席、清华大学交叉信息研究院院长、人工智能学院院长、上海期智研究院院长姚期智发现,中国人工智能高端人才培养已经进入转折点,国内大学培养的博士创新成果和工作成果已经可以与国际顶尖实验室“媲美”。这意味着指导这些博士研究团队和教师达到世界最高水平。,下一步,他期待国内高校和科研机构进一步加强对年轻科研人员(博士后阶段)的培养,让他们尽快在人工智能科学的道路上独树一帜。

本文来自微信微信官方账号 “IT时报”(ID:vittimes),作者:郝俊慧,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com