我们离AGI还有多远,左手Transformer,左手世界模型?

"未来的路不会比以前更直,更平坦,但我并不害怕,我眼前还闪烁着路面前的野百合和野蔷薇。"

自1956年达特茅斯会议提出“人工智能”概念以来,实现人类水平的智能一直是人工智能领域的“圣杯”。去年上半年,一些主流研究人员指出,大语言模型已经表现出“通用人工智能的火花”(sparks of AGI)。看起来AGI已经从哲学猜测变成了一个触手可及的未来。

今年早些时候,马斯克预测AGI可能会在2026年投入使用。首席AGI科学家ShaneepMind创始人 在一次采访中,Legg认为,在2028年,人类开发第一个AGI的概率为50%。最近,OpenAI CEO Sam Altman表示,AGI将于2025年实现,通往AGI的道路已清晰可见。

然而,业界对AGI有不同的看法。有些人把它当成洪水猛兽,有些人把它当成另一场技术革命,这引起了关于AGI发展路线的争论。在这种背景下,我们不禁要问:实现AGI还有多远?

AGI的开始是谁?

AGI(Artificial General Intelligence),也就是说,通用人工智能的目标是打造一个具有普遍能力的“人类智能体”,可以像人类一样独立学习、推理和解决不同领域的问题。基本上,AGI是人类对人工智能的终极梦想,除了“自我意识”的形成。

一个完整的AGI需要三个基本特征:第一,它必须能够完成无限的任务,而不是只能完成人们定义的有限的任务。第二,我们应该在场景中独立发现任务,这通常意味着“眼睛里有工作”。第三,它需要独立的价值来驱动,而不是被动的数据驱动。

同时,AGI还应该处理一些关键的技术问题,比如构建智能身体的认知结构,让智能身体在现实世界中有效行动,由价值驱动,与社会现状互动,使智能身体的决策过程透明可解释,与人类建立信任关系。

但是如果对比AGI的三个特征,就会发现大型模型还没有达到AGI的要求。

首先,大模型处理任务的能力有限,只能处理文本领域的任务,不能与物理和社会环境互动。这意味着像ChatGPT这样的模型并不能真正“理解”语言的含义,因为它没有身体去体验物理空间。

其次,大模型不是独立的。它们需要人类具体定义每一项任务,就像一只“鹦鹉”,只能模仿受过训练的文字。真正的自主智能应该类似于“秃鹰智能”,可以独立完成比现在的AI更智能的任务。目前的人工智能系统还没有这个潜力。

第三,虽然ChatGPT在不同的文本数据词库中进行了大规模的训练,包括隐含人类价值观的文本,但它没有能力理解人类价值或与人类价值保持一致,即缺乏所谓的道德指南针。

但是这并不妨碍科技巨头对大型模型的推崇。ChatGPT以OpenAI为基础。、Gemini谷歌、以MetaLlama为代表的大型模型在实用性上显示了AGI的潜力。由于大型模型已经能够完成广泛的各种任务,并表现出像学习新技能这样的“元认知”能力,科技巨头也将大型模型视为迈向AGI的关键一步。

与大模型的“鹦鹉模式”相比,AGI是一种以“小数据、大任务”为结构的“秃鹰模式”。智能体现为独立的智能,能够独立感知、认知、推理、学习和实施,不依赖大数据,基于无标记数据进行无监督学习,智能系统功耗低。就像乌鸦喝水一样,看似简单,却属于自我推理行为。它是一种由价值和因果驱动的高级智能,也是人工智能未来的发展趋势。

两个技术派系通向AGI。

现在,在通往AGI的道路上,主要有两个技术派系。

一种是Transformer流派,它以OpenAI为代表,利用大数据、大参数、大算率,以自回归的方式走向AGI。今年年初发布的Sora所体现的出现能力,初步隐含了AGI的味道。

另一个是Yannnnn,Meta首席人工智能科学家。 以LeCun为代表的世界模型流派,这个流派认为自回归的Transformer不能通向AGI。Yann LeCun认为,人类和动物可以通过观察、简单的互动和不受监督的方式学习世界知识,这种潜在的能力形成了常识的基础,可以使人类在陌生的环境中实现目标。

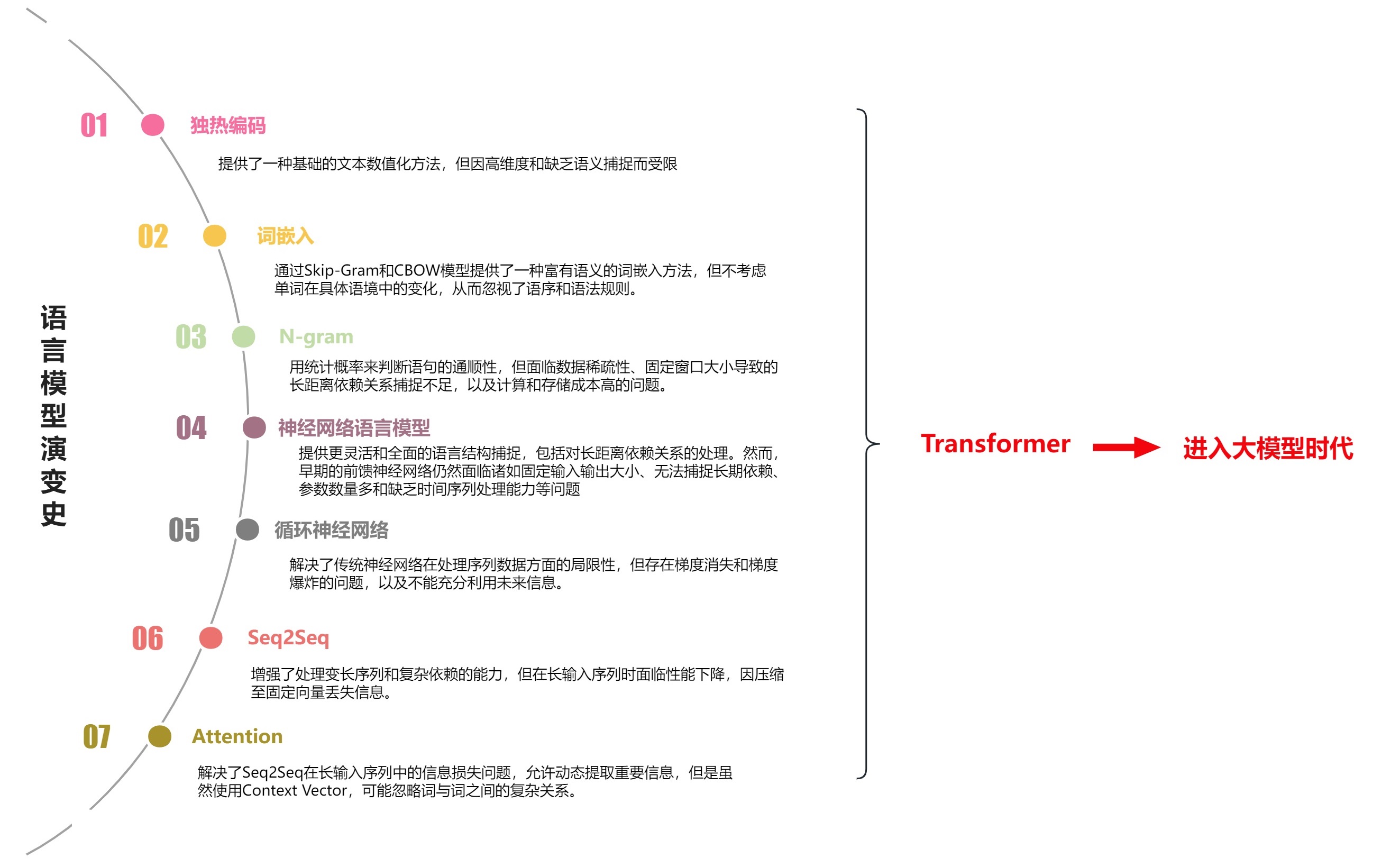

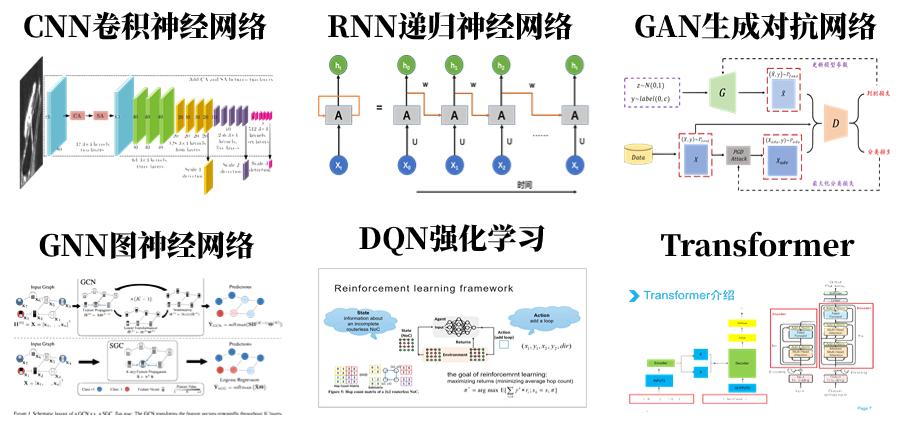

Transformer架构无疑是人工智能发展过程中划时代的创新。这是2017年第一篇论文。《Attention is All You Need》其中,解决了自然语言理解任务中序列到序列转换的问题。

由于其在语言逻辑和生成方面的显著能力,Transformer架构能够在短时间内得到广泛应用。在机器翻译、文本摘要、对话系统等应用中,模型可以通过自注意机制学习文本中复杂的依赖关系,生成连贯而有逻辑的文本。与此同时,Transformer的设计支持并行计算,大大提高了训练效率,使大规模数据集成处理成为可能。

尽管Transformer结构在许多领域都取得了成功,但是它在理解复杂概念和常识推理方面的优势仍然有限。这是因为模型主要依赖于从数据中学习的方法,而不是真正理解这些模型背后的逻辑和原因。这一点在试图实现真正的AGI时尤为明显,因为AGI不仅需要在特定任务中展示人类水平的智能,还需要跨领域学习和适应。

不同于专注于数据的Transformer架构的模式识别和序列处理,Yann LeCun试图通过内部模拟来预测和理解环境的动态变化,以如何让机器像人类和动物一样理解和与世界互动,强调“常识”推理的重要性和基于“世界模型”的预测和规划能力,从而做出更合理的决策。

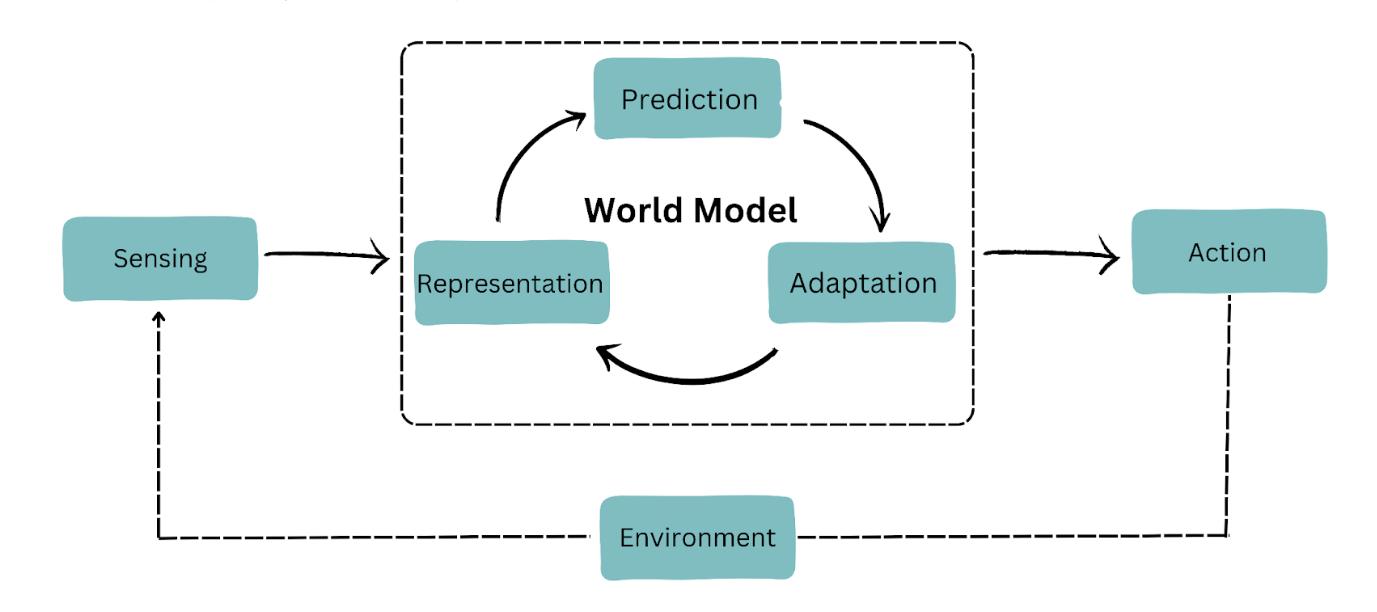

世界模型的基本思想来自于对人类和动物如何理解世界的分析。我们的大脑可以建立一个内部表达,模拟可能的未来场景,并根据这些模拟做出决定。借鉴这一机制,世界模型旨在为人工智能系统提供一种模拟内部环境的方法,使其能够预测外部世界的状态变化,进而在不同的场景下做出适应性决策。

该模型从未标记的数据中学习,无需明确指示即可理解世界动态。该模型结构由六个模块组成,包括执行控制的配置器、了解当前状态的感知模块、预测世界模型、决策成本模块、规划行为的行动模块、跟踪状态和成本的短期记忆模块。

世界模型在强化学习领域已显示出其强大的潜力。通过模拟模型中的环境,人工智能不仅可以在虚拟环境中“想象”行动的后果,还可以在实际行动前评估不同行动计划的效果,大大提高了学习效果和决策质量。另外,在无人驾驶汽车和机器人等自主决策系统中,世界模型可以帮助系统更好地预测和应对可能的变化,提高安全性和可靠性。

世界模型最大的优势在于其环境模拟和预测能力,这促使人工智能系统在资源有限或风险高的场景下,在实际操作前通过内部模拟来评估不同行为的后果非常重要。世界模型还支持决策支持和计划能力的提高,允许系统在许多可能的未来“看到”并选择最佳路径。

然而,世界模型的构建和应用面临着显著的挑战。首先,环境模拟的准确性很大程度上取决于模型的复杂性和数据质量。需要大量的数据和强大的计算资源来准确预测复杂环境下的动态变化,这可能是资源有限的项目的限制。

其次,建立一个可以泛化到各种环境的世界模型是非常具有挑战性的,因为现实世界的复杂性和不可预测性远远超出了目前任何模型的处理能力。

虽然世界模型在理论上有很大的潜力,但在实际应用中仍然存在许多未知数量。例如,需要进一步研究和探索如何保证模型预测的准确性,如何处理模型可能出现的误差,如何在不同的应用场景中调整模型参数以满足特定的需求。

越是竞争,越是结合

Transformer架构和世界模型在实践AGI的道路上,代表了人工智能研究中两种完全不同的设计理念和目标。这两种方法在分析复杂系统、处理未知环境、学习效果等方面各有利弊,引发了关于哪一种更接近实现AGI的热烈讨论。

如上所述,Transformer结构以自注意机制为核心,其设计理念基于对数据关系的深刻理解,非常适合处理实例信息,如文本和表达,这使得Transformer在NLP等自然语言理解领域大放异彩。

相比之下,世界模型更注重模拟和预测环境的动态变化,试图通过建立内部模型来了解外部世界,然后在各种场景下做出适应性决策。这种方法类似于人类和动物如何通过内部表达来预测和规划行为,因此被认为在推广AGI方面具有潜在优势。

Transformer架构通过分析大规模数据集来理解复杂系统,从理解复杂系统和处理未知环境的能力来看,其优点是可以捕捉到深层次的方式和关系。但是,由于Transformer依赖于现有信息中的模式来学习,在未知环境或数据稀缺的情况下,其表现可能会受到限制。

世界模型通过模拟可能的环境状态来理解复杂的系统,尤其是在处理未知的环境时。通过内部模拟,即使是从未直接经历过的,也可以“想象”不同的未来场景。这种能力使世界模型在战略规划和决策支持方面具有显著的潜力。

Transformer架构在学习效率方面可以快速地从大量数据中学习,尤其是在有足够计算资源的情况下。但是,这种方法可能会导致资源使用效率低下,特别是当需要处理特别大的数据集时。

世界模型在学习效率方面的优势是可以通过少量的实际互动有效学习。世界模型可以在不直接与环境互动的情况下,通过在内部模型中“测试”不同的行动策略来改善决策,从而减少学习过程中对实际数据的依赖。

Transformer结构和世界模型在追求AGI的道路上各有千秋,代表了人工智能技术发展的两条不同路径。虽然每一种方法都有其独特的优点和局限性,但未来AGI的实现可能并不完全依赖于单一的技术或方法。相反,结合这两种结构的优点,甚至探索新的技术和理论,将是AGI系统实现真正智能、灵活、适应性强的关键。

例如,利用Transformer结构的强大语言处理能力,或将Transformer模块集成到世界模型的框架中,以提高模型对环境变化的深刻认识。这一结合可能会带来新的挑战,例如如何平衡两种结构的计算需求,以及如何整合它们各自的学习机制。

除了结合当前的结构,AGI还需要探索新的技术和理论,包括开发新的神经网络结构,深入研究大脑和认知科学以获得灵感,或者开发可以跨领域学习和适应的算法。这些新的探索将跨越学科界限,从神经科学、心理学、计算机科学等领域整合知识。它们不仅是人类智慧的伟大成者,也挑战了人类智慧的上限。

现在,我们正处于通往AGI未来的起点。虽然实现它的时间表还不清楚,但技术道路正在逐渐清晰。AGI的进步不仅代表了技术创新,也是对未来人机交互模式的重新想象。2000多年前,苏格拉底说“认识自己”。今天,随着AGI技术的发展,人类需要“重新认识自己”。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com