企鹅兰登要避开AI,但是把头埋在沙子里有用吗?

如果要说目前哪个群体是AI模型的“粉丝”,可能不是学生。是的,与农民工相比,学生现在显然更喜欢AI。根据毕马威最近在加拿大发布的一项研究结果,59%的加拿大学生表示,他们在学习时会使用生成人工智能,这比去年增加了7%。

但是学生的好日子恐怕也很难长久,最近又有一家大型出版集团宣布拒绝人工智能。据海外科技媒体The日前报道。 根据Verge发布的消息,书籍出版商企鹅兰登书店正在以印刷方式解释人工智能训练的立场。新书和复制书的标准版权页面将注明“本书的任何部分都不能用于或复制人工智能技术或系统的训练。”

是的,自从ChatGPT点燃了AI模型和生成式人工智能以来,数字版权问题日益激烈。一方面,AI企业对高质量训练语料材料的需求日益增加,另一方面,出版商想尽一切办法维护他们的版权价值。不幸的是,企鹅兰登书店的努力可能是用螳臂当车,最好是效仿康泰纳仕,把自己的内容卖个好价钱。

为何要这么说?因为现在的现实,大部分AI厂商都反对需要版权许可和支付大模型的训练,只有OpenAI等几家大厂商才真正愿意付费。以谷歌为例,该公司在去年回复美国版权局时表示,如果打开看大模型的预训练流程,从抓取信息、复制输入到处理分析,只有最初的复制行为才能落入版权法的范畴,其他行为不会触发相关法律法规。

事实上,从技术原理来看,AI模型记住的是统计关系,而不是文本本身。ChatGPT等产品最终导出的结果是联想而不是复制,版权作品不会通过数据库再次浏览,作品的相关内容也不会直接复制粘贴。因此,大量AI厂商普遍不愿意为语料资源付费的关键因素是他们的行为不违反版权保护。

更重要的是,大模型的练习和内容生成所呈现的“黑箱”特征极难通过技术手段追溯数据,传统的按比例直接划分为这种方法不再适用。事实上,AI制造商不愿意付费并不是一个大问题。真正的问题是,语料数据的耗尽很可能是一个谬论。

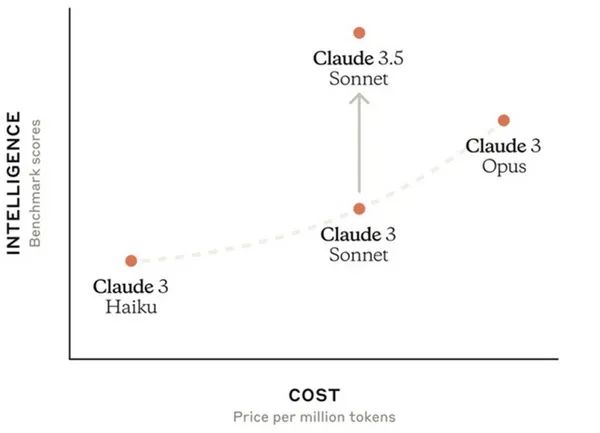

现在在AI行业,OpenAI和Anthropic两个独角兽的大模型在性能上一骑绝尘,远远优于Meta的LLama。、谷歌的Gemini。而且OpenAI背后的微软,Anthropic背后的亚马逊,都不是以社交和搜索来称呼的,所以私人语料材料的规模要比谷歌和Meta差得多。

举例来说,OpenAI训练ChatGPT的45TB数据,主要来自Common Crawl、维基百科和美国专利文件数据库都是公共数据。换句话说,如果大模型真的以语料为王,那么谷歌目前最强的Gemini 1.5 Pro的表现不会像GPT-o1那样糟糕。所以一个可能的事实是,语料本身的重要性可能不如数据清洗。

如果越来越多的厂商发现,高水平的数据清理仍然可以从“脏数据”中洗出高质量的数据,而不是高价购买出版商手中的数据。特别是不久前,OpenAI曝光ChatGPT会“看菜”,登录名称可能会影响聊天机器人的响应,反映有害的刻板印象。对OpenAI的猜测是一个刻板印象,很可能来自AI培训使用的数据集。

要知道AI是否会有歧视等伦理问题,一直是外界关注的焦点,以至于AI厂商要花很多时间去校准AI的价值观,让他们认识到世界的概念,更接近人类。现在OpenAI主动暴露ChatGPT的问题,很有可能会导致其他厂商对培训数据更加谨慎,数据清理更加彻底。

现阶段AI厂商几乎用尽了公共词库,但语料材料的功效没有想象中的那么可能也是事实。因此,对于企鹅兰登书店等版权所有者来说,AI厂商的场景不一定会发生。虽然现阶段对人工智能说“不”可能会吸引一些担心被AI取代的创作者,但AI已经渗透到社会生活中是大势所趋,抵制几乎没有意义。

在这个阶段,更有价值的是讨论如何缓解训练数据版权所有者和AI开发者之间的紧张关系,建立互利的收入共享计划可能是打破游戏更有效的方法。只有这样,我们才能保护数据提供者的合法权益,同时鼓励创新。

[本文图片来自网络]

本文来自微信微信官方账号“三易生活”,作者:三易菌,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com