硅谷中美具身智能企业圆桌讨论:四大核心问题的行业解法

文|周鑫雨

编辑|杨轩

规模化落地已经成为2026年全球具身智能从业者共同瞄准的核心目标,行业竞速已经清晰摆在了各家企业的产能数据、招股文件与出货量报表中。

今年以来,国内企业的量产速度格外抢眼:智元机器人的第1万台量产机器人仅用三个多月就完成了从5000台到10000台的跨越,顺利下线;宇树科技披露的招股书也展现了凶猛的商业化态势,2025年全年营收达17.07亿元,出货量突破5500台。

亮眼数字的背后,是主打「高性价比」的中国具身智能产品在全球市场的快速扩张。宇树科技创始人王兴兴就在2025年世界机器人大会上公开表示,过去几年公司海外营收占比始终保持在50%以上。

在国内一众新兴具身智能企业中,由追觅在2024年孵化的魔法原子MagicLab是入行最晚的玩家之一,近期这家公司提出了一个相当激进的远期目标:到2036年实现140亿美元的年营收。

为了推进全球品牌布局,魔法原子直接把新品发布会搬到了硅谷。美西时间2026年4月28日,全球具身智能创新大会(GEIS)在汇集了Adobe、TikTok、IBM等科技巨头的圣何塞举办。

会上,魔法原子的MagicBot Z1机器人还现场为张艺兴进行了操作展示,本文图片均为作者现场拍摄

本次大会上,魔法原子一次性发布了从底层模型到本体硬件的一整套新产品:

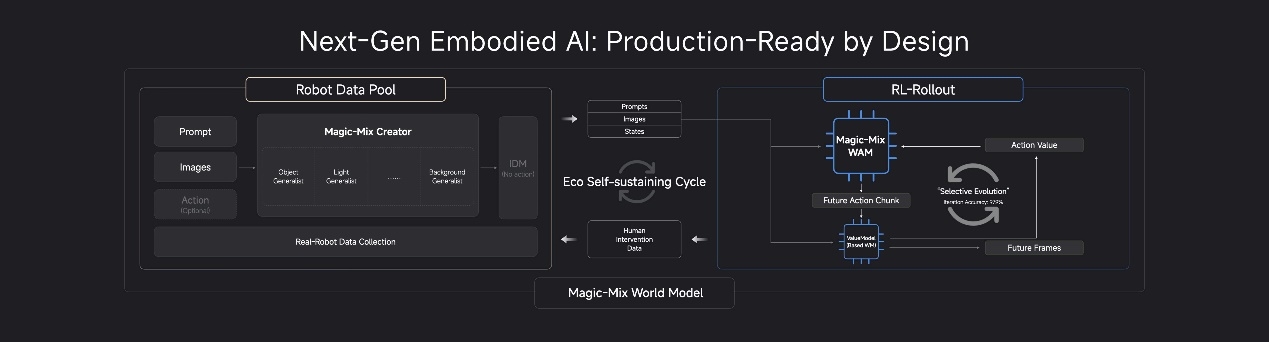

世界模型Magic-Mix:这是魔法原子自研的自主进化模型,由两大核心引擎构成——负责让机器人理解真实物理世界的Magic-WAM,以及支持离线批量生成训练数据的Magic-Creator。这套架构让Magic-Mix可以进入「数据生成-模型训练-真实场景反馈-二次生成数据」的闭环,实现模型的持续自主迭代升级。

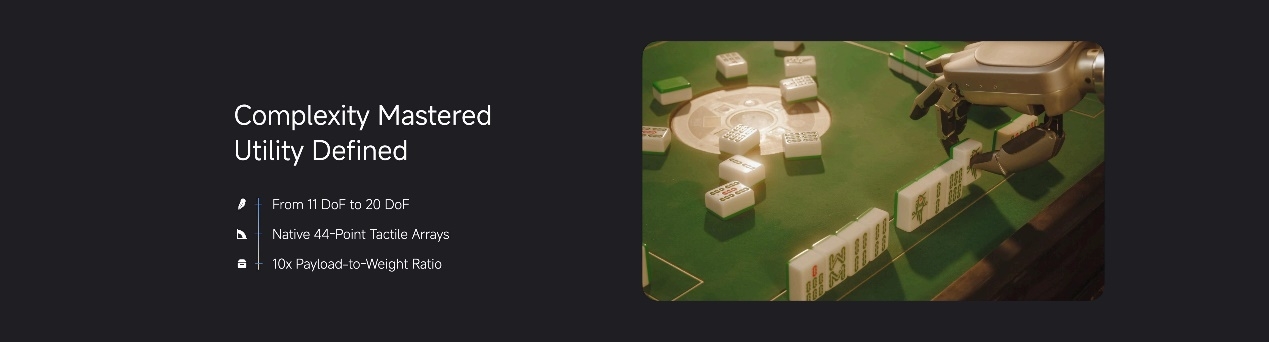

灵巧手MagicHand H01:整手具备20个自由度,接近人手24-27自由度的水平,同时搭载了44个高分辨率三维触觉传感器,主打工业制造、生活护理等对精细操作有要求的场景。

人形机器人MagicBot X1:这款人形机器人身高180cm,体重70kg,全身配备31个主动自由度,最大关节扭矩可达450N·m,搭载了支持无限续航的双电系统,可以实现7*24小时连续作业。产品分为两个版本:标准版主打商业落地,开箱即可部署;科研版则面向高校、实验室、开发者与产业合作方,开放底层二次开发权限,同时支持外形定制。

本次大会还邀请了Openmind、PrismaX、Chestnut Roborics等多家硅谷本土的具身大脑与本体企业参会,现场嘉宾围绕数据、模型、硬件、落地四个行业最关心的核心问题,分享了中美从业者的不同思路与解法,以下是本次讨论的整理:

机器合成数据训练效果,会比真实数据更好吗?

高质量训练数据稀缺,长期以来都是限制具身智能模型发展的核心瓶颈。目前真机采集数据不仅成本高、周期长,也很难覆盖全场景的各类需求。

用机器合成训练数据,是行业提出的一个核心解决方案,但合成数据一直存在真实物理信息缺失的问题,比如接触面摩擦系数、动作延迟、触觉反馈等细节很难1:1还原,业界一直担忧模拟数据和真实场景之间存在难以跨越的「仿真到现实鸿沟(sim-to-real-gap)」。

混合数据训练,是当前中美从业者达成共识的主流方案。魔法原子总裁顾诗韬介绍,公司目前日均可以采集约16000条真实数据,再通过数据合成技术将整体训练数据体量扩充一万倍。她提到,新能源汽车制造业迭代速度快,60%-70%的工序都需要人工操作,是天然的真实数据采集富矿。

当前行业已经形成共识:选择真实数据还是合成数据,要根据具体的训练目标和应用场景判断,不能一概而论。

亚马逊前沿AI与机器人研究院科学家Haozhi Qi指出,合成数据适合用来训练机器人掌握单一基础反应技能,但很难让机器人学会制作早餐这类需要多步骤衔接的长程复杂技能——想要还原这类任务,构建足够丰富模拟环境的成本太高,这种场景就必须引入真实数据训练。

英伟达GEAR Lab高级研究科学家Zhengyi Luo则透露,自己团队目前采用的数据配比是:50%模拟数据用于基础训练,15%动作捕捉数据加25%互联网视频数据用于让模型学习理解人类动作,最后再加入10%高质量真实场景数据完成训练。他还提到,现在已经有企业会用公开社交媒体上的内容,作为机器人本体设计的参考。

VLA(视觉-语言-行动)是具身智能「大脑」的最优解吗?

凭借出色的任务泛化能力,VLA已经成为当前具身模型最主流的架构方案。

但一个很直观的例子就能看出它的局限:人类转动指尖的篮球时,只需要触觉和本体感知就能完成,不需要视觉介入——这说明VLA架构在触觉和本体感知两个维度存在明显短板。

在本次GEIS大会上,Haozhi Qi给出了自己的观点:VLA成为主流,其实和当前硬件传感器的发展阶段直接相关:如今视觉传感器技术已经相当成熟,但触觉传感器还处于发展初期,技术并不完善。

因此,具身系统需要用其他成熟的感知输入,来补全还不够成熟的触觉传感短板,才能支撑机器人完成正常操作。从这个角度来说,用视觉和语言补足触觉缺陷的VLA,确实是当下条件下最好的解决方案之一。但未来随着传感器和硬件技术进步,具身模型的算法架构也会随之迭代升级。

灵巧手三条技术路线比拼:连杆、腱绳与直驱

当前灵巧手设计领域最核心的争论,就是要不要做和人手高度相似的设计。围绕这个问题,行业分化出连杆、腱绳、直驱三种不同技术路线。

三者各有优劣:连杆结构最不像人手,但成本低、控制难度小;腱绳结构最接近人手构造,可以完成高精度精细操作,但成本高、控制算法难度大;直驱则是介于前两者之间的折中方案,把驱动单元直接集成在每个关节上,但不仅成本偏高,在力传导效率和热管理方面还存在不少工程难题待解决。

融合多种路线的混合架构,是近期兴起的新技术方向。Chestnut Robotics创始人、前特斯拉Optimus灵巧手核心成员Evan Tao介绍,自己的团队就选择了混合架构方案:以能完成精细操作的腱绳结构为主体,搭配AI控制和自主学习系统。他认为未来所有灵巧手方案,都会在操作灵活度和工程可靠性之间寻找平衡。

机器人怎样才能实现真正的规模化落地?

在数据层面,引入真实世界数据,依旧被认为是让机器人真正理解应用场景、学会复杂任务操作的核心。

XGSynBot CEO Zizheng Li介绍,公司采用的混合数据策略也会加入少量高质量真实数据,这样既能控制整体采集成本,也能有效提升模型能力和泛化水平。

在系统架构层面,Zizheng Li认为机器人需要从「单一功能设备」向「多任务通用平台」升级,比如XGSynBot的机械臂就配备了支持6种快拆的模块化结构,这样一台机器人就能在不同工序之间灵活切换,能适配更多不同的落地场景。

最后OpenMind创始人、斯坦福大学生物工程副教授Jan Liphardt总结了参会者的共同观点:让机器人进入真实世界,越早越好。

他发现,实验室环境根本无法模拟所有现实中会遇到的复杂场景:过强的环境光线、泥泞潮湿的地面、生锈卡顿的门铰链、多个系统同时运行带来的负载压力——这些复杂的细节,往往是机器人离开实验室后出现系统故障的原因。

因此,机器人不应该在落地前一直待在实验室里打磨。Jan Liphardt建议,开发者应该尽早让机器人进入家庭、学校、机场、幼儿园等各类真实公共场景完成实际部署,在真实交互中收集数据,实现持续迭代。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com