医疗AI的伦理之约:技术创新与责任边界的平衡之道

当全球AI竞争聚焦于“更大参数、更高性能”时,Hippocratic AI与Abridge这两家特色鲜明的医疗科技企业,正悄然重塑行业规则。

一方是坚守“安全至上”的伦理践行者:Hippocratic AI以医学伦理基石为名,创始团队来自斯坦福医学院与顶尖AI实验室,致力于打造绝不越界的医疗对话系统。

另一方是专注“单点突破”的效率革新者:Abridge源于卡内基梅隆大学的人机交互研究,由连续创业者引领,聚焦医疗记录这一核心痛点,绝不涉足临床决策领域。

它们看似选择了不同路径,却共同印证了一个反常规的事实:在高风险的真实医疗场景中,AI最具价值的能力或许不是“无限生成”,而是“精准克制”。

01┃被搁置的“理想模型”:技术超越责任框架的警示

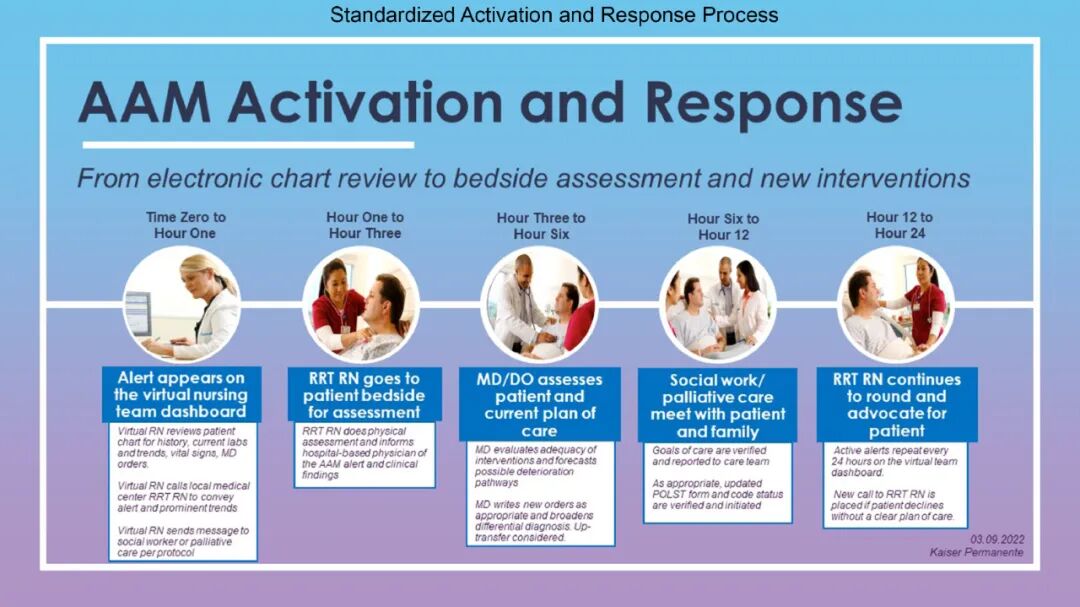

医疗AI发展史上有一个关键转折点。据《华尔街日报》等媒体报道,数年前,美国凯泽医疗集团内部研发出一套可提前数小时预测患者病情恶化的AI系统。测试中该模型表现优异,能提前识别超80%的潜在ICU病例,理论上每年可避免大量医疗危机。但在临床部署前的最终评审中,项目被紧急叫停。

这一决定背后,隐藏着比技术性能更根本的问题。《新英格兰医学杂志》对此总结道:“在医疗AI领域,问责制是比准确性更核心的障碍。”当算法判断直接影响人类生命时,责任划分与权力边界便成了无法回避的根本问题。

02┃Hippocratic AI:将医学誓言融入算法基因

Hippocratic AI于2025年完成1.26亿美元C轮融资,估值约35亿美元,累计融资超4亿美元。本轮由Avenir Growth领投,投资方包括Andreessen Horowitz (A16z)、General Catalyst、CapitalG(谷歌成长基金)等一线机构,彰显资本对其“安全可控医疗AI”路径的高度认可。

“首要原则是绝不伤害病人”——这句医学伦理核心原则,被Hippocratic AI转化为可执行的工程约束。该公司创始团队来自斯坦福医学院与顶尖AI实验室,目标并非打造“无所不能”的医疗AI,而是创造“永远不越界”的对话系统。

Hippocratic AI的响应机制体现了这种安全优先的理念。据其技术演示显示,当对话涉及诊断建议或用药指导时,系统不会尝试回答,而是立即停止生成内容并建议转接人工。即便患者未直接询问,只要对话中出现“胸痛、呼吸困难和家族病史”等高危组合,系统也会自动提升警戒级别。

最受关注的是其系统架构设计。根据Hippocratic AI在行业会议上的披露,最新“北极星”系统拥有超3万亿参数,由数百个专门训练的大模型组成“星座系统”。这些模型各司其职:有的核对药物名称,有的检查剂量安全,还有负责“说话”的主模型确保对话流畅。它们互相监督、交叉验证,如同顶级医疗团队协作。

该公司技术负责人在采访中解释:“我们训练AI通过专业护理考试,不是为了让它替代护士,而是让AI更准确理解哪些问题自己无权回答。”这种在能力边界的克制,正是Hippocratic AI最核心的创新。

03┃Abridge:智能“记录员”,不做“决策者”

Abridge于2025年完成3亿美元E轮融资,由Andreessen Horowitz(a16z)领投,Khosla Ventures等参投,估值约53亿美元。截至目前,Abridge累计融资近8亿美元,已在上百家美国医疗系统落地,成为生成式医疗文档赛道中规模效应突出的公司之一。

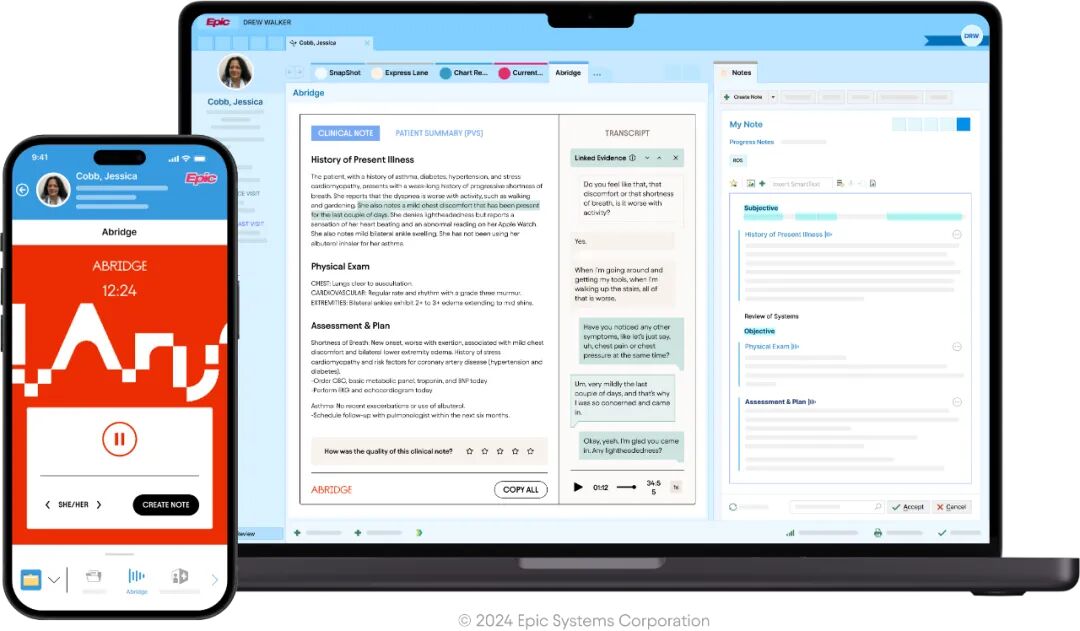

若说Hippocratic AI的策略是“在边界设防”,Abridge则选择了更彻底的路径——从一开始就不进入决策领域。这家源自卡内基梅隆大学的公司定位为“AI医疗记录员”,核心功能简单明确:在医患交谈中,自动将对话转化为结构化临床记录。

Abridge的影响力可通过数据体现:据STAT News报道,该公司已被美国300多家医院采用,包括梅奥诊所、约翰·霍普金斯医学中心等顶级医疗机构。医生反馈数据显示,使用后平均每天可节省约2.5小时文书工作时间。

更深刻的影响体现在医生职业体验上。医疗媒体《凯撒健康新闻》报道了多位医生的经历:一位从业多年的医生坦言“原本每天带工作回家,现在不用了”;另一位表示“有人说‘从医的快乐回来了’”;更有医生直言“这甚至可能延长我的职业生涯”。

正是这种清晰的自我限定,让Abridge快速通过严格的医疗合规审查。“我们不做诊断,只做诊断过程的记录者。”Abridge CEO这样定义公司边界,“这种克制不是能力不足,而是战略选择。”

04┃从医疗到多领域:高价值AI系统的“停机逻辑”

医疗领域的实践揭示了一个普适原则:任何高影响力AI系统的长期价值,不仅取决于它能做什么,更取决于不该做什么时能否可靠停止。这一“安全优先”理念正在多个关键领域成为新标准。

在金融交易领域,顶级投资机构为AI系统设置的“熔断机制”体现了同样逻辑。彭博社报道显示,多家对冲基金在2020年市场剧烈波动期间,依靠这种机制避免了灾难性损失。一位基金经理坦言:“极端市场环境下,不亏钱比赚钱更重要。”

在自动驾驶领域,Waymo等公司的“责任敏感安全”模型要求车辆在任何情况下,都不得为避免事故采取违反交通规则或危及他人的操作。公司工程师在接受《麻省理工科技评论》采访时解释:“我们的AI首先遵守交通规则,其次才是应对突发情况。”

在法律辅助场景,AI系统设计同样遵循明确能力边界。斯坦福大学一份研究报告指出,这些系统可提供案例参考和风险因素分析,但绝不能给出具体判决建议——最终裁量权必须保留在人类法官手中。

05┃新创新模式:在约束中创造价值

医疗AI实践正揭示一个清晰的行业共识:在风险不可逆的关键领域,衡量AI系统的标准正在改变。系统核心价值不再仅取决于“运行效率”,而更偏向“可靠停止”的能力。这种对“主动设限”的追求,正在重新定义多个前沿行业的竞争逻辑。

这一系列变化将企业创新方向推向更深刻的层面。创新焦点从追求模型理想状态下的“峰值表现”,转向构建系统最恶劣情境下的“底线保障”。市场竞争逻辑从比拼“功能广度”的军备竞赛,演进为定义并让人信服“责任边界”的信任博弈。同时,优秀产品设计不再只关注日常“交互体验”,还需规划关键决策点人类专家平滑介入的“接管流程”。

这场转变本质是价值观的工程化革命。它将“安全”“责任”“伦理”这些抽象理念,转化为具体、可测试、可迭代的工程特征,并前置到产品设计源头。最终企业交付的不再仅是提升效率的技术工具,而是完整可信的风险管理方案。在这个模式下,最坚固的商业护城河由最精密的“刹车系统”构筑。大智知止,明者善约。

本文来自微信公众号“硅兔君”(ID:gh_1faae33d0655),作者:硅兔君,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com