“AI‘胡歌’竟让反诈领导‘扑空’?上海警方最新通报:已抓获1244名诈骗嫌疑人!

AI‘胡歌’

骗了反诈中心的领导?

11月23日

上海市反电信网络诈骗中心

发布了一条既有趣又发人深省的视频

视频里

反诈中心的领导

接到了‘胡歌’打来的视频通话

于是特意找到胡歌本人核实

结果发现……对方竟是AI伪造的!

网友们纷纷留言:

太有创意了,笑到停不下来

这波反诈宣传很接地气

得警惕AI诈骗啊!

这条视频看着让人忍俊不禁

可要是自己真遇上类似的诈骗

估计就笑不出来了

下面是闵行警方公布的反诈数据

看完让人十分震惊

↓↓↓

今年以来

闵行警方通过“取现”交易拦截

资金查扣冻结

以及现金流追踪溯源等方式

查扣、冻结涉案资金超5000万元、

黄金5800余克、

抓获犯罪嫌疑人1244名

近日,闵行警方举行了返还仪式

向受害群众集中返还了

电信网络诈骗案件中

拦截到的资金540多万元

在发还现场,市民赵先生向记者讲述了自己被骗的经历。几个月前,他在某网络平台加入了一个投资理财群,群里的“投资老师”自称掌握内幕消息,还承诺跟着他操作短期内就能获得高额回报。

赵先生说:“他们说要是操作得好,一个月收益可能翻倍,因为有老师带着,那老师还说自己在里面赚了几千万呢。”

看到群里不断有人晒出“高额收益”的截图,赵先生一时冲动,给对方转了130万元。转完账后他才察觉不对劲,马上报了警。警方迅速联合银行启动止付程序,在资金被骗子取现前成功拦截了这笔钱。

闵行公安分局刑侦支队民警谭道松表示:“我们其实是在和骗子抢时间,只要能比他们快一步冻结银行卡,被骗的钱就有可能追回来一部分。”

大家一定要提高警惕

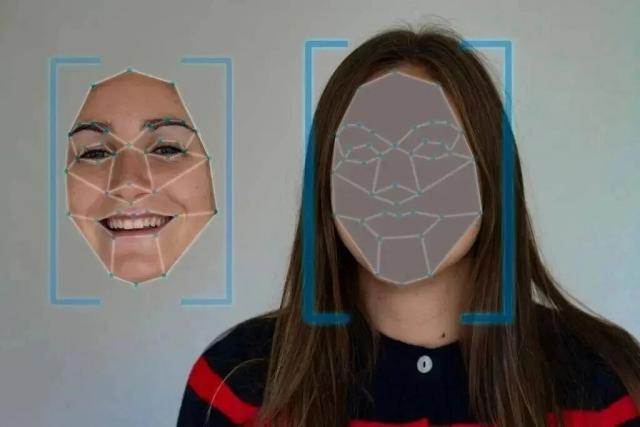

如今,AI技术正快速融入我们的生活,带来了不少便利。但技术是把双刃剑,不法分子会利用AI的换脸、变声、精准信息分析等功能,设计诈骗陷阱,让“眼见为实”“耳听为真”的传统判断方式不再可靠。大家务必保持警惕,保护好自己的财产和信息安全。

01

案例速递

一天,老李正在上班,手机突然收到一条陌生短信,还附带一张模糊的老照片。照片里是个穿旧棉袄的小女孩,老李一眼就认出那是童年时的姑姑。他正疑惑许久不联系的姑姑怎么突然找自己,紧接着就接到一个电话,电话那头传来姑姑苍老虚弱的声音,要求他支付赎金,还反复叮嘱不能报警。老李没多想,直接就把钱打了过去。

老李不知道的是,这是一个诈骗团伙。他们用AI修复技术,把从网上搜集来的老照片修复加工,伪造成受害者失联亲人的童年照,再用AI语音合成技术模拟出老年人的声音,编造绑架勒索的谎言实施诈骗。

02

诈骗套路

声音合成:骗子通过骚扰电话录音提取他人声音,获取素材后进行合成,用伪造的声音欺骗对方。

AI换脸:骗子先分析公众在网上发布的各类信息,结合要实施的骗术,用AI技术筛选目标人群,在视频通话时用AI换脸骗取信任,进而实施诈骗。

转发语音:骗子盗取社交账号后,会向账号好友“借钱”,为取得信任,他们会转发之前的语音来骗钱。

AI程序筛选受害人:骗子用AI分析公众在网上的各类信息,根据骗术筛选人群,短时间内生成定制化诈骗脚本,实施精准诈骗。

AI技术能让不法分子轻松“换脸变声”,大家要注意:“眼见”未必为实!下面教你如何辨别AI诈骗:

动作验证法:当视频里的对方(尤其是涉及转账、借钱等敏感要求时)看起来有点“奇怪”,别急着答应。可以让对方做连贯的转头动作,或者用手掌完全遮住脸再快速移开。目前的AI技术在模拟这些复杂的面部遮挡和光影变化时,容易出现卡顿、模糊或扭曲的情况。

声音细节辨真伪:留意语音细节。AI生成的语音有时缺乏自然的呼吸停顿、情感起伏,或者带有轻微机械感、背景杂音异常。如果对方声音“和平常不一样”,一定要提高警惕。

多渠道核实身份:不管视频、语音多逼真,涉及金钱交易或敏感信息时,一定要通过其他可靠途径二次确认。比如挂断后直接拨打对方常用且你熟悉的电话号码(别回拨可疑来电),或者通过共同认识的第三人侧面核实。

编辑:小冉、小刘

审稿:卞英豪

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com