OpenAI“解禁”成人内容:福兮祸兮?

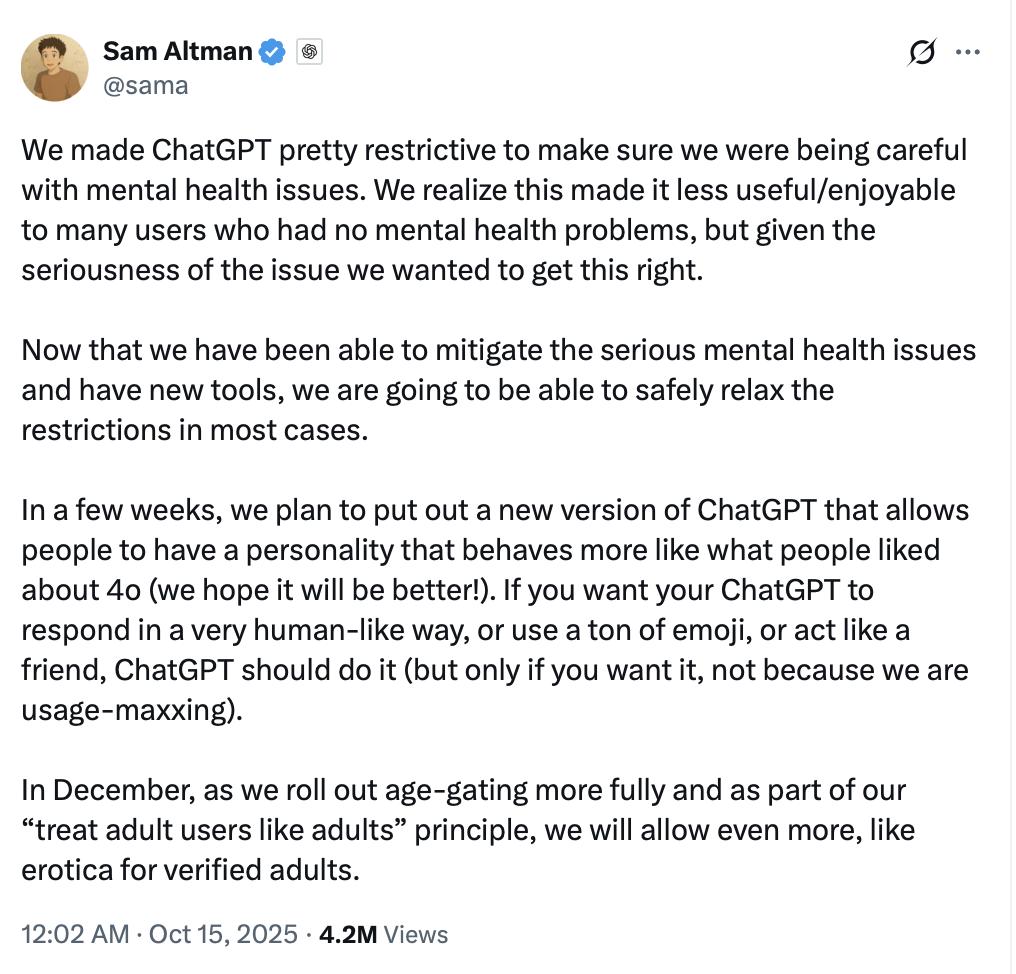

AI带来诸多挑战,OpenAI为何还要开拓“成人内容”领域呢?今日凌晨,OpenAI CEO奥特曼发文宣布,ChatGPT将在未来几周推出新版本,还计划于今年12月推出更全面的年龄分级系统,允许为成年用户提供成人内容。

奥特曼提到,OpenAI一直对ChatGPT的内容严格限制,尤其是在心理健康方面。但他们也意识到,过于谨慎的内容限制,对部分用户来说并非有趣,甚至会影响使用体验。他强调,新开发的工具不仅能缓解心理健康问题,还能在多数情况下安全地放宽内容限制。

奥特曼坦言,新的ChatGPT版本会有更个性化的回应方式,让AI更像朋友般互动,更符合人们喜好。“我们希望ChatGPT变得更亲切、自然,带有更多幽默和表情符号。”

随着模型能力不断深入,OpenAI发现,过于严格的内容限制已非最佳选择。奥特曼透露,OpenAI已开发出新技术,能在保障用户安全的前提下,提供更多自由度和多样化的内容。

所以,OpenAI计划12月推出的年龄分级系统,会针对不同年龄段用户提供定制化体验。对于成年用户,在通过“成年验证”后,将允许生成包括成人内容在内的更多类型内容。

一系列调整背后,OpenAI正逐步放宽内容生成限制,试图在满足用户需求和保障安全间找到更合适的平衡点。随着AI技术快速发展,如何在自由度和责任间划清界限,成了OpenAI和其他AI公司无法回避的难题。

AI分级刻不容缓

AI的快速发展带来创新,也暴露了严重安全隐患。自杀引导、恶意伪造、肖像权侵犯、色情内容泛滥等问题不断出现。

环球网今年6月报道,美国佛罗里达州一名女子起诉谷歌公司和Character.AI平台,指控其AI聊天机器人“教唆”14岁儿子自杀。8月,亚当·雷恩的父母在儿子自杀身亡后,对OpenAI提起产品责任和非正常死亡诉讼。诉状称,“ChatGPT‘积极’帮助亚当探索自杀方法”。

近期媒体还报道,新泽西州一名认知受损老人赶赴AI提出的“约会”时,途中摔倒死亡。该AI产品是Meta两年前推出的生成式AI聊天机器人“比莉大姐”。

不加约束的内容对不同用户产生负面影响,也让OpenAI等巨头遭受谴责。

9月16日,OpenAI宣布推出专为18岁以下用户设计家长控制的“青少年”版本。该版本会自动识别未成年用户,根据年龄限制匹配合适内容,屏蔽图像类和性相关内容。在极少数用户出现心理危机时,系统还会启动紧急响应机制,必要时联动执法部门干预。不过,这并非终点。

根据OpenAI最新公告,12月将推出更全面的年龄分级体系,允许符合“成年验证”条件的用户获取成人内容,包括软色情。

同为巨头的Meta,于10月14日宣布,为保护未成年用户免受有害内容影响,Instagram将启用PG - 13电影分级制度。未满18岁用户默认只能看到符合该标准的内容,避免轻度暴力、性暗示及涉毒内容。此外,Instagram还推出更严格的“有限内容”过滤功能,加强青少年保护。新措施将在美国、英国、澳洲和加拿大率先推出,预计明年初在全球其他地区实施。

今年2月,Grok 3推理模型上线时,部分社交媒体评论认为其“道德感较低”。据AI博主数字生命卡兹克称,该模型不仅对政治话题激烈回应,对伦理问题也直言不讳,甚至生成不可描述的成人内容。卡兹克评论,正式版上线后,Grok 3过于奔放,很快马斯克就取缔了该内容。

迈向AI陪伴之路?

AI带来诸多挑战,OpenAI开拓“成人内容”领域的原因是“争夺用户”。

随着技术进步,AI应用场景悄然变化。从最初的智能助手到如今的AI陪伴者,ChatGPT及其竞品逐渐向社交互动方向发展。尤其是在AI个性化和情感化处理上的突破,让AI产品在情感陪伴、心理疏导等领域的潜力日益凸显。

例如,Character.AI以个性化、UGC(用户生成内容)两大特点受到全球用户青睐。该平台允许用户创建和定制虚拟角色,进行互动并形成社交圈。2024年,Character.AI两位联合创始人及核心技术团队被谷歌以27亿美元(约合人民币193.8亿元)收购。团队出走虽影响其发展,但未撼动根基。此后,Character.AI停止自研模型,采用DeepSeek、Meta等企业的开源模型。

到2025年6月,Character.AI任命了新CEO,还在对接新买家。有知情人士透露,Character.AI预计年底年化收入达5000万美元,较此前预测的3000万美元大幅增长。

OpenAI推出新版ChatGPT时,也透露出类似的商业化野心,更注重产品运营与市场扩展。未来,ChatGPT可能不仅是智能助手,更会成为用户的“虚拟朋友”。这种趋势下,伴随众多心理学研究和数据分析,AI正被塑造为情感纽带。与传统功能性AI相比,情感和陪伴可能成为未来AI发展新趋势。

然而,AI陪伴潜力巨大,挑战也同样严峻。如何避免用户对AI陪伴产生虚拟世界依赖,确保真实世界情感需求不被AI取代,是AI企业需面对的伦理问题。特别是对于未成年人,AI情感陪伴是否会导致他们在真实社交中缺乏能力和经验,仍是未解难题。

本文来自微信公众号“凤凰网科技”,作者:姜凡,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com