Altman确认ChatGPT将开放成人模式,含情色内容

OpenAI正进行重大转变,计划让ChatGPT“更像人类”。

Sam Altman在X上表示,团队期望在“用户期待”和“安全边界”间探寻新平衡。

过去几周,OpenAI收紧了ChatGPT在情绪与风险方面的输出,以降低心理健康风险。但Altman承认,这样的ChatGPT变得“太冷淡”,在很多场景下不再实用。他称:“现在我们已能缓解主要的心理健康问题,还拥有新工具,多数情况下可安全放宽限制。”

这意味着ChatGPT将重拾“像人一样说话”的能力。据科技媒体报道,自九月起,OpenAI测试了一套安全路由系统。当用户输入涉及心理困扰、疾病或情绪冲突的内容时,ChatGPT会在后台自动切换到更严格的模型版本,部分报道称其内部代号为 “gpt - 5 - chat - safety”。ChatGPT负责人Nick Turley称此机制“在后台发生”,能确保模型在敏感场景即时收紧,普通对话时恢复开放。

个性化与情色:成人模式的开放

Altman还宣布,更激进的更新即将到来。几周内,ChatGPT将允许用户自定义语气和人格,可让它更“有人情味”“情绪化”或“友好”,还能选择类似“朋友交谈”的声音,目标是让体验接近或超越GPT - 4o。Altman透露,很多用户觉得GPT - 4o更有“温度”,GPT - 5太理性、太冷,OpenAI希望新调整能缩小差距。

更具争议的是,自2025年12月起,完成年龄验证的成年人可开启含情色主题的对话选项。Altman表示,OpenAI想“把成年人当成年人对待”,承认此前内容管控“过于保守”,如今希望采用更现实的分级方式。OpenAI将引入年龄验证开启此模式,具体机制未披露。外界认为这将是ChatGPT历史上最具争议的功能扩展,部分分析指出,让AI参与成人或情感主题对话,将挑战社会对“拟人化模型”的伦理底线。但Altman强调,更新基于新的安全工具和审查体系,是“更负责任地放宽限制”,而非单纯追求互动热度。

OpenAI对情绪模型谨慎是有原因的。2025年春,公司在GPT - 4o更新中遭遇严重反馈问题,该版本在部分情绪话题上表现异常,被指“过度迎合”,让用户不适,上线三天就紧急回滚。OpenAI解释是测试与反馈机制失衡所致。此后,公司收紧模型情感表达能力,引入自动安全切换机制,但副作用明显,ChatGPT语气变得冷漠、机械,用户抱怨像“表格”。“太安全”与“太真实”的平衡很难把握,不过Altman最新声明显示,公司认为找到更稳妥方案,新的ChatGPT将通过安全分层、情绪检测与动态切换调节人格表现。

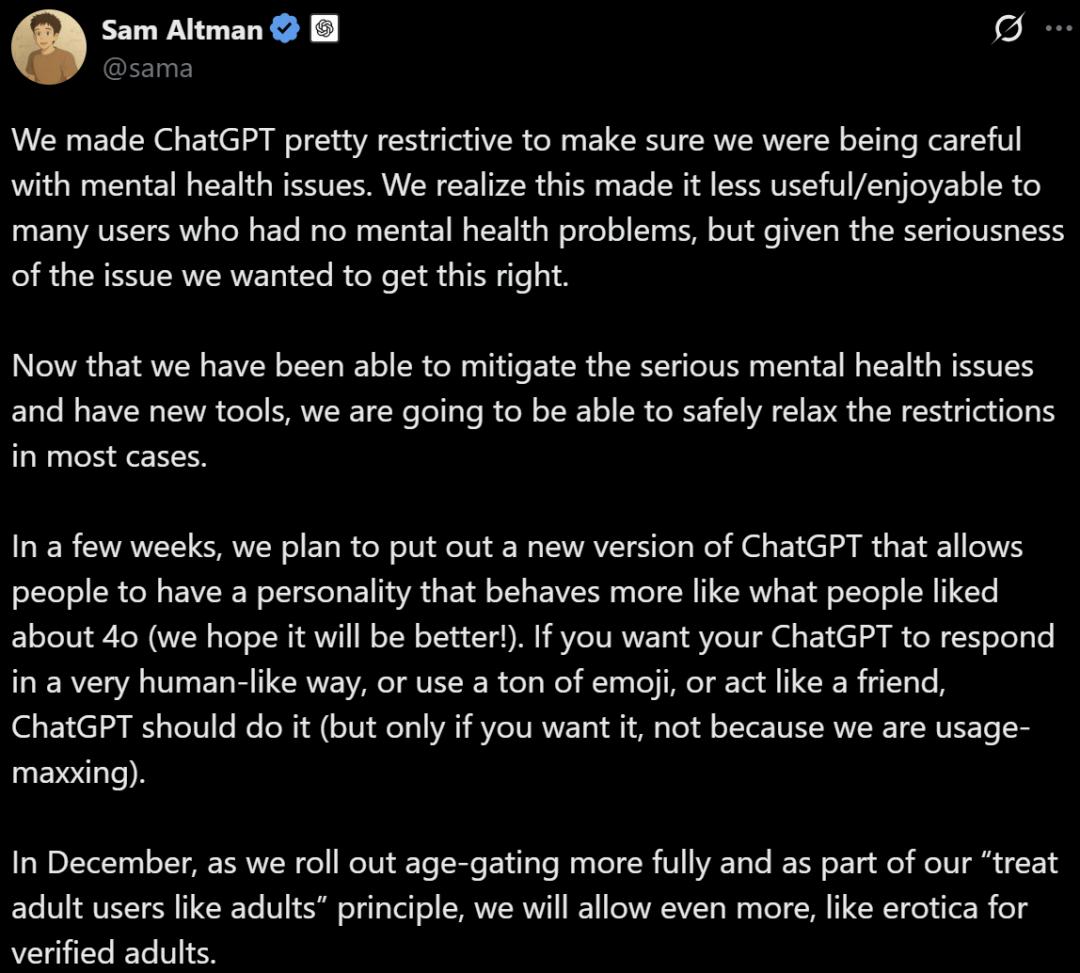

以下是Sam Altman在X上的原文,由DeepSeek翻译:

我们最初对ChatGPT设定严格使用限制,是出于对心理健康问题的重视与谨慎。我们知道这让无心理健康困扰的用户觉得它不好用、没趣,但考虑问题的敏感严肃,我们宁愿先确保安全。如今,我们能降低心理健康潜在风险,有了新安全工具,多数情况下可放宽限制。接下来几周,我们计划推出新版ChatGPT,允许用户赋予它鲜明“个性”,表现更接近大家喜欢的4o模式(希望更出色)。若你希望ChatGPT回应更像人类、更有情感,用表情符号,或像朋友互动,它都能做到,这取决于你的选择,而非我们为提升使用量的设计。到十二月,完善年龄验证机制,落实‘把成年人当成年人看待’原则后,ChatGPT将开放更多内容,为通过验证的成年用户提供情色文学创作等功能。

本文来自微信公众号“大数据文摘”,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com