Sora再一次“期货式”发布,国产大模型早就抢走了,哪一个最好?

Sora来了,但是没有完全来。在12天持续发布会的第三天,OpenAI正式向公众发布了一个AI视频模型Sora。 Turbo,最大支持生成20秒视频,仅为Sora首次发布时宣传时间的三分之一。更加离谱的是,并非任何顾客都能立即体验到Sora。 Turbo,这个应用还处于小范围的测试阶段。

在Sora之前,一些海外AI公司已经开发了视频模型,但直到今年2月Sora首次亮相,视频模型行业才真正进入黄金发展时期。然而,推动视频模型快速发展的Sora似乎落后了。

更不用说我们可能不熟悉的海外了。仅在中国市场,就出现了不少于20个AI视频模型,比如腾讯、阿里巴巴、字节跳动等。互联网巨头,而且每个家庭都推出了AI视频模型。从行业角度来看,AI视频模型赋予了理解和重构真实世界的能力。从用户的角度来看,AI视频模型给了我们无限可能发挥想象力。

与泛用场景的大语言模型不同,大视频模型的应用场景相对更专业,所以现阶段生成视频基本上是需要付费的。免费客户只能收到系统的积分或者每天赠送的频率来生成视频,可能感觉不到一些高级功能。就这样,不关注AI模型的朋友可能不知道国内有哪些大型视频模型。

接下来,小雷将盘点中国目前知名的六款AI模型,分析其功能特点。也许他们将来会成为你把想法和灵感转化为现实的工具。

Sora成了Follower,国产视频大模型抢跑?

国内的视频模型很多,功能和体验也有很大的不同。经过几个月的改进,大部分都可以识别人类的自然语言,而不是依靠限定词来生成内容。这是视频模型的一小步,但却是互联网行业的一大步。只有了解自然语言,我们才能有能力将我们的想法或小说中的内容转化为图像。

如何选择视频大模型,不用担心,跟着小雷一起看看互联网巨头们的视频大模型表现如何,或许你心里就会有答案。

1、可灵:行业先行者,感觉很好。

训练视频模型需要大量的影视资源,视频平台有着与生俱来的优势。Sora发布后仅仅4个月,AI团队就推出了大型视频模型,现在已经演变成了1.5版本。就小雷的感受而言,可灵在国内众多视频模型中排名前三。

可灵支持两种模式:文生视频和图片生成视频(或添加文字说明),并能调整创意想象与创意的联系。可灵1.5模型免费用户使用文字视频功能,最高可生成5秒高质量视频(1.5版本不支持生成标准质量视频,1.0版本可生成10秒标准质量视频)。使用图片视频功能,可生成标准质量最高10秒或高质量视频5秒,支持镜头运输调整。

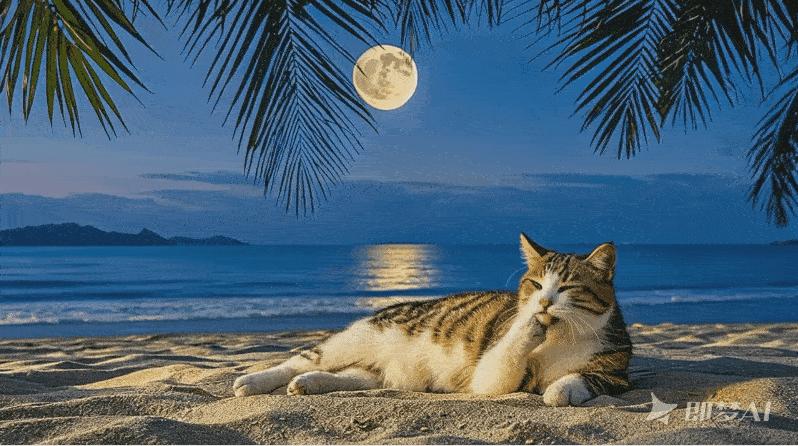

小雷生成了一段描述语“宁静的沙滩,满月高高地挂在天空,微风吹着海边的椰子树,传来哗啦啦的声音,一只小猫懒洋洋地躺在沙滩上,舔着前腿上的头发”的视频。具体结果如下:无论是舔头发还是风吹椰子树,细节丰富程度都很高。唯一明显的漏洞可能是产生的结果是白天,而不是小雷描述的夜晚。

可灵作为我国第一批AI视频大模型,表现极佳,提供了丰富的功能选项。希望灵魂能尽快推出生成视频更长的版本,满足微剧的需求,帮助微剧作者创作视频,降低微剧的制作成本,从而提升灵魂的实用价值。

2、即梦:语言分析能力强,可惜缺乏灵动性。

快手推出可灵后,抖音不甘落后,还推出了视频大模型即梦。

除了文生视频和图生视频,即梦还增加了对口功能,即导入图片和视频后,上传文字或音频,即梦可以调整视频。即梦发布日期较晚,但更新迭代速度极快。到目前为止,官网已经提供了1.2视频。、视频2.0、视频2.0 可以使用三个版本的Pro。

需要注意的是,注册这个大模型需要4/6/8的积分,视频1.2大模型需要4/6/8的积分。视频2.0模型需要5分才能生成5秒视频,视频需要2.0。 生成Pro模型视频需要20分。

用同样的描述语言,小雷使用了即梦视频2.0 Pro模型生成了一个质量相当不错的视频,小雷描述的场景基本都展现出来了。但是这个视频并不完美,比如猫咪的动作太单调僵硬,缺乏灵活性,叶子不随风移动。

即梦对自然语言的理解能力在小雷看来高于灵魂,描述语言中的元素基本都有,但产生的视频质量略逊于灵魂。

3、混合元:功能需要丰富,发展空间大。

谈完快手和Tiktok两大短视频巨头,腾讯自然不能落后。腾讯最近推出了混合元视频模型,并在腾讯元宝App和网页上线。

目前腾讯混合元视频模型只支持文化视频,每天可免费生成4个标准质量和2个高质量视频。小雷还用腾讯混合元模型生成了一个视频。太大的月亮造成了虚假的感觉,猫舔头发的动作充满了不服从。椰子树距离太远,细节不够丰富。

或许是因为诞生时间太短,腾讯混元大模型产生的视频质量不佳,显然不如可灵和即梦。然而,以国内互联网巨头腾讯为后盾,相信经过几次迭代升级,这款大模型产生的视频质量堪比可灵和即梦。

4、Vidu:功能丰富,运镜自然。

Vidu作为北京数学技术与清华联合开发的AI视频模型,可能没有腾讯和字节跳动那么强大,但大模型的表现并没有让步。该模型还推出了1.5版本,支持文学视频和图片视频,并支持从不同角度上传同一主体的照片,从而生成更真实的三维图像。需要注意的是,这种大模式的免费客户只能生成720P视频。

在实际测量中,Vidu产生的视频质量高于可灵和即梦,运镜的自然流畅性强于可灵。细节也很丰富,呈现了海水、椰子树、风等元素。如果你仔细看,你会发现远处有一个身影。唯一的漏洞是海滩缺乏质感。一般只有刚刚落潮的海滩才会有类似的情况。

Vidu的表现已经相当不错了。开放API,探索商业模式后,可以获得大量投资的概率很大。Vidu可以通过这次投资购买芯片和影视资源。Vidu只有拥有足够的影视资源来训练大模型和计算率支持,才能加速前进。

5、清影:同具清华血脉,与Vidu有差距。

前身为清华大学计算机系知识工程研究室团队的智谱清言,与Vidu算得上是同门,甚至更加正统。

智谱清言开发的AI视频大模型清影功能极其丰富,支持文生视频和图生视频,其中文生视频可以调节视频风格、情感氛围、镜像运输方式等数据,而图生视频最高支持16秒4K。 60帧视频生成,是小雷体验过的大型视频模型,最长的视频生成。

然而,清影产生的视频让小雷失望了,所以我就不说别的了。我的猫呢???而且图片几乎看不出来。这是一个视频。小雷几乎认为我生产的是图片。

与同门的Vidu相比,清影的问题非常明显,对自然语言的理解可能存在一些问题,需要进一步提高。

6、PixVerse:画面美丽,动作却十分僵硬。

国内普通网友可能对爱诗科技并不熟悉,但其创始人王长虎曾担任微软亚洲研究院主管研究员,随后跳槽到字节跳动,先后担任人工智能技术总监、视觉技术负责人等职务,主导字节跳动视觉模型的基础设施建设。

爱诗科技的视频模型PixVerse功能同样丰富,支持特效、风格、比例等元素的设置和优化,还可以预设角色,最长可以生成8秒的视频。但是注册分数只有90分,每天再给30分。生成5秒视频需要30分,8秒视频需要60分。

从视频来看,PixVerse的特点和它的名字一样漂亮,画面色调非常讨喜小猫的头发细节和背后水面的波纹。

就像即梦一样,PixVerse生成视频的问题也出在猫身上,小猫的动作过于刻意,反而显得僵硬。瑕疵不掩瑜,PixVerse的表现十分出色,让我们看到了爱诗科技的实力。

视频模型对决,细节决定成败

几个月来,国内AI公司在视频模型领域迈出了从零开始的关键一步,现在正在从零开始走向强势。就小雷的感受而言,它是灵性的,也是梦想的。Vidu、PixVerse都表现出色,并排排名第一,腾讯混元视频模型排名第二,清影排名第三。

由于使用场景、风格要求等细节的不同,大型视频模型的输出结果可能会有一些差异,小雷的感受无法展现这些大型视频模型的全部实力。

即使是性能好的大模型,细节上也有一些漏洞。除了上面频繁提到的猫咪动作僵硬的问题,还有一个非常明显和常见的情况,那就是沙滩上的沙子不会因为猫咪的动作而流动。虽然AI视频大模型不断升级迭代,也取得了丰硕的成果,但是在细节上还有很大的进步空间。

AI视频模型的升级侧重于三个方面:自然语言分析能力、画面细节抛光、镜面运输和时间。这三个核心因素也决定了AI视频模型未来能取得的成就。只有了解人类的自然语言,每个人才能真正利用AI视频模型释放自己的想象力。画面和镜子的升级可以提高视频质量。在时间充足的前提下,AI视频模型可以成为用户手中创作微短视频的助手。

此外,虽然收费方案广泛应用于大型AI视频模型,但价格过于昂贵,以至于付费用户有限。此外,培训成本和推理成本高,大多数大型AI视频模型公司的情况并不乐观。专注于视频生成领域的AI企业,要么与B端客户合作,为定制场景打造专属版本,要么加快升级迭代,满足C端用户的需求,寻找盈利点。

近日,亚马逊云科技、谷歌、OpenAI等公司相继发布了AI视频模型。预计明年会有更多的AI公司推出视频模型,整个行业的竞争会越来越激烈。这些已经领先的公司应该尽快利用自己的优势创造利润点,防止在更卷的环境中被淘汰。

本文来自微信微信官方账号“雷科技”,作者:雷科技,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com