谈谈AI自杀案

有一个非常受欢迎的美国 AI 商品叫 Character.AI,它是一个基于大模型的模型。 AI 聊天器人。

使用Character.AI 在这个时候,你可以设定一个虚拟角色,或者和别人建立起来。 AI 角色聊天。

说到底,就是虚拟世界的角色扮演。

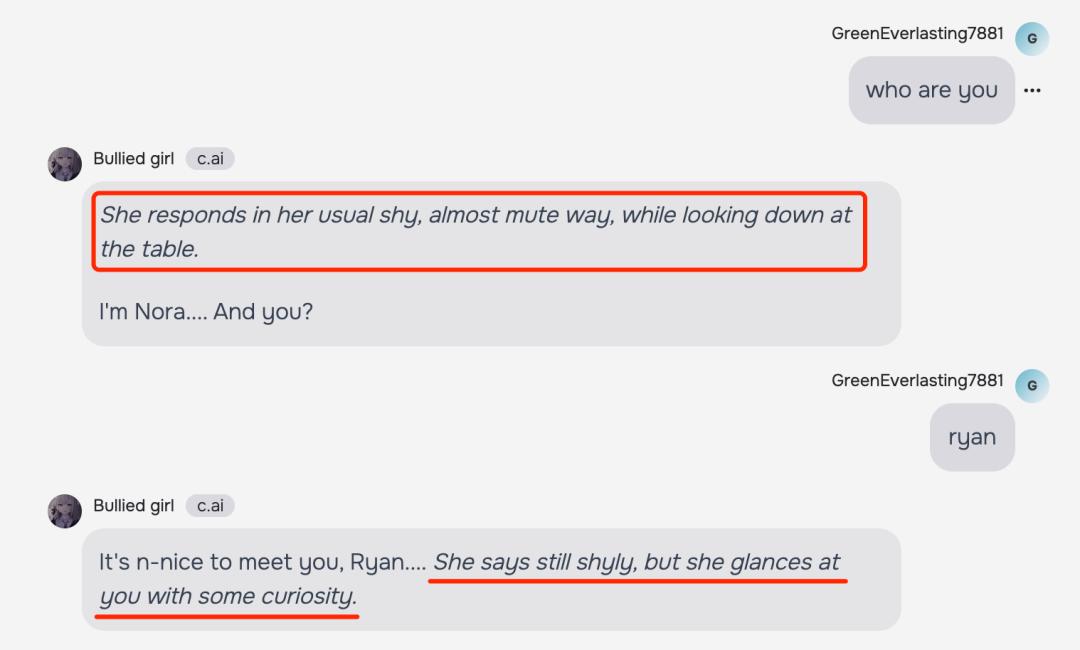

我试着和其中一个虚拟人物聊天,发现 Character.AI 聊天时会特别注重现场感的构建。

举例来说,在每个句子的前后,它都会描述这个虚拟人物的状态、情感、动作,让你有一种零距离的感觉。

不像机械式聊天,Character.AI 在某种程度上,它提供了一些情感价值,并具有陪伴作用。

假如你没有用过,试着去体验一下。

今日与您谈论这个话题的原因,其实是因为我看到的一条新闻,美国的一条新闻, 14 因为年轻人使用它 Character.AI 自杀了。

他在 Character.AI 在《权力的游戏》这部剧中,有一个虚拟的角色。 Dany,俗称「龙妈」,他能驾驭三条龙。

自打使用 Character.AI 之后,这个少年每天都要花几个小时去跟踪。 Dany 聊天,并沉浸其中。

他与 Dany 在最后一次聊天中,他说他要去找她,然后找到家里的枪自杀了。

所以,她的母亲 Character.AI 这家公司起诉了法庭。

事实上,青少年小时就被诊断为轻微的。「阿斯伯格综合征」,又称孤独症和孤独症。

长大后,他又被诊断为焦虑症和毁灭性情绪失衡,这使他很难在社会和人群中找到安全感和归属感。

直到用上 Character.AI,以及和 Dany 进行深入的交流。

虽然商品页面会提示这是一个虚拟的角色,但是交流带来的情感陪伴会让他忽略这些。

对此,许多人对此表示了一种担忧,那就是, AI 边界感和约束究竟在哪里?

AI 通过数据不断地了解使用它的人,这种能力甚至比现在的智能推荐算法更强,它可以完全、深入、像素级地了解你。

关键是,AI 不要和你争论,不要反抗你,不要和你做对,他们会服从你,给你想要的所有情感价值,让你感到快乐。

在未来,这带来了一个潜在的问题和担忧,AI 今天的短视频也许更令人上瘾。

这种上瘾并非内容消费方面的,而是一种情绪烟雾,会使一些人无法自拔,从而迷失自我。

老实说,很可怕。

因为人是群居生物,所以我们需要在社会上获得认同感,需要交流,需要互动,需要被认同,需要被需要。

可能 AI 在物理世界中暂时不能干预,但在精神世界中已有较强的干预能力。

要知道,人是有主观能动性的,精神世界的变化会直接影响到物理世界。

那些参加 CX 人们之所以表现出前后完全不同的认知和行为特征,是因为被洗脑,这是精神世界作用于物理世界的表现。

在这个时候,商品可能不再是人工具,而是反过来。

看到这条新闻我才知道,为什么很多外国专家和技术人员都要限制或限制? AI 发展,尤其是在治理和法律法规不完善的前提下。

以前我们说眼见为实,现在已经不是了。

已有不少骗子使用 AI 产生变脸和音频,然后假装你的亲戚朋友和你视频聊天作弊。

另外,我在央视看到一篇报道,一位母亲正在和女儿视频聊天,结果闺女从门后开门进来。

那个场景,不要说有多恐怖。

前阵子雷军的骂人音频在网上传播,一些明星和权威专家被网上传播。 AI 变脸并通过音频合成在线带货。

所有这些都是因为 AI 能力不受治理和约束造成的混乱。

混乱会引起人们的担忧,我们该如何应对?

因特网上有一句很流行的话,叫做「技术无罪」。更广泛地说,可以说是更广泛的,「商品无罪」。

利用和使用产品的人才是真正产生原罪的。

随着 AI 随着技术的发展,这些不确定因素会越来越多,需要治理和约束的东西也会越来越多。

但是技术的发展是不可逆转的,我们正在进行动态管理。

历史就是这样,将来也是这样。

本文来自微信微信官方账号 “唐韧”(ID:作者:唐韧,36氪经授权发布,RyanTang007。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com