拯救P图废料,阿里新的多模式模型Qwen-VLo!每个人都可以免费玩

一上手就让网友直呼「生图能力」比GPT-4o更强?!

昨天晚上,阿里带着全新的东西Qwen多模态模型-VLo开启炸场模式。

据介绍,Qwen-VLo全面升级了阿里原有的多模态理解和生成能力,有三个亮点:

具有强化的捕捉细节的能力,能够在整个生成过程中保持高度的语义一致性;

图像编辑可以通过一个指令来实现,包括风格变化、材料增删、添加文字等;

全球用户使用更加方便,支持中英等多语言。

不管是输入端还是输出端,Qwen-VLo都不受固定格式的限制,支持随意分辨率和宽高比。。

与此同时,除了GPT-4o已有的玩法(如持续生成、吉卜力风格、添加文字)之外,在官方发布的demo中,它还支持一些脑洞大开的idea。

不用说,前者现在也可以像“连续剧”一样生成各种精确符合指令的照片:

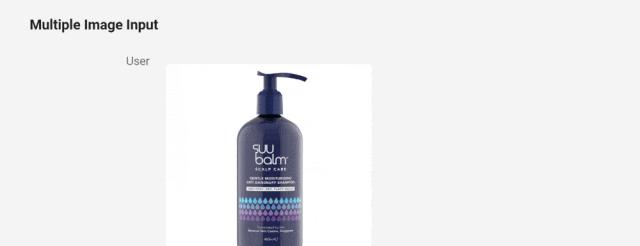

对后者来说,就像我们在超市购买日用品一样,让Qwen-VLo生成一张图片"所有的洗漱用品都在购物篮里"的照片。

结果啪的一声,还真的马上完成了装车。(⊙ˍ⊙):

并非没有一些小瑕疵,但是有一句话,理解能力的确比以前更强了。

这一理解能力不仅体现在图像生成上,还体现在对图像的识别解释上。

举例来说,在完成生图任务后,再让它介绍一下图片中的小猫小狗品种(正确识别为虎斑猫和比格):

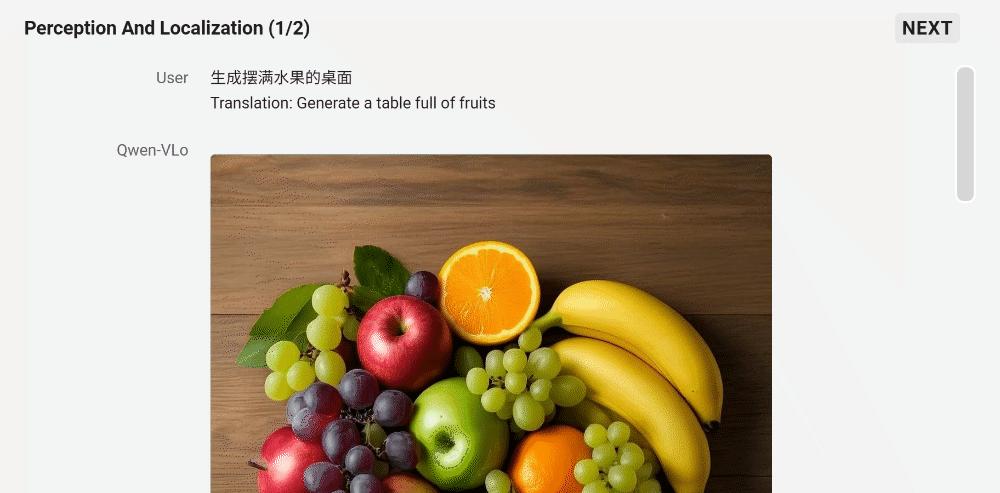

并且与以往的模型略有不同,Qwen-VLo也可以注释当前信息(例如检查、分割等)。

在下面的图片中,它成功地用红色Mask分割出香蕉的边缘。

……

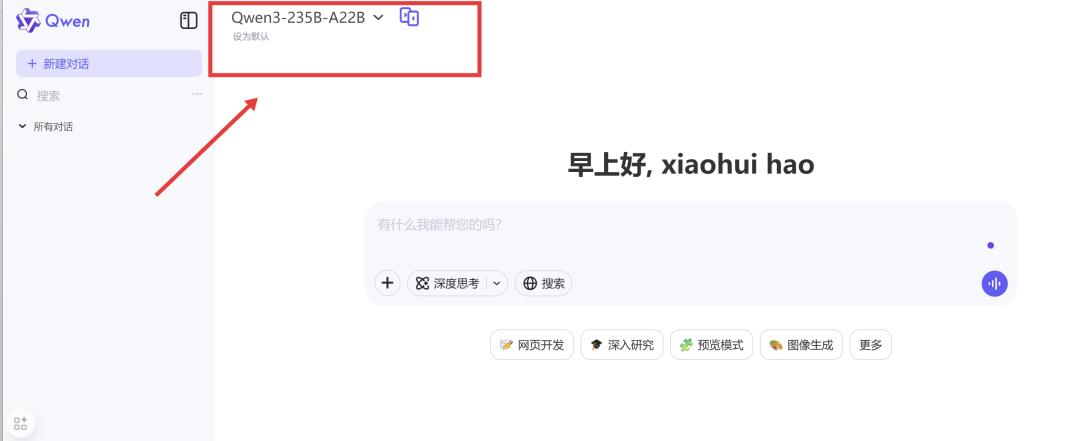

现在模型大家都可以免费玩(现在是预览版),具体请找Qwen3-235B-A22B,直接在首页输入框中提出需求。

话不多说,我们先一起上手实测一波行走。

Qwen-VLo,你们到底有多少可以编辑?

基于Qwen介绍的亮点,即“强细节捕捉”和“一句话编辑图像”,我们重点考察了Qwen-VLo的测试。各种编辑能力。

说到底这个真的很吸引人啊!

一方面,大部分模型生图都需要抽卡,但是之前的形成效果并不是完全令人不满,所以二次/几次编辑的能力非常重要。

另外一方面,强大的编辑能力,的确为P图废料节省了不少...

开胃菜先走!

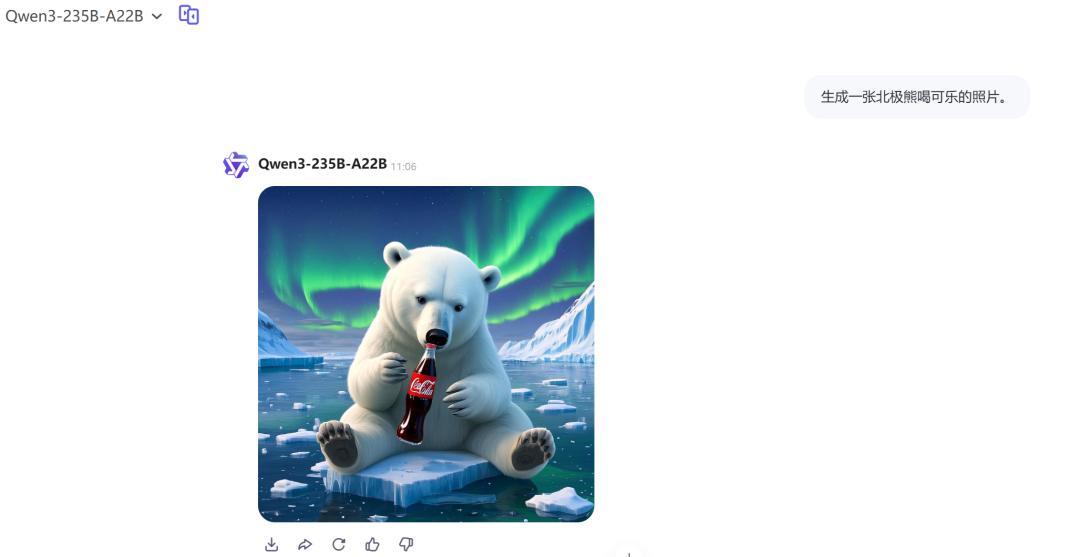

首先,让它先生成一张北极熊喝可乐的照片。

这个回合以非现实风格为主。

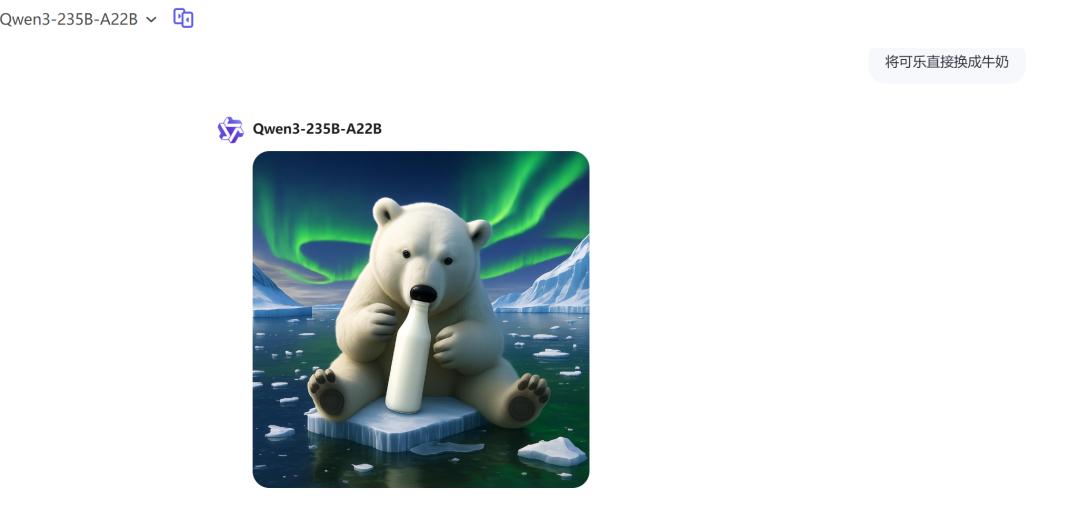

在此基础上,继续通过对话。把可乐换成牛奶。

一次成功,Qwen-VLo确实完成了更换。

而且背景,北极熊本熊几乎没有被乱改。

但是如果非要挑毛病的话,还是可以观察到前后两张图片中北极熊的眉目部分和头发的质地略有不同。

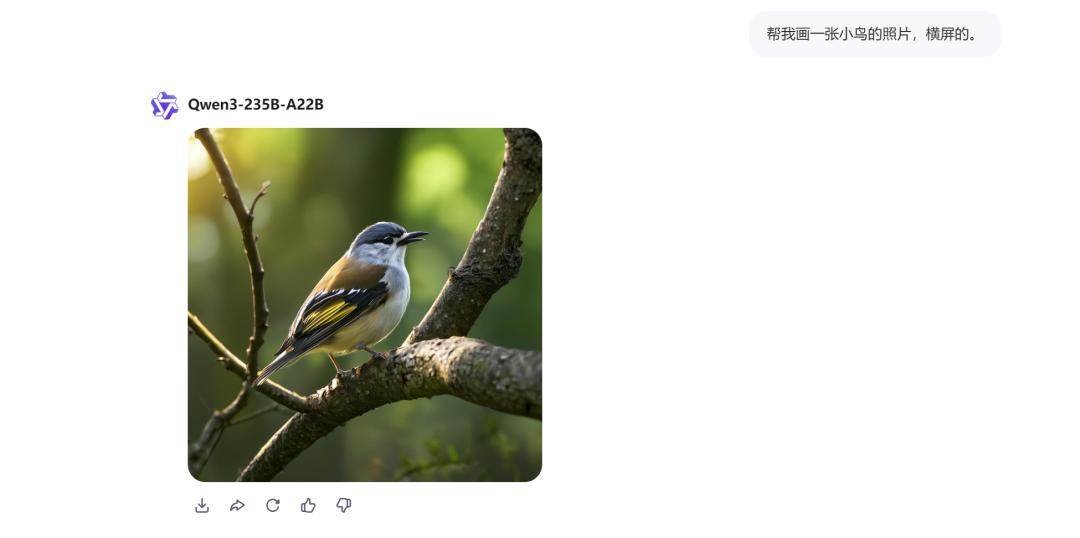

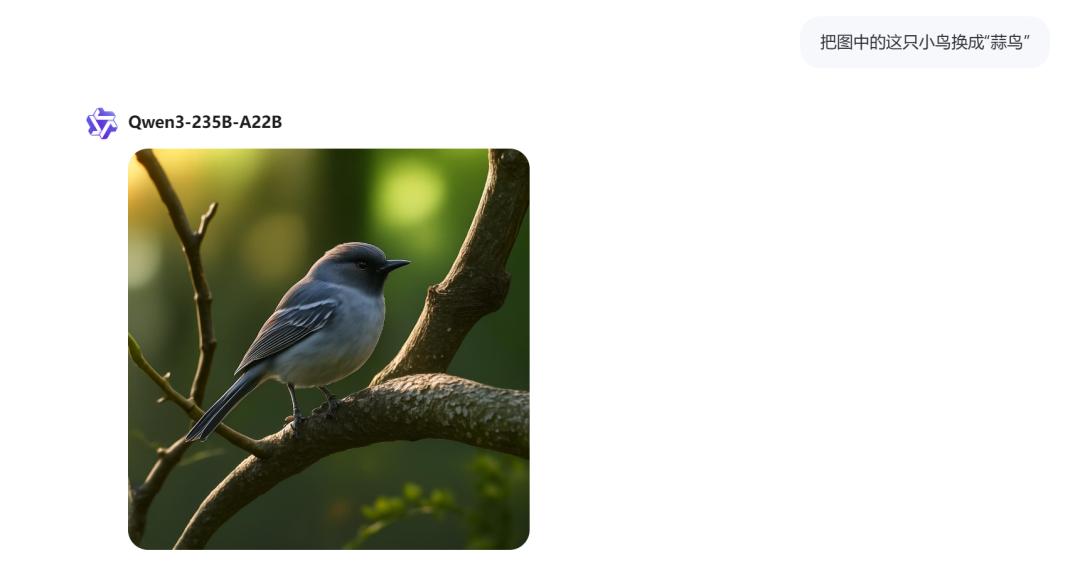

第2次测试,首先让它帮助生成一张小鸟的照片。

本轮以现实摄影风格为主。

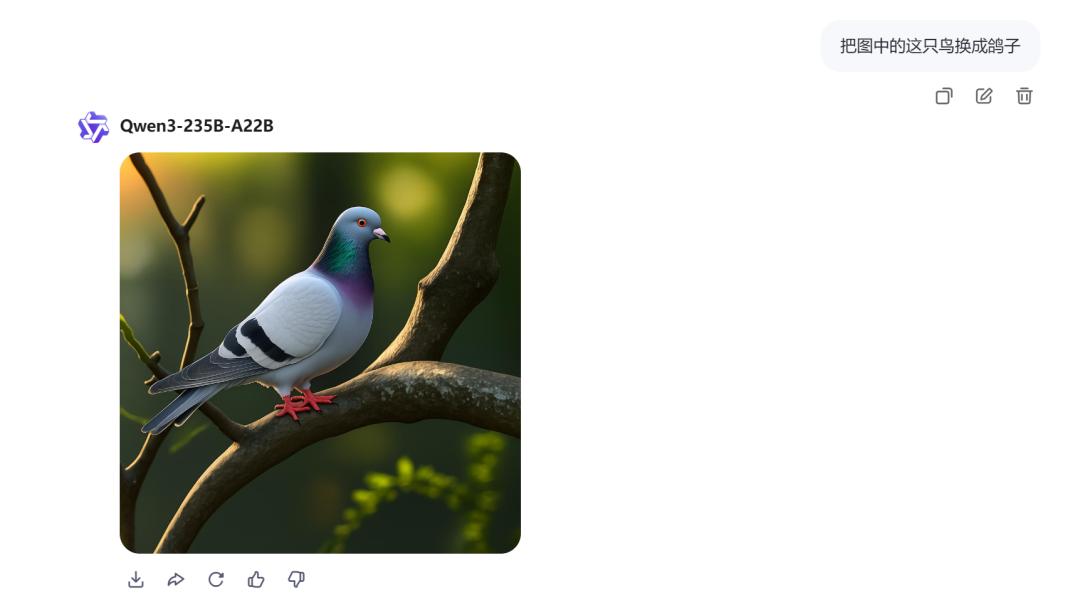

之后就不用读霍格沃茨了,只要说一句“把这只鸟换成鸽子”,你就可以施展魔法:

但是我们试着玩一个“蒜鸟”梗,Qwen-VLo也没有得到它。

(注:“蒜鸟”这个词最近爆了。短视频画外音中的武汉方言“算了,算了,不容易”,被网友称为“算鸟”,然后变成“蒜鸟”)

然而,尽管没有得到梗,Qwen-VLo仍然努力完成编辑任务。

看看下面的结果,在不影响其他元素的情况下,Qwen-VLo把图片中的鸽子换成了其它鸟类。

这也是一种换鸟?

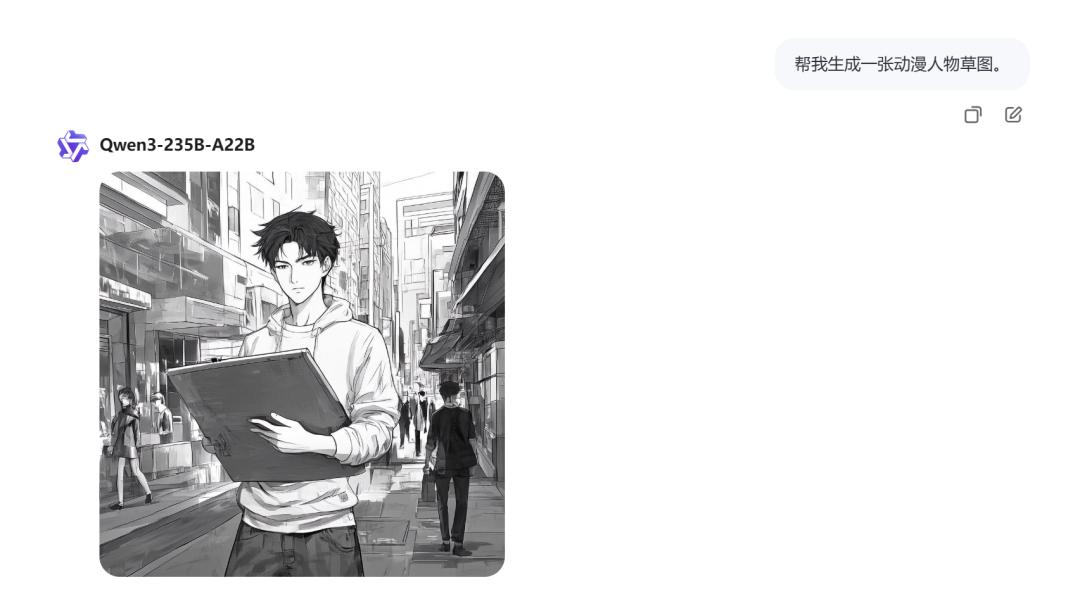

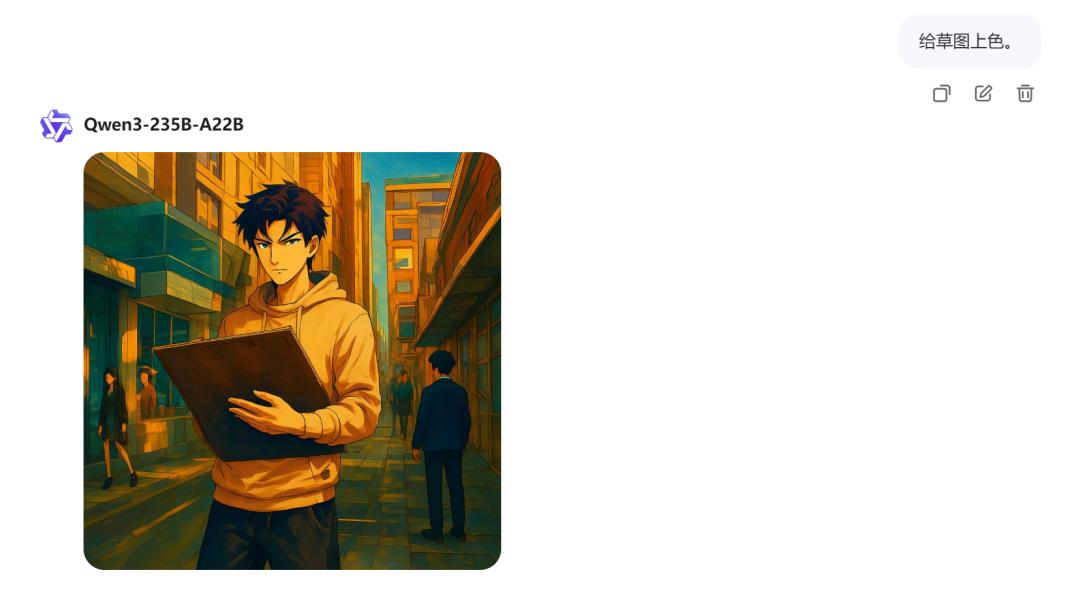

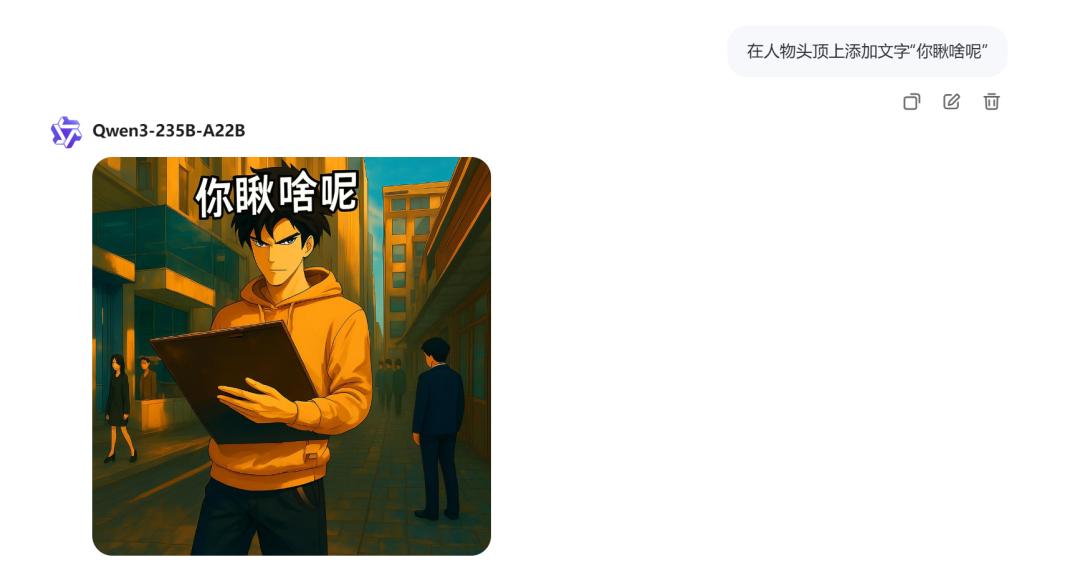

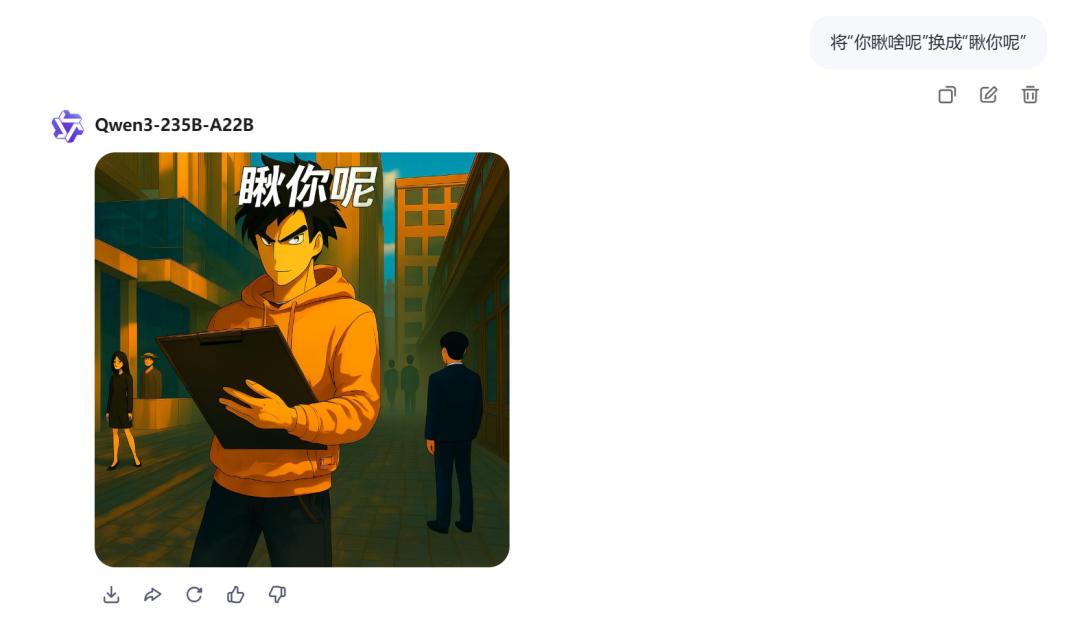

第三次测试,进行多步任务,全方位测试Qwen-VLo在描绘世界的同时,重点关注其在图像上的文本编辑能力。

流程是「让Qwen-VLo生成草图-着色-加字-编辑汉字。」。

来吧,怕动画滑得太快,我们连看过程中依次截取的四张图片,感受它每一步带来的变化:

虽然图中小帅同学的五官在变,但是人物主体稳定,背景不变,一整套下来,编辑文字的任务还算不错,

最后来个附加题,编辑英文——

文字编辑正确,多人物主体位置不变,背景依旧,整体正确。

但是如你所见,小帅同学也长得更漂亮了(手动笑死)。

同样是逐渐显示出来的,但是Qwen-VLo的背后真的很活泼。

下面我们再补充一点,大家在开始玩的时候应该都能注意到。

这就是Qwen-VLo生成图像的过程,是酱阿姨的过程。——

是不是有点熟悉?

没错,GPT-4o也是从上到下逐块生成图像:首先显示模糊的轮廓,然后逐渐添加细节。

然而,当时香港中文研究的逆向工程研究表明,用户看到的逐行渲染效果只是OpenAI的障碍,并不是真正从上到下生成像素。

这样做的目的,既满足了用户对“即时生成”的心理预期,又避免了真正逐行渲染的技术负担。

但是Qwen这样做并非上演OpenAI的戏码。。

敲敲黑板——

第一,Qwen官方表示,Qwen-VLo这种渐进的生成方式,不仅从上到下,而且从左到右逐渐清晰地构建了整个照片。

经过几次实测,我们暂时没有肉眼观察到“从左到右”的前期效果。

但是从上到下逐渐形成照片的前期效果是保证会有的:

第二,Qwen引入了这种形式,这真的很有用啊:

模型在生成过程中会不断调整和优化预测内容,从而保证最终结果更加和谐一致。

这一生成机制不仅提高了视觉效果,而且特别适用于需要对长段文字生成任务进行精细控制。

例如,当广告设计或漫画分镜产生大量文本时,Qwen-VLo将逐步生成,并逐步修改。

这一生成过程,其实有点思维链“一步一步慢慢思考”的意思!

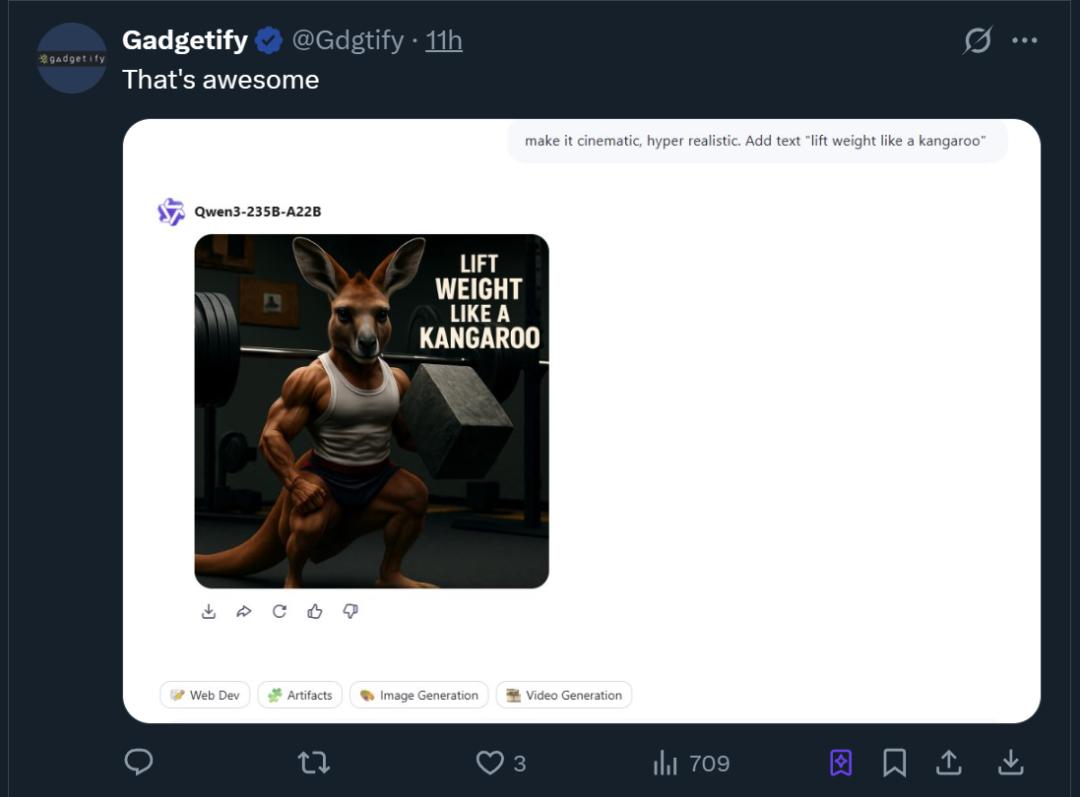

网民实测脑洞很大,来吧展示。

除上述量子位实测外,不少网友也迅速奉献了一波有趣的玩法…

一张动漫人物草图,顺手, Qwen-VLo可以帮助一键着色。

让小猫当宣传员,也可以直接生成“包含”Qwen Chat”字样的看板。

或是可以借鉴以下网友的做法,然后用来制作一些梗图。(doge)。

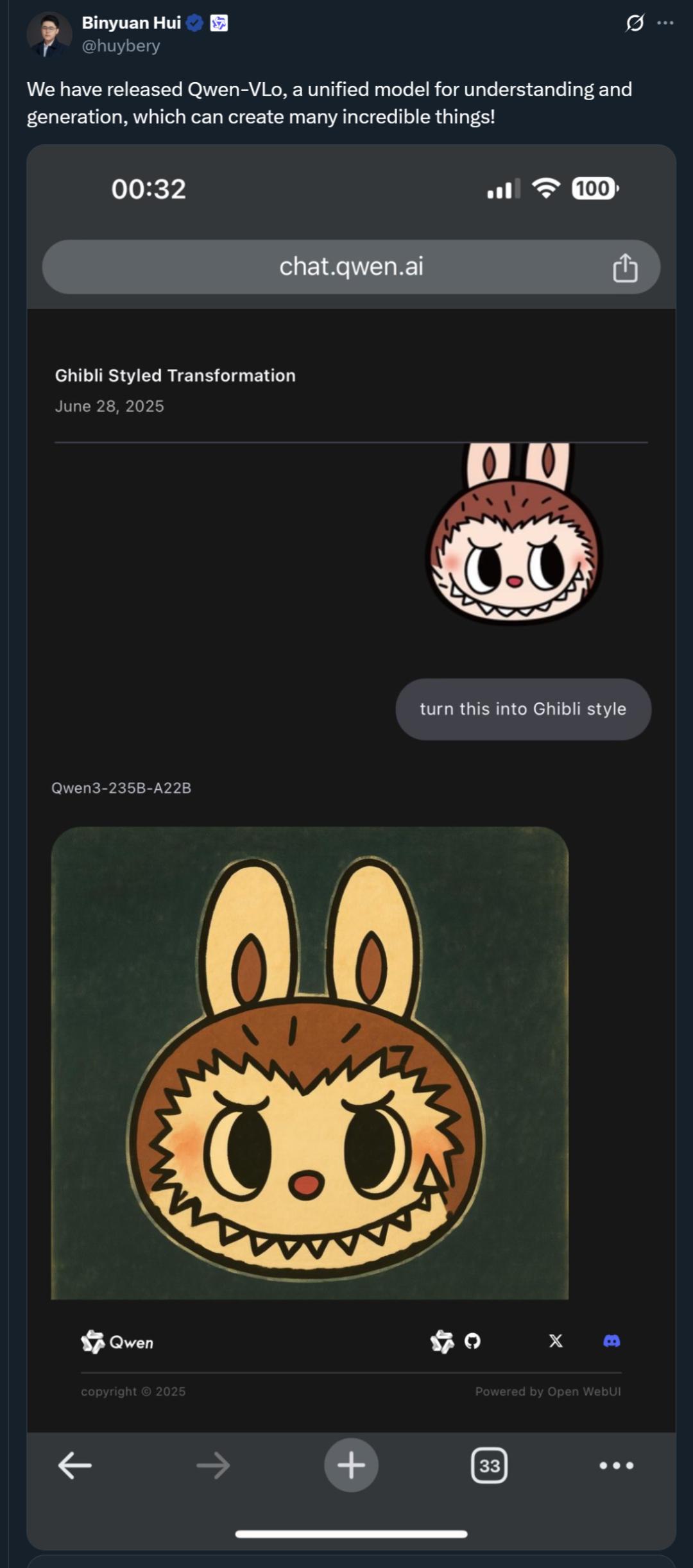

对了,就连Qwen团队成员之一Binyuanyuan也是如此。 Hui还出来给大家打样,分享了近期吉卜力风格的顶流。

好了,更多的例子就不一一展示了,只说一句:

现在模型免费开放,评论区可以有图片,记得回来分享一波。~

在线体验:https://chat.qwen.ai/博客:https://qwenlm.github.io/blog/Qwen-VLoo/

参考链接:[1]https://x.com/Alibaba_Qwen/status/1938604105909600466[2]https://x.com/szkane/status/1938614382369575048[3]https://x.com/huybery/status/1938639781988286957

本文来自微信微信官方账号“量子位”(ID:QbitAI),作者:关注前沿技术,授权发布36氪。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com