阿里推出了一个全新的推理模型:只有1/21参数与DeepSeek相当 R1

2025-03-07

快科技 3 月 6 日消息,阿里 Qwen 该团队正式发布了他们的最新研究成果。—— QwQ-32B 大语言模型。

它是一种拥有 320 十亿参数模型,其性能可与 6710 十亿参数(其中 370 亿被激活) DeepSeek-R1 媲美。

QwQ-32B 在只有 DeepSeek-R1 约 1/21 在参数的情况下,通过强化学习完成了性能的飞跃。

另外,阿里在推理模型中仍然是一体的。 Agent 相关能力,使其能在使用工具的同时进行批判性思考,并根据环境反馈调整推理过程。

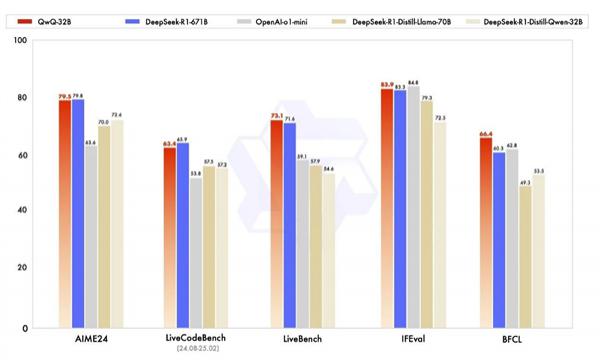

QwQ-32B 对数学推理、编程能力和通用能力进行了一系列基准测试。

其中,在数学能力的测试中 AIME24 在评估集中,以及评估代码能力。 LiveCodeBench 中,千问 QwQ-32B 表现与 DeepSeek-R1 相等,远胜于 o1-mini 以及同样大小的 R1 蒸馏模型。

同时,在由 Meta “最难的”首席科学家杨立昆领衔 LLMs 评测榜" LiveBench、根据能力,谷歌等指令。 IFEval 评估集,由加州大学伯克利分校等提出的评估准确调用函数或工具。 BFCL 测试时,千问 QwQ-32B 得分都超过了 DeepSeek- R1。

目前,QwQ-32B 已在 Hugging Face 和 ModelScope 每个人都可以通过开源 Qwen Chat 直截了当的感觉!

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com