计算突破:DeepSeek搅拌AI芯片格局

下面的文章来自 RimeData 来觅数据 ,作者来找研究所

简介:北京时间 2 月 27 日,英伟达正式发布 2024 年度第四季度财务报告,其总营收 393.31 亿美元,同比增长 78%。与此同时,英伟达估计下一季度的营收收入 430 亿美元,同比增长 超出市场预期的13% 420 亿美金。这份财务报告有力地回击了市场。 AI 传言说芯片市场可能会下滑。而且这个谣言的“罪魁祸首”,正是中国 AI 公司 DeepSeek。DeepSeek 如何硬压整个整体 AI 芯片市场?市场结构将如何变化?AI 目前芯片的投融状况如何?试着对这篇文章进行分析和讨论。

01 进击的 DeepSeek

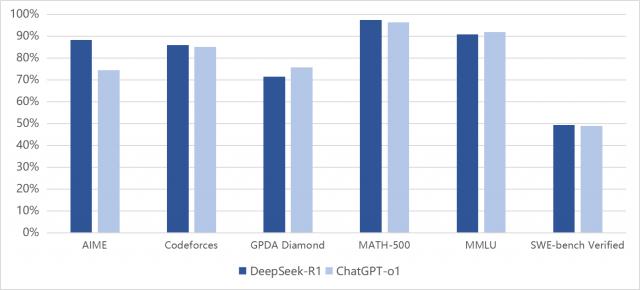

DeepSeek 成功远不止于此。据 Nextplatform 等待媒体报道,DeepSeek-R1 约会是用来练习的 2000 张英伟达 H800GPU;就推理而言,DeepSeek-R1 选择混合专家架构,推理时只激活大约 10% 参数大大减少了计算资源的消耗。简而言之,DeepSeek 通过模型创新和算法优化,几十分之一的成本接近 OpenAI 研发的 ChatGPT-o1 模型性能,影响全球科技巨头的战略布局。

图表 1:DeepSeek-R1 对比基准测试结果 ChatGPT-o1 模型(单位:%)

资料来源:公开资料,RimeData 来寻找数据整理

长期以来,AI 随着大型模型的发展 Scaling Laws。该规则指出,当模型参数的规模、训练信息的数量以及 AI 当芯片同步扩展时,模型的智能性能会出现指数级跃升,甚至出现“智能涌现”现象。简单地说,越是想要训练出优秀的大模型,就越需要。 AI 芯片。近年来,科技巨头争相购买。 AI 芯片,希望训练出超越同行的芯片。 AI 大模型。然而,DeepSeek 低成本方案却打破了这一叙述。

英伟达是第一个受影响的人。它在那里 2025 年 1 月 27 每日股价一度下跌超过 市值蒸发约为20% 6000 一亿美元。美国投资者 Jeffrey Emanuel 表示,DeepSeek 低成本路线被摧毁 Scaling Laws,行业长期存在算率浪费,硬件优势可能被效率提高所取代。

但是,真的是这样吗?

众所周知,大型模型可以分为两个阶段:练习和推理。前者的目的是通过向模型输入大量数据来提高参与度,从而获得一个可用的模型,而后者则利用训练模型来解决实际问题。DeepSeek 创新就是通过捷径降低训练成本,而面向广大下游的推理场景,缺口依然存在。

事实上,训练费用每年都在下降。著名的美国投资者 Cathy Wood 表示,AI 训练费用以年平均为准 75%-78% 速度急剧下降,这种趋势远远超出了传统产业的预期。降低成本的来源取决于硬件效率的提高(例如英伟达 Blackwell 架构)、比如算法优化 MoE 混合专家模型)和开源生态的繁荣。DeepSeek 使训练费用大幅下降,但并非唯一的因素。

Cathy Wood 同时也认为,低成本培训能力使初创企业和中型科技企业能以较低的成本参与 AI 竞争,直接促进 AI 落地于医疗、金融、自动驾驶等领域。而且下游推理市场的百花争艳,也需要无穷无尽的算率。从某种意义上说,DeepSeek 加快了 AI 从训练到推理,芯片市场的转移,以及推理所需要的 AI 芯片,无疑是一个更大的市场。

英伟达 CEO 黄仁勋说,AI 市场竞争焦点正从训练转向推理,推理阶段的计算能力需求将远远超出预期。他指出,在昨天的第四季度业绩简报会上,未来的推理市场将是目前培训市场的百万倍。与此同时,他提出了“第三扩展定律”,即在生成高质量的答案之前,模型需要进行几次迭代推理,这个过程的本质是计算密集型。而 AI 应用程序的爆发(如自动驾驶、医疗诊断)将促进推理计算能力需求的持续上升,DeepSeek 普及反而会因为降低行业门槛而扩大整体市场规模。

在探讨 DeepSeek 在讨论算率市场大幅下跌之前,我们可能会忽略一个前提,DeepSeek-R1 并非终局。DeepSeek-R1 仅仅是一种对话模式,没有多模态功能,而且离最终目标还很远。 AGI 而且相差甚远。针对推理的 AI 虽然芯片将迎来巨大的发展, ChatGPT-5、DeepSeek-R2、Grok-4 等待国内外优秀的大模型还在迭代,针对训练。 AI 芯片也将保持高速增长。

02 云厂商在做什么?

以美股著称的投资者 Aswath Damodaran 表示,中国 AI 公司 DeepSeek 它的出现发生了变化 AI 产业格局,可能会使用 AI 市场出现分化,部分是商业化、竞争激烈的低等级。 AI 商品,另一部分是高端品牌。同时,他把 AI 预期芯片市场的规模 5000 亿美金砍至 3000 亿美金,DeepSeek 结算率泡沫将导致效率革命,AI 芯片市场的增长可能没有以前市场预期的那么乐观。

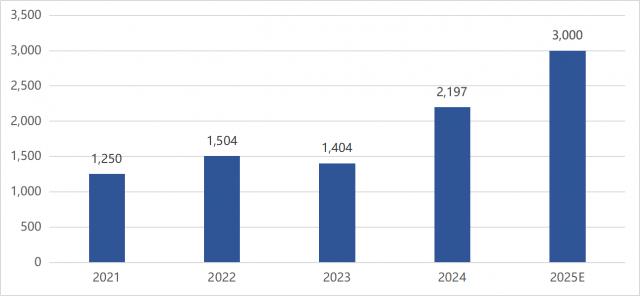

但是,这种观点很快就被科技巨头的财务报告所反驳。就常识而言,DeepSeek 至少在短期内减少 AI 但谷歌,微软,亚马逊,芯片需求,Meta 四大云厂商的资本支出显示,2025 年度资本支出将达到 3000 亿美金,较 2024 每年也增加了约定 800 一亿美元,远远超出市场预测。

图表 2:北美四大云厂商资本支出(单位:亿美元)

资料来源:公开资料,RimeData 来寻找数据整理

作为 AI 芯片业的主要消费者,云厂商的资金支出无疑为市场提供了前瞻性指标。其中,Meta 表示 2025 年度资本支出将在那里 600 至 650 亿美元之间,比较 2024 年度大幅上升超过 50% 以上。这种增长主要集中在 AI 投资基础设施和数据中心。谷歌甚至表示,尽管有, DeepSeek 低成本开源模型出现,但在全球范围内更便宜。 AI 崛起,只会提高这项技术的使用率,而谷歌将会从其数十亿用户的规模中受益。

归根结底,技术门槛的降低也会促进市场整体规模的扩大。根据杰文斯的谬论,在技术进步提高了资源的使用效率之后,总消耗可能会因为成本的降低和应用范围的扩大而增加。举个不正确的例子,提高内燃机的热效应该减少燃料需求,但实际上,更有效的内燃机促进了更多的车辆上路,反而增加了对石油和煤炭的总需求。

巧合的是,中国市场也呈现出类似的趋势。阿里巴巴于 2025 年 2 月 20 日公布 2024 第四季度财务报告,第四季度资本支出达到 317.75 亿元,同比增长 环比增长259% 创历史新高的80%。与此同时,阿里巴巴宣布将在未来三年投资 3800 云和使用亿元 AI 基础设施建设,这一规模超过了过去十年的总和。

另外,一些媒体和分析机构报道称,字节跳动 2025 年度资本支出预算可能在哪里? 1500-1600 在亿人民币之间,超过一半的预算将用于 AI 计算购买,这个规模会比较。 2024 年增加超出 100%。腾讯、百度等大型互联网公司也有可能大幅增加资本支出,以应对日益激烈的情况 AI 竞赛。

更具性价比的是 DeepSeek 后来,以云制造商为代表 AI 不但没有减少芯片的需求,反而进一步上升,这也代表了芯片的需求 2025 年或将成为 AI 应用下游大爆发的一年。

03 AI 芯片投融状况

由于众所周知的原因,目前我们国家 AI 与国外主要产品相比,芯片仍有差距。DeepSeek 通过算法优化,提高了硬件效率,降低了高端 GPU 依赖,促进国内芯片制造商转向开发低成本、高效率的推理芯片。这种情况显著改善了国内 AI 芯片投融热度。以国产 GPU 象帝先是公司的例子,它是去年的 9 当月宣布,由于融资计划受阻,公司进入重组期。在 DeepSeek-R1 大火爆发后,象帝首先重启了融资计划,并启动了招聘计划。

德勤预测,2025 年全球 AI 芯片市场的规模将会超过 1500 亿美金,2027 年有望增至 4000 亿美金。AI 服务器占云服务商服务器超大规模支出 数据中心需求激增60%推动芯片迭代。除了大型云主机,中国市场还需要部分政府、企业和客户进行本地部署。比如一体机类型的产品表现出色,也可能推动国内。 AI 芯片发展迅速。

下面的表格是我们整理的 2025 年至今 AI 与芯片相关的投融事件,可以看到跑道明显升温,知名机构争相投资产业资本。从交易轮数来看,融资主要集中在后期事件上,投资小投资少,这主要是因为在残酷的竞争背景下,资本更注重广阔轨道的确定性。有兴趣的读者,可登录 Rime PEVC 平台获得 AI 全面的芯片跑道融资案例,投资项目和深度数据分析。

图表 3:2025 年至今中国 AI 芯片投融领域的情况

信息来源:RimeData 来觅数据

近期推荐热文

医疗器械

互联网经济

本文的内容是基于寻找可靠的公开数据或实地调查数据。我们力求本文内容的客观性和公正性,但不保证或隐含本文中提到的信息、观点和数据的真实性、可靠性、时效性和完整性,也不承担相关法律责任。受研究方法和数据获取资源的限制,本报告的所有内容仅供参考,对任何人的投资、商业决策、法律等操作都不构成任何建议。任何时候,对于因参考本报告而产生的任何影响和后果,寻找数据都不承担任何责任。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com