ASIC,结束了AI芯片霸权

The following article is from RimeData 来觅数据 Author 来觅研究院

导读:12 月 13 日本,博通公布了新一季度的财务报告,截至目前,股价大幅上涨。 30%。同时,英伟达开始长期下跌,高点下跌近一点。 市值蒸发约为10% 3000 亿美金。两者截然不同的关键是博通新推出的关键。 ASIC 芯片服务。在算率领域,博通如何撼动英伟达的霸权?ASIC 有什么过人之处?国内投融现状如何?试着对这篇文章进行分析和讨论。

01 博通被寄予厚望

博通是一家专注于半导体和基础设施软件解决方案的多元化公司,在无线连接、网络处理和定制中 AI 在芯片领域具有领先优势。12 月 13 日,公司 CEO Hock Tan 公司在业绩说明会上表示, 2027 年度超大型客户 AI 收益将达到 600-900 亿美元,几乎每年翻一番。上述言论一举点燃了市场热情,博通当天股价上涨超过 24%,成为人类历史上第九个市值突破 1 公司万亿美元。

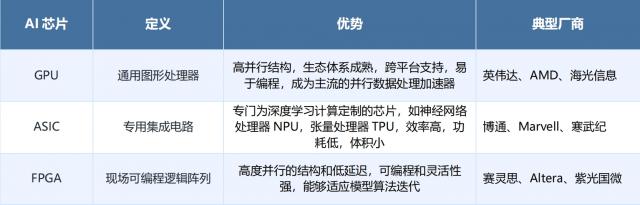

博通讲的 AI 收益究竟是什么?除交换机业务外,其优势最大的部分在于 ASIC 芯片服务。ASIC 它是一种为特定任务设计的芯片,通常用于特定设计和制造设备,并执行必要的功能。在那里 AI 芯片中,ASIC 用来处理特定的任务,并且比较 GPU 总之,响应速度更快,能耗更低。

图表 1:AI 芯片分类

资料来源:公开资料,寻找资料整理

按功能进行分类,AI 芯片可以分为两种类型:训练卡和推理卡。训练卡又称大卡,一般具有较高的计算能力和内存带宽,以支持训练过程中大量的计算数据处理;推理卡又称小卡,参数低,只需满足推理需求即可。一般情况下,训练卡可以用作推理卡,但是推理卡不能用作训练卡。简而言之,大型练习需要大量的训练卡来形成显卡集群,但是在应用中,需要推理卡来运行。 AI 计算模型。

在 2023 年以来的 AI 在大型基础设施中,“百模对决”提高了计算能力的需求。在大型预训练中,训练卡是焦点, GPU 由于适应性高,性能强,成为训练卡的必需品。同时,英伟达几乎垄断了所有的计算市场,它在 AI 超过了芯片市场份额 90%。

为什么英伟达如此强大?这是因为英伟达销售的不仅仅是计算率芯片,还有一套完整的生态系统。在英伟达生态系统中,有三张王牌,其中包括领先的。 GPU、十年磨一剑 CUDA 以及数据传输 NvLink。英伟达自 2010 年至今使力 AI 计算率,特别是近几年推出的计算率 H100、H200、GB200 等等,单卡算率稳坐第一梯队。CUDA 它是一套芯片编程模型,为开发者提供了应用。 GPU 全方位支持高效率和计算。NvLink 选择点对点结构,通过串列传输实现高速数据运输,传输速度一般为 PCIE 的 7 倍。

然而,当前形势正在发生变化,博通也许是最接近英伟达的挑战者。一方面,博通在网络芯片、交换机和路由器方面积累了大量资金,其推出的千兆以太网计划的传输速度不弱于 Nvlink。另外,博通在半导体领域已经渗透了很多年,可以帮助顾客完成从设计到封装的所有环节。就生态而言,由于执行了特定的任务,一般不需要复杂的生态环境。简单地说,博通打出的组合拳大约等于个人在交换芯片方面的积累和定制芯片加上客户自己的软件硬撼英伟达。

前景很好,但现实很骨感。现在,英伟达第三季度在第三季度 AI 方面收益 308 一亿美元,而博通最近一个季度 AI 收益仅为 37 十亿美元,规模差距还是相当大的。而且市场对博通的追捧也许只是抵制英伟达霸权的开始。

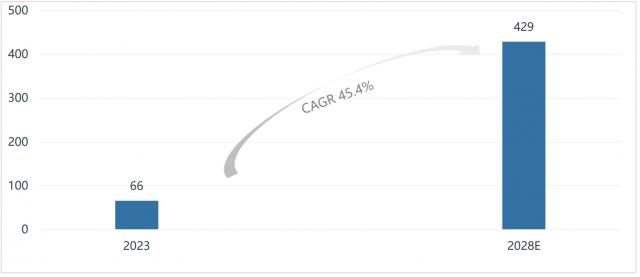

据 Marvell 预测,2023 年 ASIC 加速计算芯片的数据中心 大约16%的规模 66 亿美元;随之而来 AI 随着计算需求的增加,ASIC 这一比例有望提高到 25%,预估 2028 年数据中心 ASIC 市场规模将提高到 429 亿美金,CAGR 为 45.4%。就整体规模而言,AI ASIC 增长速度比较快,但是赶上了。 GPU 尚需时间。

图表 2:2023-2028E 全球 ASIC 市场规模(亿美元)

信息来源:Marvell,来寻找数据整理

02 英伟达焦头烂额

最近英伟达不太平静。正式宣布 GB200 AI 英伟达似乎陷入了一个多事之秋,因为服务器出货延迟,被美国、中国、欧洲等世界各地政府联合调查反垄断。然而,这并不能证明英伟达的弱点。英伟达的麻烦似乎只是他强大的副产物。

英伟达令人印象深刻的市场份额证实了他。 AI 芯片领域几乎无敌。目前各大云厂商在选择英伟达的产品时,要么选择捆绑销售,要么先买,要么只能原地等好几个月。就像 AWS CEO 表示:“现在 GPU 市场上只有一个选择,那就是英伟达,如果市场上有更多的选择,我们相信顾客会欢迎的。”

云厂商并非没有准备,他们正在开始开发。 ASIC 为了减轻对英伟达的依赖。例如,微软已经推出了第一个内部数据服务的数据处理器。 Azure Boost DPU,即将推出的亚马逊宣布 Trainium2 芯片。最为激进的应该属于谷歌,它推出的 Trillium TPU,已经用于大型模型 Gemini 2.0 在训练中,正是博通帮助谷歌完成了这个宏伟的设计。

从博通与谷歌的合作开始 2016 2008年,到目前为止,已经迭代到第七代商品。博通在最新的财务报告电话会议上说谷歌,Meta、所有的亚马逊都是公司 AI 另外,定制芯片的大客户,还有两个大客户要求博通对其产品进行深入开发。博通 CEO Hock Tan 表示,未来,50% 所有的计算率都将是 ASIC,对超大型云计算制造商而言,他们将 100% 使用 ASIC。

然而,花旗的许多分析师对此表达了不同的看法,他们认为, 2028 年,GPU 至少会占据 AI 总市场规模的加速器 以博通为代表的75% ASIC 至少会占据阵营 25%。不管怎样,GPU 部分市场空缺将会受到影响 ASIC 吃了,而这背后代表的,正是 AI 计算生态的变化。

前 OpenAI 创始人 IIya Sutskever 在不久前的 NeurIPS 2024 “因为数据有限,所以模型预训练时代即将结束,”会上陈述了一个观点,AI 重点将从训练转变为推理。“在过去的一年里,它属于大型追赶者:行业领导者 OpenAI 的 GPT-5 频繁跳票,追赶者之间的距离越来越小。与此同时,AI 应用程序开始发生变化,AI Agent、端侧 AI 开始频繁出现 C 终端用户视野。

预训时代,AI 芯片主要是训练卡。 GPU 芯片因其灵活性和适应性,占据了大部分市场规模。然而,事情正在悄然发生变化,推理领域的倾斜将导致 AI 芯片格局发生了变化。而且因为 ASIC 芯片更“专一”,响应速度更快,能耗更低,一般认为更适合推理端。

然而,英伟达在练习卡上的堡垒仍然坚不可摧。目前云厂商对博通的追求并不完全是出于性能要求,而是出于对英伟达的替代考虑。只要大模型继续迭代,计算能力需求还在增长,英伟达的优势依然存在。市场对 ASIC 追求可能会使英伟达头痛,但不会严重伤害生命力。

03 中国 AI 芯片投融动态

由于全球计算能力的不平衡,我国与海外相比存在一定差异。国内 AI 大多数芯片公司 ASIC 主要原因,如著名的升腾、寒武纪等。,都属于这一类。在过去两年的全球大模型竞赛中,中国公司并没有落后太多,但在未来百花齐放的应用时代,ASIC 不再是软肋,也将随之而来。 AI 芯片开发大放异彩。

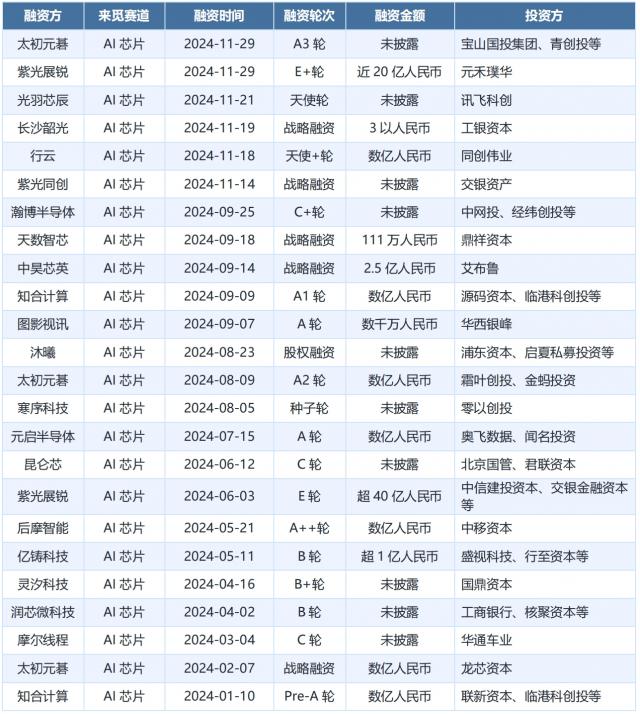

AI 近几年芯片市场呈现出强劲的增长势头。2024 年全球 AI 预计芯片市场规模将达到 712.52 亿美元,同比增长 33%,并且有望存在 2025 一年进一步增长到 919.55 亿美金。2023年中国市场 年 AI 实现芯片市场规模 1206 亿元,同比增长 41.9%,预估 2024 年将增长至 1412 亿元。根据来觅数据显示,AI 芯片也是今年最活跃的赛道之一,融资轮次仍然偏向于初期,但是一些明星项目已经得到了市场的认可,资本也在不断增加。有兴趣的读者,可登录 Rime PEVC 平台获得 AI 全面的芯片跑道融资案例,投资项目和深度数据分析。

图表 3:2024 年至今 AI 芯片投融领域的情况

资料来源:寻找资料

本文的内容是基于寻找可靠的公开数据或实地调查数据。我们力求本文内容的客观性和公正性,但不保证或隐含本文中提到的信息、观点和数据的真实性、可靠性、时效性和完整性,也不承担相关法律责任。受研究方法和数据获取资源的限制,本报告的所有内容仅供参考,对任何人的投资、商业决策、法律等操作都不构成任何建议。任何时候,对于因参考本报告而产生的任何影响和后果,寻找数据都不承担任何责任。

2024 投融市场报告第三季度报告

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com