OpenAII谷歌狙击

十二月十二日,当OpenAI宣布ChatGPT完全访问苹果时,谷歌发布了新一代大型Geminini。 值得注意的是,2.0,Gemini AI智能体系专为2.0。(AI Agent)而生。

Sundar谷歌首席执行官 Pichai在公开信中表示,“在过去的一年里,我们一直在投资开发更具代理性的模型,即这些模型可以更深入地了解你周围的世界,提前多步思考,并在你的监督下给你任务。今天,我们很高兴迎来新一代模型——Gemini 2.0,它是迄今为止我们最强大的模型。通过使用原生图像、音频输出、原生工具等多种模式的新进展,我们可以构建一个新的AI智能体,让我们更接近普通AI助手的愿景。"

Mind谷歌Deep CEO Demis Hassabis还说,2025年将是AI智能体时代,Gemini 2.0将是支持我们基于智能体工作的最新一代模型。

现在Gemini 2.0版本还没有正式上线,谷歌表示已经为一些开发者提供了内部测试。第一次上线的是比Gemini。 1.5 更强大的GemininiPro 2.0 Flash试验版,测试版已经在网页上打开,Gemini用户可以通过PC浏览Gemini。 2.0 Flash,移动电话即将推出。

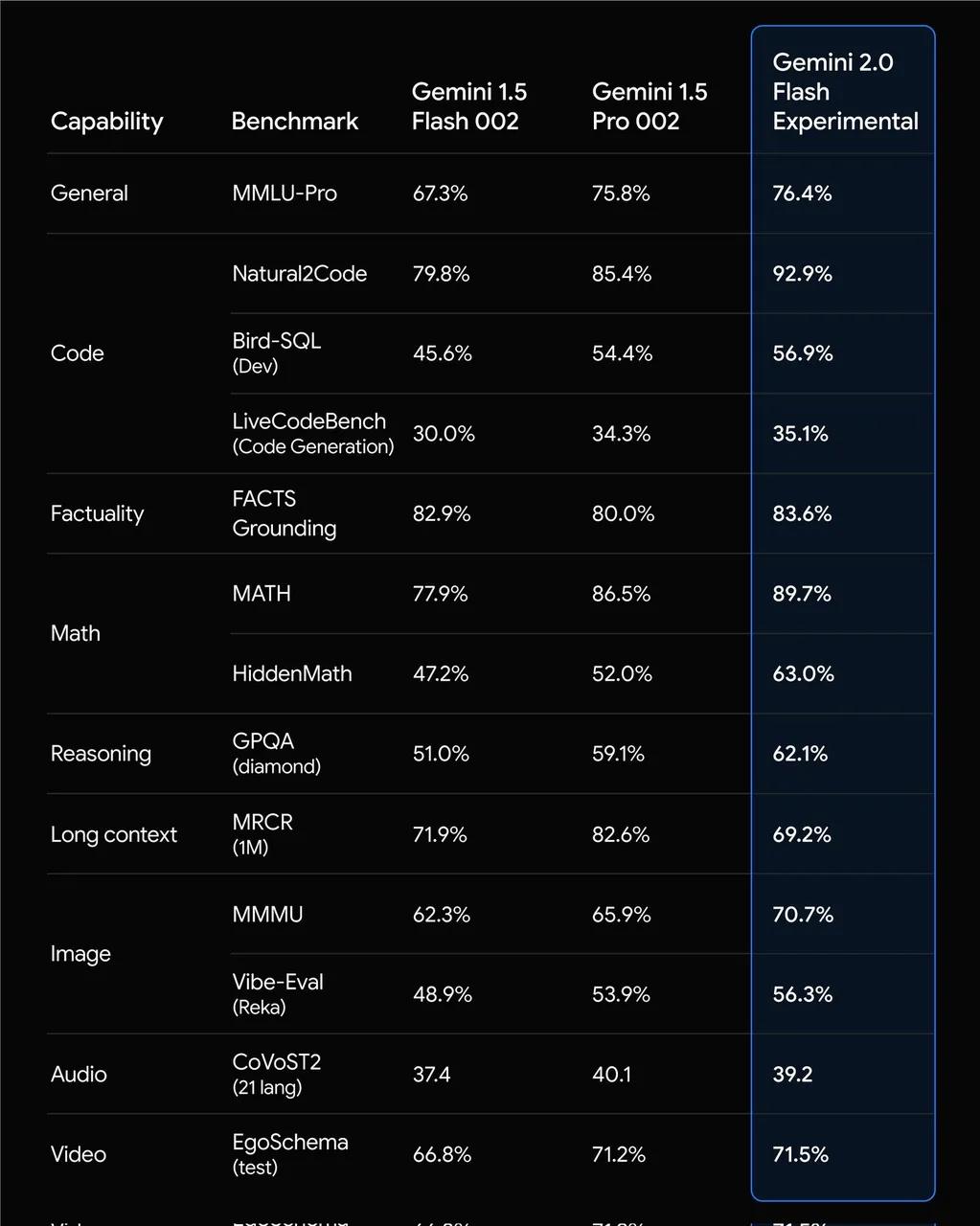

根据谷歌发布的基准测试结果,无论是多模式的照片、视频能力、编码、数学能力,都只是Flash试验版的Geminini。 2.0的表现几乎全面超越Geminini。 1.5 Pro,而且响应速度提高了2倍。

谷歌集中火力猛击AI智能体

通过谷歌的这次更新,我们可以窥见其AI规划的冰河一角。——一切都是为了智能体。

多模态能力更强:

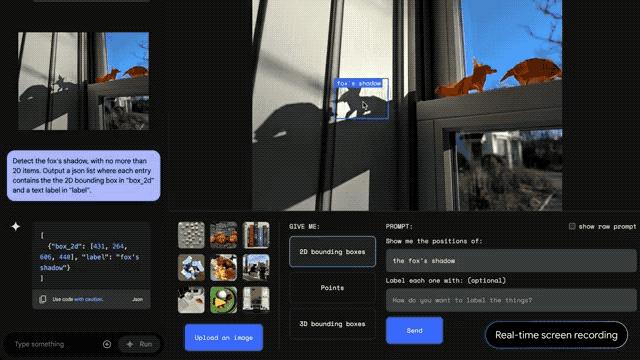

Gemini 2.0 除了支持图像、视频和音频等多模式输入外,Flash试验版还支持多模式导出,如原始图像与文本的结合,以及可以控制多语言文本的语音转换。(TTS)音频。

更加专业的AI搜索:

Gemini谷歌 在Advanced中,推出了一项名为深度研究的项目(Deep Research)智能身体的新功能。该功能结合了谷歌的搜索特长和Gemini的高级推理能力,可以围绕复杂主题生成相当于个人研究助手的调查报告。

多种智能体更新,上线:

基于Geminini更新 Projectt智能体2.0构建 Astra :Astra的新功能包括支持多语言混和对话;Googleeglegle可以直接调用到Gemini应用程序 Lens和地图功能;提高记忆力,在对话中拥有最多10分钟的记忆,使对话更加连贯;借助新的流式处理技术和原始音频理解能力,这个智能体可以通过延迟人类对话来理解语言。值得注意的是,Astra是谷歌眼镜项目的前瞻性项目。谷歌正在提到Project。 更多的移动终端,如Astra移植到眼镜。

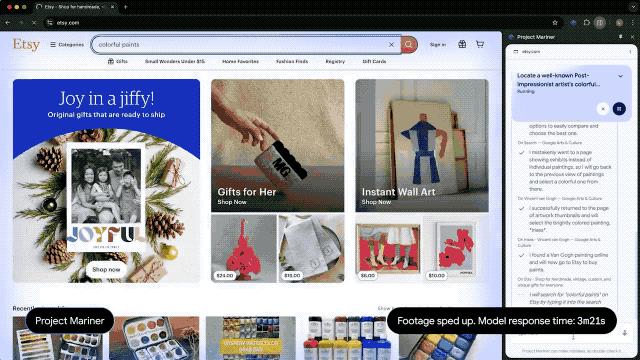

Project发布适合浏览器的智能体 Mariner(船员项目):智能体可以理解和推理浏览器屏幕上的信息,包括像素和网页元素(如文本、代码和照片),然后利用这些信息帮助你通过Chrome扩展程序完成任务。

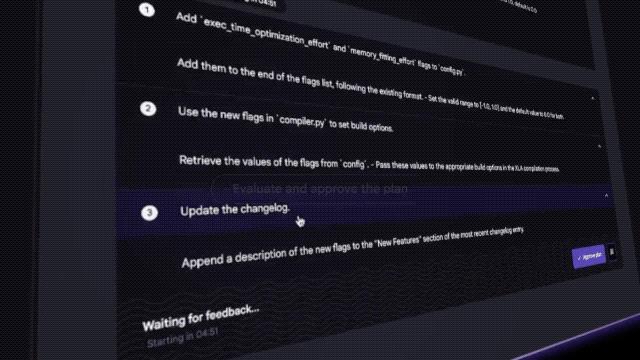

AI编程智能体Jules发布专门为开发者设计的。:Jules支持在GitHub工作流中直接集成,用户可以通过使用自然语言来描述问题,直接生成可以合并到GitHub项目中的代码;

发布游戏智能体:可以实时解读屏幕图片,通过用户在屏幕上的动作给出下一步的操作建议,也可以在玩游戏的时候直接和你语音交流。

谷歌表示,Geminini将在明年年初进行。 2.0扩展到更多的产品。之前推出的AI 集成集成Overviews Gemini 2.0,然后提高复杂问题的处理能力,包括高级数学公式、多模式查询和编程。本周已经进行了有限的测试,预计明年将推广,并将其扩展到更多的中国和表达。

本文来自微信微信官方账号“财联社AI” daily作者:宋子乔,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com