美国FDA:警惕AI模型带来的未知问题,迫切需要控制创新。

他说:“我常常思考和讨论强大的思考和讨论。 AI 的风险..”

日前,Anthropic CEO Dario Amodei 呼吁人们在其个人博客中重视人工智能(AI)“原则上,安全问题 AI 能帮助好人,也能帮助坏人”,太小看了。 AI 风险将成为“阻碍我们走向积极未来的唯一障碍”。

实际上,在 AI 随着大型技术的快速发展和对各行各业的深度赋能,一系列复杂且不可忽视的安全隐患也随之而来。三位图灵奖得主 Geoffrey Hinton、Yoshua Bengio 还有姚期智和几十个人 AI 这个领域的顶尖学者曾经在“AI 在公开信中,安全国际对话威尼斯共识警告说,“灾难性结果”随时都有可能发生。”

而且医疗保健作为一个与所有人密切相关的领域,确保其中 AI 应用安全,防止“毁灭性结果”、即使是“一些小错误”也显得更为关键。

美国药品监督管理局作为世界领先的医疗监管机构,(FDA)对 AI 全球医疗行业对新技术和产品的态度有着深远的影响。

日前,FDA 的 Haider J. Warraich、Troy Tazbaz 和 Robert M. Califf 在 JAMA(四大国际医学期刊之一)系统回顾 FDA 对 AI 监管历史,指出 AI 在医疗产品研发、临床研究和临床护理方面,提出了几种潜在用途,适应监管系统 AI 一个值得在挑战时考虑的独特概念。

尤其是,他们在文章中写道,生成式 AI 大语言模型等应用(LLMs),这是一个独特的考验,因为它可能会产生不可预测的突发后果,迫切需要在这个领域进行监督和创新。,开发者、临床医师、卫生系统领导者与监管者的合作也十分重要。

FDA 怎样管控 AI 医疗产品?

多年来,FDA 在面对 AI 在技术发展方面,它一直发挥着至关重要的作用。第一个许可部分是 AI 驱动的医疗设备监管部门,FDA 历史可以追溯到 1995 年,当时批准了 PAPNET 该软件希望通过神经网络防止宫颈癌错诊。虽然这项技术最初被认为比人类病理学家更准确,但由于成本效率不高,没有得到广泛应用。

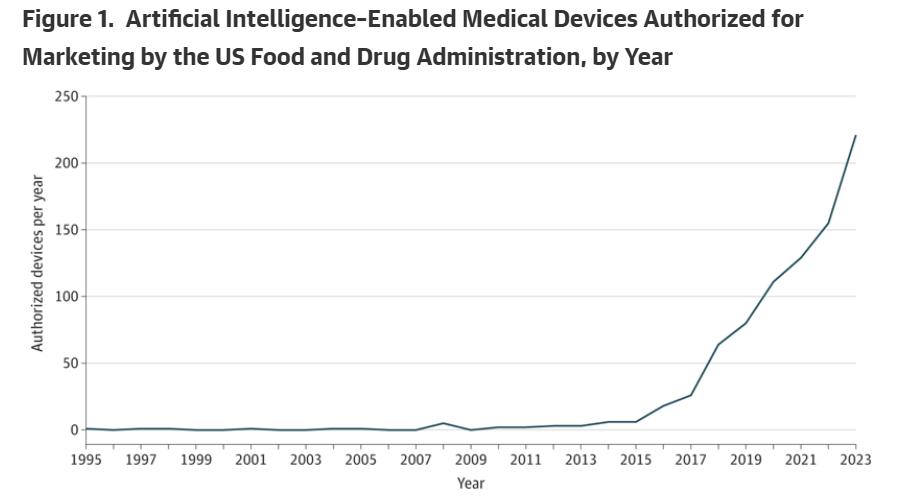

从那时起,FDA 大概已经批准了 1000 种 AI 驱动医疗器械,尤其在放射学和心脏病学领域。

图|FDA 授权销售的 AI 医疗器械(按年份)(来源:本论文)

近期,FDA 关于医疗产品中心的描述开发和使用医疗产品 AI 的 4 个重点领域:(1)促进合作,确保公众健康;(2)促进协调标准、指南、良好实践和工具的制定;(3)促进R&D支持创新的监管方法;(4)支持和 AI 与性能评估和监测相关的研究。

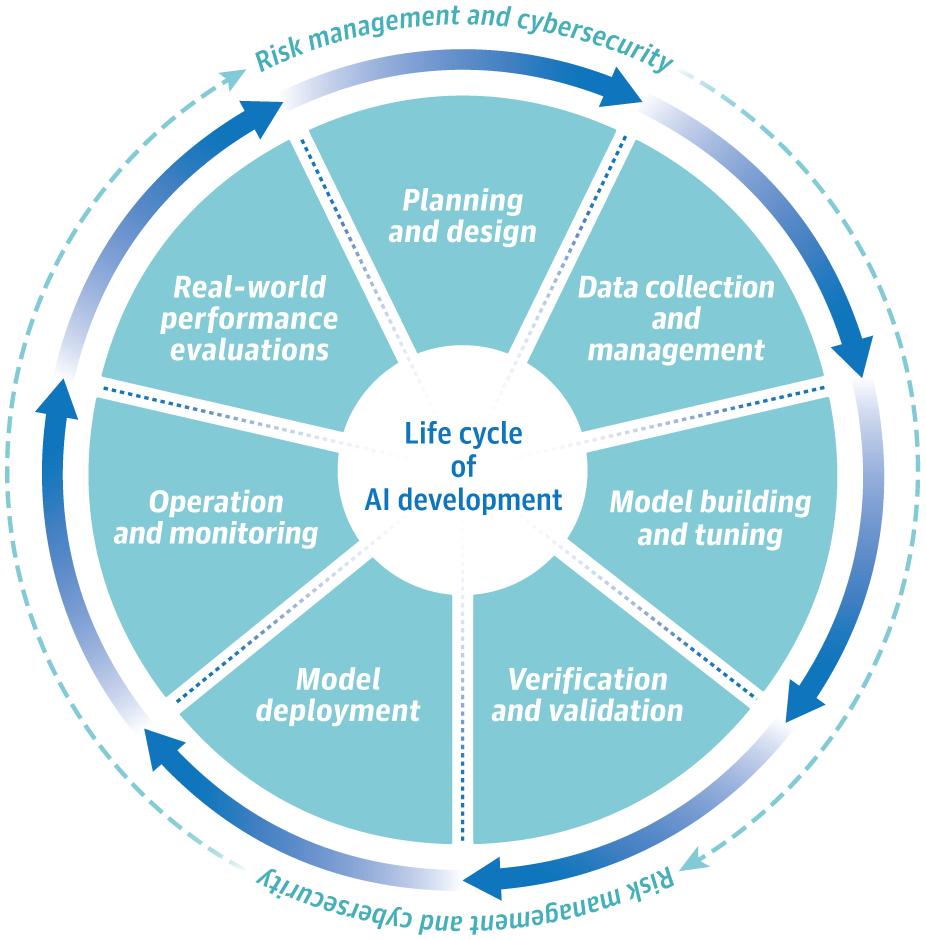

FDA 根据应用的风险程度,建立以风险为核心的监管框架策略, AI 方面,可以分为非控制、部分监督和高度控制医疗器械。FDA 通过生命周期管理方法,重视灵活的监督措施,持续监控 AI 驱动装置的安全性和有效性

图 | AI 整个生命周期的方法(来源:本文)

同时,FDA 还展示了对创新技术的开放态度,推出了“软件预认证试点计划”等特色,为新兴技术的发展铺平了道路。

此外,FDA 为了促进全球监管部门的合作, AI 做好全球协调工作,尤其是在医疗器械领域。

AI 应用于医疗卫生领域

实际上,AI 为医疗产品研发提供多方面数据的潜力是深远的,并且已经进行了比较丰富的应用。而且对于 FDA 在充分了解技术应用的前提下,我们希望对此进行良好的监督和评估。

目前,AI 药物开发和临床研究是医疗卫生应用领域的重点。

就药品开发而言,AI 研究开发的不同阶段正在彻底改变。目前,AI 在药物发现的初始阶段得到了广泛的应用,比如通过机器学习模型分析大规模基因组数据,预测药物与目标的相互作用,从而加速潜在备选药物的选择和优化。

此外,AI 特别是通过计算预测化合物结构与药物活性的关系,在药物设计中也起着重要作用,AI 药物开发时间大大缩短。AI 药代动力学和药效学模型也可以通过分析时间序列数据来补充。

将来,AI 药物开发中的潜在用途还包括优化流程设计,实施先进的流程控制、智能监控、维护和趋势监控。通过分析个人遗传数据,还可以为特定患者制定定制的治疗方法。

就临床研究而言,AI 在临床研究中,它正迅速成为关键驱动力。当前,AI 主要用于提高临床试验的效率和精度。比如,AI 能通过大数据分析和自然语言理解(NLP)从临床试验数据库、实验公告、社交媒体、医学文献、登记数据库、登记处和电子健康记录中的结构化和非结构化数据中挖掘数据,使个人与实验一致,然后选择合适的实验参与者,解决传统临床试验中受试者招聘缓慢、代表性不足等问题。

此外,AI 也可以对临床试验数据的收集、管理和分析以及上市后的安全监测和评估做出巨大贡献。

AI 控制迫切需要创新

然而,随着 AI 技术在医疗领域得到了广泛的应用,FDA 面临新的挑战,包括 AI 随着模型的不断进化和技术应用的复杂性,控制难度直线上升。这样,未来的监管工作不仅要保证技术的安全性和有效性,还要通过跨学科的合作与创新,从容应对。 AI 技术带来的潜在风险。

FDA 已认识到传统不再适用于静态控制方法。 AI 的快速演变,特别是对于生成式 AI 这些技术与大语言模型等新技术有着不可预测的潜在后果。

比如,生成式 AI 虽然可以在诊断、治疗等领域带来巨大的创新,但是也存在一些隐性的错误和偏见,例如 AI 医疗记录助手可能会错误地生成未经讨论的诊断。。所以,这些复杂的东西是必要的。 AI 模型开发专用工具,评估其输出可靠性和安全性。一些现有的评估工具,如 DeepEval 已显示出一定的效果,但是更深层次的控制创新仍然是必要的。

另外,文章指出,AI 保证模型安全的关键在于模型的后续监控和持续评估,AI 技术性能受环境变化影响较大,需要在临床环境中持续实时监测。未被监控的 AI 在实际操作中,系统可能会造成很大的危害,这个领域也迫切需要新的管理工具和方法来应对。

所以,在监督中 AI 在技术上,要多注意长期的效果监测,并指出合作和透明度,以保证效果。 AI 创新、安全、有效的医疗领域。

三位作者在文末写道:所有相关部门都需要以谨慎和严谨的态度对待可能带来变化的人工智能技术。。

作家:阮文韵

本文来自微信微信官方账号 “学术头条”(ID:SciTouTiao),作者:学术头条,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com