Meta 开发新方法:整合语言和扩散 AI 模型

IT 世家 8 月 24 日消息,Meta AI 该公司最新推出 Transfusion 新方法,可结合语言模型和图像生成模型,将其整合到统一中。 AI 系统内。

IT 介绍了世家援引团队,Transfusion 结合了语言模型在处理文本等离散数据方面的优势,以及扩散模型在生成图像等连续数据方面的优势。

Meta 解释说,目前的图像生成系统通常使用事先训练好的文本编码器来处理输入提示词,然后将其与独立的扩散模型结合起来生成图像。

许多模式语言模型的工作原理与之相似,它们将事先训练好的文本模型与其它模式的专用编码器连接起来。

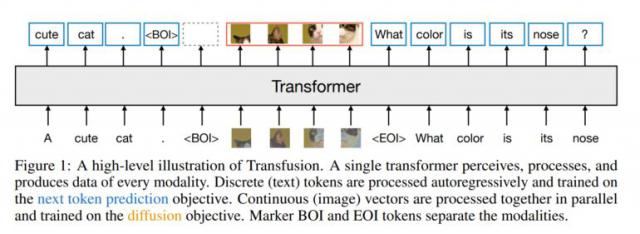

不过 Transfusion 选择单一、统一的 Transformer 结构适用于所有方法,从端到端训练文本和图像数据。文本和图像使用不同的损失函数:文本使用下一个标记进行预测,图像使用扩散。

为了同时处理文本和图像,图像被转换成图像片段序列。通过这种方式,模型可以同时处理一个序列中的文本标记和图像片段,并且具有特殊的注意力隐藏代码(attention mask)也可以让模型捕捉到图像内部的关系。

不同于 Meta 现有的 Chameleon(将图像转换为离散标记,然后用处理文本的方法处理)等方法,Transfusion 保留图像的持续表示方法,避免因量化而造成的信息损失。

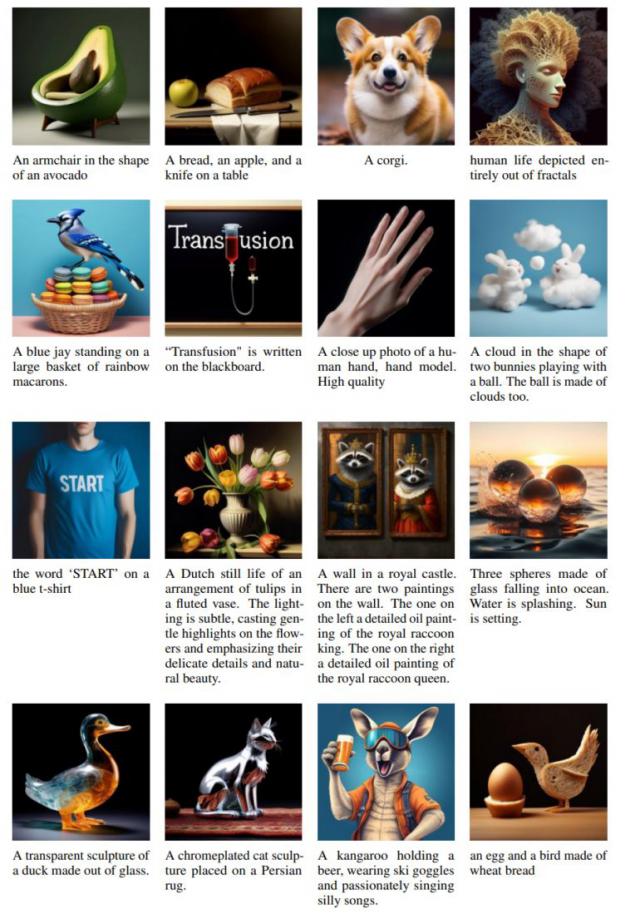

实验还表明,与同类方法相比," 结合 " 扩展效率更高。在图像生成方面,它得到了类似于特殊模型的结果,但计算量大大减少。令人惊讶的是,图像数据的整合也提高了文本处理能力。

研究人员在 2 数以万亿计的文字和图像标记训练了一个 70 十亿参数模型。该模型获得了图像生成和 DALL-E 2 等待完善系统相似的结果,同时还可以处理文本。

IT 这个家庭还附有一个参考地址

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com