ChatGPT多次输出废话,吐槽后引出新提示技术

半夜3点,你与AI苦战许久,在ChatGPT、Claude、Gemini等各个平台间来回切换,却始终无法让它写出一封理想的邮件。这并非段子,而是很多人的真实经历。

有一位开发者尝试用ChatGPT写一封不那么“机器人腔”的销售邮件,连改带问试了147次,每次输出的内容依旧死板空洞,毫无人类写作的感觉。

在第147次时,他崩溃地敲出一句:“你就不能问问我需要什么吗?”没想到这句吐槽成了灵感的火花。他开始思考,如果AI能主动提问、索要完成任务所需的细节,会怎样呢?接下来,他用72小时开发出一个叫“Lyra”的元提示(meta - prompt)。

简单来讲,Lyra相当于给ChatGPT换了个人设,让它在回答请求前先采访用户,获取关键信息后再动笔。例如,以前你让ChatGPT“写一封销售邮件”,它只会干巴巴地给出一个模板;而使用Lyra后,同样的请求会让ChatGPT追问产品、目标客户、痛点等关键细节,然后根据你的回答写出真正贴合需求的邮件。

这则帖子在Reddit上迅速走红,收获了近万点赞和上千评论。不少网友称赞这是个“很棒的点子”,但也有人吐槽:“折腾147次提示词,那还不如直接自己写封邮件快。”“都试了一百多次了,有那功夫早就写完了。”

这场“147次失败召唤GPT”的经历,折射出一个现实:让AI办成一件看似简单的事,有时比我们想象的要复杂和滑稽得多。提示词技术,也是时候要发生变化了。

一、AI协作的新路线:讲“氛围”、给“上下文”

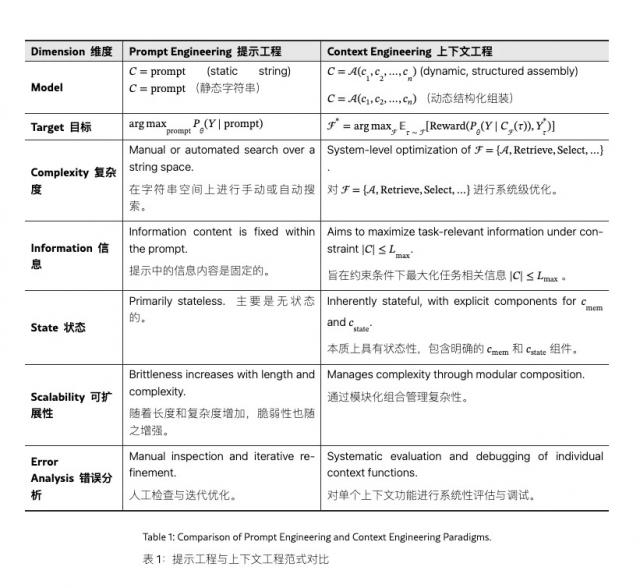

Lyra的诞生看似偶然,实则反映了提示词技术演进的一种思路。过去,人们热衷于在提示词上做文章,有时提示词的长度甚至超过了AI的产出。而Lyra受到的质疑,也是对这种旧做法的反思,背后是AI社区近来兴起的新趋势,比如context engineering。

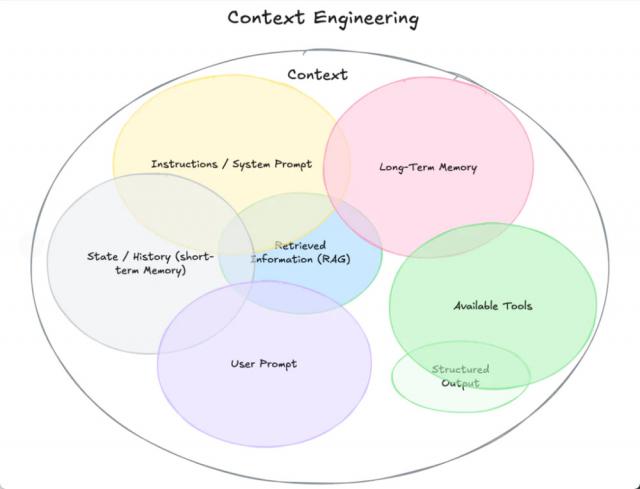

Context engineering本身是一种编程与系统设计的活动,被视为AI系统设计中的“下一代基础能力”。它是在AI应用场景中搭建背景、工具、记忆、文档检索等全流程体系,让模型在可靠上下文支持下执行任务。具体包括:

记忆结构:如聊天历史、用户偏好、工具使用历史;

向量数据库或知识库检索:在生成之前检索相关文档;

工具调用指令schema:如数据库访问、执行代码、外部API格式说明;

系统提示 /system prompt:给AI设置的角色、边界、输出格式规则;

上下文压缩与摘要策略:长期对话内容压缩管理,保证模型高效访问。

可以这样理解,写提示词时,就像是在一个已经填好了历史、主题文件、用户偏好等信息的环境中操作。提示词是“指令”,上下文是“指令背后的材料与背景”。

这部分工作主要由工程师完成,虽然借鉴了一些提示词工程的理念和技巧,但应用场景主要在软件的工程和架构系统设计上。相比于提示词的微调,上下文更适用于实际生产,能实现版本控制、追踪错误、模块复用等效果。

有人会问,工程师的工作跟用户有什么关系呢?简单来说,如果提示词是点火键,那么context engineering就是设计整个打火机,保证一点就能冒出火苗。复杂一点看,context engineering为构建、理解和优化面向未来的复杂AI系统,提供了所需的规范化系统框架。它将关注点从提示词的手艺,转向信息流通与系统优化的技艺。中科院的一篇论文也指出了两者的关键差别。

目前,业界把context engineering当作agent建构的重要实践。尤其是上下文和工具调用等,能有效提升模型的表现。

二、更轻易的提示词,更清晰的结果

还是回到那个问题:工程师的工作跟普通用户有什么关系呢?当普通用户写提示词时,Context Engineering与Prompt Engineering虽然不完全相同,但实质上存在深刻关联。理解它们的关系,有助于写出更有效、上下文更贴切的提示词。

传统提示词方法常常失败,原因在于很多人使用AI就像用搜索引擎,几句指令就想得到满分答案。但大模型生成内容依赖于理解上下文和模式匹配,如果提示含糊、信息匮乏,模型只能硬猜,往往产出千篇一律的套话或答非所问。这可能是因为提示词写得模糊、需求不清晰,也可能是因为提示词被放在不够结构化的上下文环境里,比如被冗长的历史聊天、图片、文档、格式混乱掩盖,模型很可能“抓不到重点”或“回答跑题”。

以Lyra里写邮件的场景为例,在一个结构化完善的窗口中,包含了用户之前的沟通历史、语气偏好等信息,模型就能根据这些信息组织出更贴合用户口吻的邮件草稿,甚至不需要用户写很复杂的提示词。

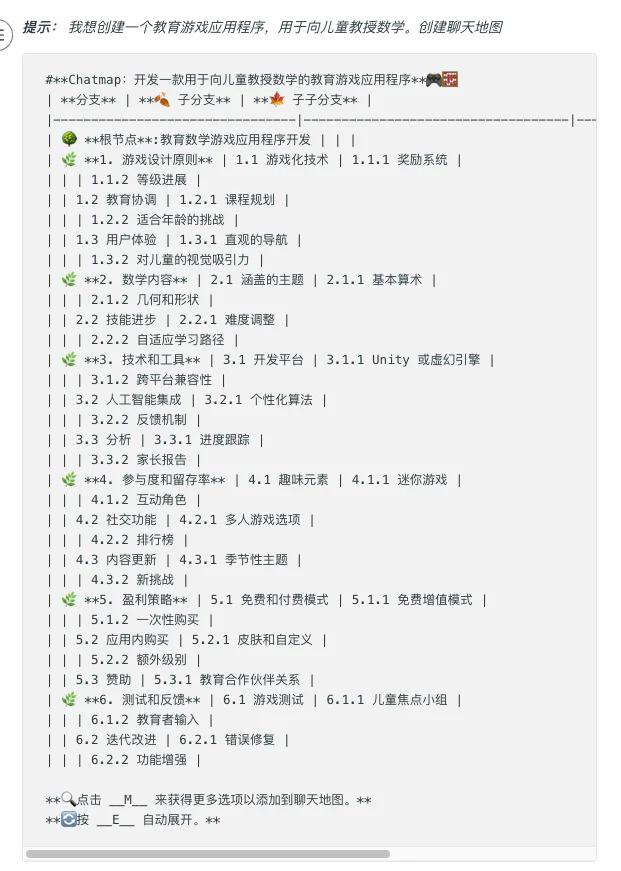

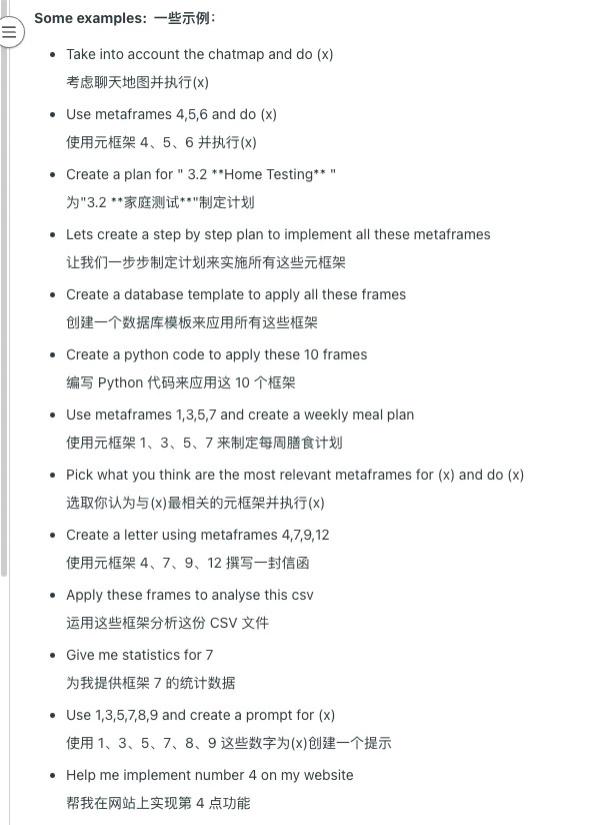

即便用户只是停留在提示词层面,无法进行上下文工程,也可以借鉴其中的一些思路。比如,来自Reddit社群ChatGPTPromptGenius的“Synergy Prompt”,就是在提示词层面结构化上下文。

它提出了三个核心构件:

元框架Metaframe:为对话添加特定视角或焦点,是对AI构建的“基础认知模块”(如角色设定、目标说明、数据来源说明等);

具体信息Frames:每个上下文模块中的具体内容;

对话地图Chatmap:记录整个对话的动态轨迹,捕捉每次互动和语境选择。

简单来说,就是将碎片化信息整合为模块,最后形成图谱,使用时可整体性调用已有模块。

当AI掌握从主干到细枝末节的完整语境结构时,就能精准调取所需信息,给出精确的针对性回应。这也正是context engineering想要达成的效果,这何尝不是一种互相成就呢?

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com