DeepSeek,谁的游戏被搅乱了?

2022年11月ChatGPT诞生的最后一次AI行业引起了全体员工的振动。从那以后,AI行业的每一次重大变化都被称为“ChatGPT时刻”。

“DeepSeek时刻”出现在2024年底,被视为AI历史上一个新的转折点。

2025年春节前期,中国杭州某AI公司DeepSeek(深度追求)连续发布V3(2024年12月26日)和R1(2025年1月20日)两大开源模式。

其中,DeepSeek声称V3的GPT-4o和Anthropic的Claude-3.5在性能上接近闭源模型OpenAI-Sonnet,Llamamama优于开源模型Meta 而且总训练费用只有557.6万美元。推理模型R1的效果接近OpenAI 同时API(应用程序编程接口)的价格仅为OpenAI o1的3.7%。

这是一家成立于2023年7月17日的创业公司,手里拿着一万个英伟达芯片,以7%左右的海外AI巨头成本训练出一个性能不错的大模型。早在2024年5月,这家公司就在V2模型发布后,正式开始了中国大型模型价格战,被字节、阿里、百度等大企业盯上。年底,它成功地将价格战烧到了海外。

DeepSeek的出现一度导致全球算率概念股暴跌,加上美股科技股普遍下跌的影响,英伟达股下跌近17%,市值蒸发近6000亿美元,是美股历史上规模最大的。OpenAI和谷歌最近也紧急推出了最新的模式,AI行业可以称之为火烧油。

在DeepSeek走红之后,硅谷巨头们开始举桌,OpenAI表示已经发现了证据,证实了DeepSeek“蒸馏”OpenAI模型的迹象,Anthropic创始人和CEO Dario Amodei发文否认R1取得的突破,并呼吁加强对中国的计算率出口管制。

尽管这次盛会背后的情绪如此,本文试图澄清DeepSeek是否被“高估”,以及DeepSeek是否会给国内外AI产业带来什么涟漪效应。

要戴上它的冠,必须承受它的重量

DeepSeek-R1上线20多天,接受多少掌声,承受多少压力。

林志是AI行业的从业者。「定焦One」总结了DeepSeek口碑的来源:1、完全免费使用。2、和顾客聊天的时候会展示思维过程,这样也可以提高客户的提问方式和对话感受,但是o1没有公布思维过程,可能是因为害怕竞争对手复制过程,训练自己的模型。3、进行技术论文和模型开源毫无保留,一些开源大模型仍然会给自己留下最好的版本。

但是前几天,由于热门用户发现DeepSeek经常停机,几乎不能正常使用,因为公司服务器遭到了大规模DDoS的恶意攻击,DeepSeek在发稿时已经恢复正常使用。

DeepSeek表示服务性能稳定

当然,以上特征只是让DeepSeek拥有客户自发传递的基础,在一定程度上,DeepSeek之所以受欢迎,是因为它让海外AI巨头“破甲”,出现了“掀桌子”的行为。

面临许多人对“DeepSeek是否具有创新性”的质疑,DeepSeek已经在其发表的V3和R1技术论文中做出了回应:1、V3模型采用多种自研技术进行架构创新,包括DeepSeekMoEE MTP多Token预测技术,DeepSeekMLA架构,使低成本训练成为可能;2、通过纯强化学习,R1模型放弃了传统RLHF(人类反馈强化学习)中的HF部分。(RL)RL的优先级和有效性得到了直接训练的验证,训练效率得到了进一步优化。

也就是说,DeepSeek证明了自己确实能够实现“以不到600万美元的训练费用(可理解为净算率费用),完成一个接近巨头的性能模型”。

然而,SemiAnalysis指出,半导体市场分析与预测,这一数字主要指模型预训练的GPU成本,557.6万美元。,DeepSeek的总成本可能在4年内达到25.73亿美元,考虑到服务器的资本支出、运营成本等因素。

不可忽视的是,创新成本下降的趋势已经开始,DeepSeek只是加速了这个过程。 在DeepSeek之前,方舟投资管理公司的创始人兼CEO“木头姐”指出,人工智能训练费用每年降低75%,推理费用甚至降低85%至90%。

英诺天使基金合伙人王晟也有同样的看法,比如年初发布模型,年底发布同样的模型,成本会大大降低,甚至降低到1/10。而且OpenAI作为一个闭源模型,也有很高的概率向外界披露算率成本。因为要留下一些盈利空间,就要不断加强资本市场的昂贵故事,从而获得更高的投资。

然而,DeepSeek的价值不仅仅在于“便宜”,更在于它是一个“屠龙少年”的故事。

DeepSeek在ChatGPT出现之前,在中国面临算率控制之前,已经拥有了超万个GPU储备。从2008年开始,与DeepSeek相关的创始人梁文峰开始探索量化交易,因为要将深度学习模式应用于实盘交易,必须储备大量的算率,2019-2021年间,梁文峰的另一家公司幻方相继自主研发了“萤火一号”和“萤火二号”AI集群,积累了大量的芯片和技术人才。

幻方为梁文峰提供了大量的物品,包括足够的卡片、sense和模型工程能力。梁文峰还为DeepSeek提供了大量的物品,对AGI纯粹的好奇心和探索欲望,以及充分开放的心态。一些参与者表示,幻方已经以非常低的价格向算法研究机构提供了卡片。

这类故事具有不可复制性和美感,这就导致了DeepSeek的全民热度。

谁让DeepSeek恐慌了?

在DeepSeek火了之后,一石激起千层浪,中美AI产业链上下游的企业都受到了冲击。

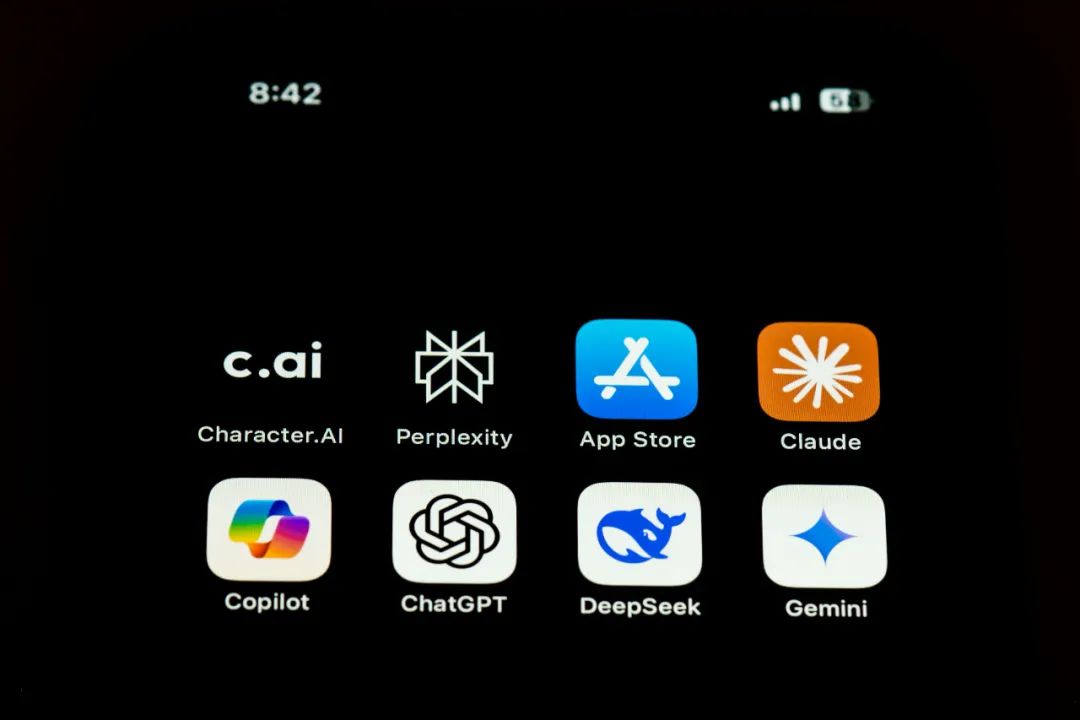

首当其冲的是chatbot类(聊天机器人)AI应用,根据AI产品清单的数据,DeepSeek在2025年除夕前后,每天的活动超过2000万,超过了国内豆包和Kimi,在中国排名第一。与此同时,DeepSeek只用了一个星期就超过了1亿客户,而ChatGPT需要两个月的时间。

实际上,在DeepSeek发布R1的几乎同一天,月之暗面推出了自己的Kimi。 k1.5思维模式,免费在Kimi使用。豆包APP还更新了实时语音通话功能,对所有客户开放,但两者的音量都被覆盖,影响了日常生活。

林志认为,这件事充分展示了使用者对chatbot模式的忠诚度非常低。,一旦有了更强大、更便宜、更快捷的模型,每个人都会转移过去。

但是,从产品形态来看,豆包已经在商品中接入了多模态大模型,而DeepSeek目前只有对话,而且感觉不稳定。虽然DeepSeek在除夕夜(1月28日)发布了一个大模型Janus的开源文字生成图像(文生图)-Pro 7B,但是DeepSeek网页和APP中的应用还没有接入。

上面是豆包,下面是DeepSeek

在真正的杀手级应用出现之前,竞争仍然是背后的大模型能力。从这个角度来看,目前第二批与DeepSeek直接相关的企业是自主研发的大型企业。

从投资者的角度来看,王晟指出,自2024年5月DeepSeek发布V2模型以来,圈内基本达成共识——在国内巨头中,最好的大模型是阿里的Qwen,豆包在2023年不够好用,但在2024年下半年迅速提升;DeepSeek和月亮的暗面在创业公司中(Kimi)增长最快,其它五骁龙(零一万物,MiniMax、百川智能,智谱AI、阶跃星辰),有的转型,有的放弃,有的背靠国资,但增长逐渐放缓,六小龙的情况也基本分裂。

在一定程度上,这些闭源大模型公司也将面临与外国巨头相同的折磨:培训成本能降低吗?有没有更有效的训练方法?API价格战还会打吗?

至于DeepSeek是否会改变芯片市场的格局,很多业内人士表示,计算率之争不会消失,但现在已经到了重新评估的时期。英伟达以前太受欢迎了,现在股价只回到了合理的范围,但英伟达的价值最终还是会上来。换句话说,英伟达不是DeepSeek的受害者。相反,随着模型应用场景的拓展,模型越“平等”,对计算能力的需求就越大。

DeepSeek将大家从一腔热血只追求AGI上限,拉回到关注产业落地的现实,它以较低的成本给予相对较高的能力,可以促进产业链的创新,有利于AI原生应用和AI硬件的发展。林志说:“2025年将是AI商业化的第一年。

与此同时,DeepSeek已经验证从芯片到模型,国内AI产业可以部分实现国产替代。,提高了产业信心。春节期间,国内云服务制造商和GPU制造商纷纷部署DeepSeek。

然而,随着一步步被推向“神坛”,DeepSeek的最大影响可能来自于自己未来的选择。

据信源称,阿里正计划投资10亿美元认购DeepSeek10%的股份,估值为100亿美元。这个估值已经超过了月亮的暗面(33亿美元)和智谱AI(20亿美元)。阿里否认了这个消息,有人指出DeepSeek背靠幻方从未找到过融资,但市场仍然担心其他战略方正在使用DeepSeek。

这可能是市场最不愿意看到的结局。今年春节收到“泼天富贵”的DeepSeek,原本是一家自由企业。梁文锋也向媒体提到,与大厂模式最大的区别是“大厂会与平台或生态捆绑,我们完全自由”。有些人担心,如果DeepSeek这次从任何战略投资者那里拿到钱,AI六小龙的故事可能会再现。

新范式的DeepSeek,以及发展空间

从更大的角度来看,DeepSeek的崛起之所以受到海外巨头的重视,是因为两种路径的对比。

王晟解释说,AI产业在运行AGI方向时往往有两种不同的路径选择:“计算军备”范式,堆积技术堆积计算率,首先将大模型性能滑下一个高点,不断推高AGI的能力上限,然后考虑产业落地;另一个是“算法效率”范式,通过架构创新和工程化能力,从一开始就以产业落地为目标,推出低成本、高性能的模型。

可以看出,过去大型企业之间的竞争,基本上都是下注“算率军备”的范式。在这种范式下,OpenAI、Anthropic、包括国内AI六小龙在内的谷歌,都是重资本投资型企业。

由于资金量巨大,这意味着金融市场只能支持少数企业,AI巨头的市场份额远高于其它行业。

DeepSeek-美国总统特朗普在R1公布时宣布,AI基础设施项目“星际之门”总额达到5000亿美元,OpenAI、软银和甲骨文都承诺参与其中。此前,微软表示,2025年将在AI基础设施上投资800亿美元,扎克伯格计划在2025年投资600多亿美元进行AI战略投资。

一个不可忽视的市场环境是,过去每个人都在追求AGI能力的不断增长。只要模型性能增长足够快,无论数据工程如何优化,竞争对手都跟不上头部企业。然而,到2024年11月,“优质文本培训数据即将耗尽”的论调敲响了行业警钟。如果数据供应停滞不前,模型培训也可能停滞不前。每个人都意识到以前广泛的培训模式可能确实存在瓶颈。即使计算率上升,培训时间增加,数据量级增加,能力增长也几乎结束。

图源 /Unsplash

这段时间,事实上,也有企业认为“算法效率”范式是当前可行的范式,只是DeepSeek先做了。“它的一系列模型也证明,在天花板无法上涨的情况下,专注于优化效率而不是增加能力的范式也是可行的。”王晟说。

在这种背景下,作为一名“搅局者”,DeepSeek出现了,“花钱砸模型很值钱”的美国AI巨头资本故事逐渐不成立。

DeepSeek以开源模式进入市场,被认为是依靠生态力量来挑战领导者,而领导者通常会越来越封闭,以免被打乱。

林志表示:“事实上,中美主流路线已经完全反过来了。在阿里Qwen性能追逐之前,Meta的Llama是世界上最主流的开源模型。在海外市场,Llama曾经落后于OpenAI和Claude等闭源模型,但在中国,开源模型目前是模型的旗帜。

然而,也有很多业内人士认为不应过于乐观,因为,DeepSeek只能算是在2025年开了个好头,竞争还在继续,差距还在继续。

近日,几家海外巨头推出了新模式。OpenAI于2月1日发布了OpenAI最新推理模式o3-mini系列,这是OpenAI向免费用户开放的第一个推理模式。谷歌于2月6日正式宣布Gemini 2.0家族更新,其中Gemini 2.0 Flash-Lite版本被称为谷歌迄今为止最具成本效益的模型。

正如梁文锋自己所说,虽然具体的技术方向一直在变化,但模型、数据和计算率的组合不会改变。数据工程也是一个非常重要的环节。尽管OpenAI面临侵权问题,但它已经积累了自己的数据库。由于TikTok事件的影响,豆包声称不会蒸馏数据,“原始数据库”成为大型工厂的环城河之一。

另外,王晟提到,根据Trade-off Curves(选择曲线),DeepSeek选择的路径代表着它的精力集中在工程优化上,因此很难在能力上限上取得突破。“它可以通过目前的方法继续迭代新版本来提高自己的能力。这是个问题。”

从学生时代开始,梁文锋就表现出探索AGI的热情和不断创新的追求。DeepSeek之前只是避免了无效或失败的尝试,但我们不应该否认巨头们通过各种未知的尝试,不惜一切代价拓宽AGI边界的努力。

DeepSeek搅拌的这片海洋,波澜还在继续扩大。

*根据受访者的要求,本文林志为化名。

本文来自微信微信官方账号“定焦”(ID:dingjiaoone),作家:苏琦,编辑:魏佳,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com