快手拿可灵拍电影,抢了Sora的风头。

作者 | 陶然 编辑 | 魏晓

十二月初,AIGC 年初,圈子重新出现 Sora 曝光时的热闹:

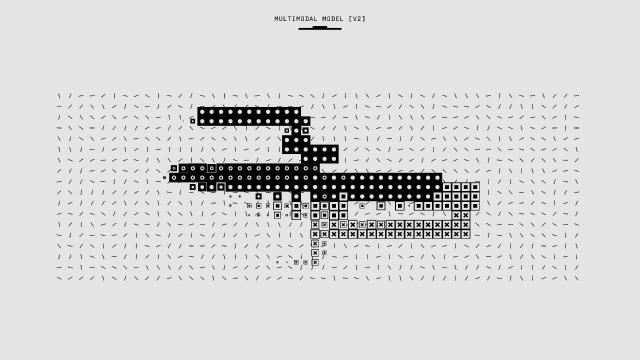

一方面,OpenAI 憋了半年 Sora 最后打开使用,服务器立刻被挤压起来;另一方面,国产视频模型也逐渐高韧性更新输出。比如Aautorapper的灵魂 AI,如今已进化到可以用来拍电影的阶段。

月初,国内第一个由可灵牵头的“ AIGC “导演同创计划”,首批总共发布 9 一部短片,快手搜索这个计划名称就可以看了。

9 这部电影来自圈子 9 著名导演和 AIGC 作家合作,导演组在这里,仿佛曾经担任过《英雄本色》、《卧虎藏龙》美术指导的叶锦添,《海洋天堂》和《北京遇西雅图》系列导演薛晓路,风格各异,但大咖确实不少。

这类电影有一个共同点: AI 所有这些——都是拿可灵 AI 影片模型产生的,正片时长大约五六分钟。

放在影视行业,这只是一个微视频的大小,或者是两三集目前大火的短剧时间。内容基本连贯,但画面中还是有很多槽点。

但这些并不重要,重要的是整部电影。 100% 由 AI 制作方面,虽然导演们在后续的采访中都谈到了“真正需要反复生成和调优”。

AI 拍摄电影,现在终于不是噱头了。

AIGC 的一大步

人物、故事,然后制作音频、视频、表演等元素,在我们的认知中形成了“电影”,无论是大制作还是小成本,微视频还是好莱坞。

第一个要求是角色要确定,故事要连贯。传统影视制作需要剧本、人选、动画电影原画设计,基本确定后再开工。

但是“连接”和“确定”, AI 就视频模型的生成而言,这一直是一个巨大的问题。几秒钟一个场景可能还可以。一旦时间长了,有很多复杂的场景提示词,画面主体、环境等。很可能会“千变万化”,圆圈会变成方形,下一个场景可能会再次变回。

并且,在“黑箱”中,这些变化几乎是不可控的。

今年七月,蓝媒汇受邀参加了一场头部短剧团队的媒体交流会议,AI 在话题会上生成视频聊得很热闹。

从方式上看,短剧本身的规模决定了行业内的每一部作品都不会也不会是大制作,所以如果可以的话 AI 理论上,直接生成内容会大大降低成本。

但是一线短剧从业者,在当时给出了短暂的否定回答:AIGC 现在还不能很好地使用,原因概括为“质价比不高”。

首先,目前 AI 调用视频模型的成本还是比较高的,这个成本是相对于生成结果而言的。

假定找专业团队做后期特效等内容就是花一份钱做一件事,那么,同样的需求让 AI 来做,结果很可能是花了半份钱,却只做不到。 1/10 事情,而且后面还要多次修理,劳神费力,因小失大。

不好用造成的不划算,成了 AI 视频生成模型,在目前几乎是最小单位的短剧轨道上,形成了供求关系的阻力:技术已经存在,但生产力尚未形成。

会上,经理大胆地做了一个预测,说“至少半年”。

五个月后,可灵还真的拿出了这种生产力,至少是生产力的雏形。

对比拍摄电影,就是主角、场景等元素都可以固定下来,可以拍成作品,之前的电影, AIGC 没有办法做出这种长期的连接和一致。

有什么好的?有什么区别?

具体看电影,拿时间最长的一部来说说细节:

开头讲故事的原因是小蓝和父母通过电脑视频聊天,了解到父母在老家准备收麦子,导致后面派机器人帮忙。

情节逻辑本身不必在意,这幅画确实有一些亮点。

第一,固定位置的计算机在第一个镜头中非常稳定,包括苹果的背部。 logo 而且随着时间的推移也没有改变,AI 很明显,“计算机”在场景中是一个固定物体,视频聊天并不影响计算机的外观。

在角色方面,可以看到小蓝和父母,三个人嘴里的动作和音频内容大致可以对齐,至少开合时间是正确的。

在采访中,导演贾樟柯特别提到了这一点,说使用了可灵灵。 AI 新推出的“对口”功能,挑战了“对口”功能讲方言的能力。该功能允许用户在生成人物视频后上传音频,然后将音频内容与视频人物嘴型同步,以满足影视创作中人物对话的基本需求。

而且,这里的导演还是用方言,山西汾阳话。

自然,小问题也不是没有,后面这段画面在短时间内改变了三个场景,小镇找路,搭便车,最后找麦地。

在这三个场景的转换中,虽然人物主体保持了一致,但都是人脸。 男性机器人以白色机械为主体,但无论是面部细节还是白色人体结构,三个场景都可以清晰地看到是三个完全不同的“角色”。

这就是上面提到的“一致性”问题。无论是三段内容各自生成,还是三个场景切换写在同一段提示词中,画面的主要人物在细节上依然无法控制。

用影视标准来评价,这当然是有问题的,但是对于 AIGC 而且,这一程度的一致性维持,考虑到整部电影的五分钟以上,其实还算不错。

在这部电影的最初设计中,机器人设定是下图这一更抽象的纯机器形象,更有报道称“更难控制画面的一致性”,AIGC 作者 Jade Wu 解决办法是换成一个有人像的半机器人设计。换言之,现在的场景状态实际上已经花了一些时间来调整。

前不久,OpenAI 的视频王炸 Sora 从大量的实测图片来看,对外释放,Sora 独特的画面可靠性和一致性 t0 这应该是毫无疑问的。

而值得注意的是,很多事情, Sora 在拟真画风视频中,画面几乎看不到很浓的“ AI “味道”,而是有一种物理模拟在世界模型概念下的实拍感。

时间方面,目前可灵等分钟级以上的能力已经相当可观。接下来我们要期待的是模型生成的场景能否去掉。 AI 味道,做到“真假难辨”。

有限的技术差距和追踪过程,反而值得期待。

Lanmeih/ 今日话题

你用过 AI 生成视频吗?感觉如何?

我们在评论区聊天 ~

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com