填补 AI 安全空白:谷歌推出安全人工智能框架风险评估工具

2024-10-27

IT 世家 10 月 26 日消息,谷歌公司于 10 月 24 每天发布博文,宣布推出。 SAIF 风险评估工具,目的是帮助人工智能开发者和组织对其安全状况进行评估,识别潜在风险,并采取更强的安全措施。

SAIF 简介

IT 世家注:去年谷歌发布了安全人工智能框架(SAIF),旨在帮助用户安全、负责任地安排部署 AI 模型,SAIF 不但分享了良好的实践,而且为行业提供了一个安全设计框架。

为推广这一框架,谷歌和行业合作伙伴共同建立了安全人工智能联盟(CoSAI),这是促进关键的 AI 安全措施。

SAIF 风险评估工具

目前谷歌已在新网站上 SAIF.Google 上提供 SAIF 风险评估工具,通过问卷运行,客户回答后会生成定制的检查清单,指导他们保证。 AI 系统安全。

工具包含多个主题,包括:

AI 训练、调整和评估系统

模型和数据集的密钥管理

避免攻击和对抗性输入

生成性 AI 安全设计和编码框架

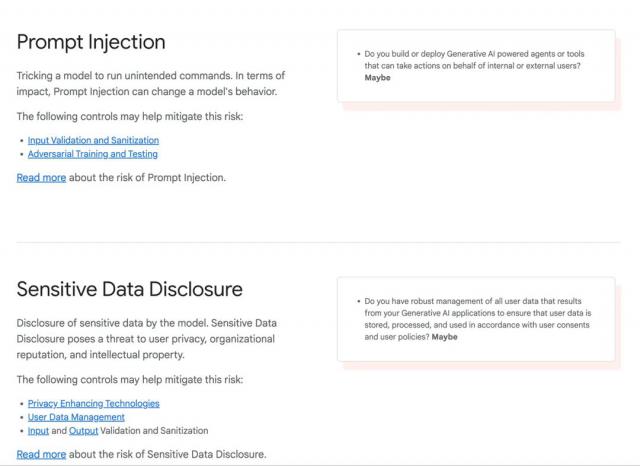

使用者在回答问题后,工具会立即生成报告,突出问题 AI 数据中毒、提醒注入、模型源篡改等系统面临的具体风险。

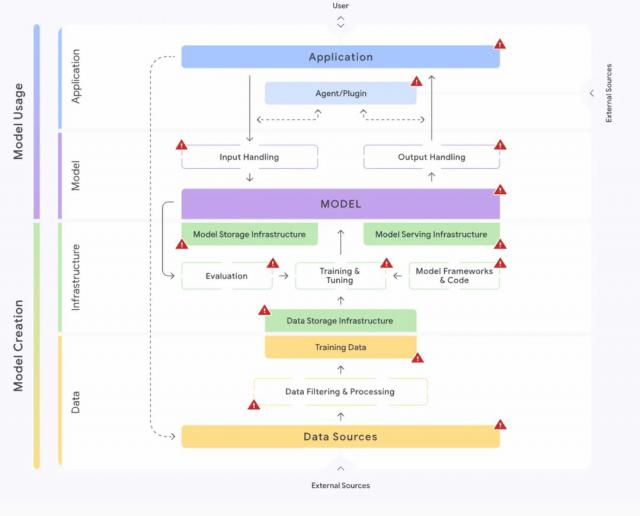

每一种风险都附有详细的解释和建议的缓解措施,此外,用户还可以通过互动 SAIF 了解风险地图 AI 如何在开发过程中引入和减少不同的安全风险。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com